この記事のポイント

AIには「関連情報の選別ができない」フレーム問題が根本にあり、万能ではないことを前提にした導入設計をすべき

ハルシネーション率は最良モデルで0.7%だが法律18.7%・医療15.6%と高リスク領域では人間の最終確認を必ず組み込むべき

AIプロジェクトの失敗率80%超の最大原因は過度な期待であり、スモールスタートで効果を実証してから拡大すべき

ブラックボックス問題を回避するにはXAI(説明可能なAI)の導入が有効で、医療・金融・法務分野では必須と考えるべき

CEO・経営層がAIプロジェクトに直接関与すると成功率が68%に上がるため、現場任せにせず経営課題として取り組むべき

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

AIは画像認識や自然言語処理で人間を超える成果を上げる一方、「関連情報だけを選び出す」能力の欠如(フレーム問題)をはじめ、根本的な限界を抱えています。

2026年現在、ハルシネーション率は最良モデルで0.7%まで低下しましたが、法律分野18.7%・医療分野15.6%と高リスク領域での課題は依然深刻です。

本記事では、フレーム問題の定義と具体例、ハルシネーション・ブラックボックス問題など6つの技術的課題、解決に向けた最新アプローチ、企業導入の注意点(プロジェクト失敗率80%超の背景)、そしてAI市場の投資動向とコスト目安までを体系的に解説します。

目次

AIの限界とは

AIは画像認識や自然言語処理、ゲーム戦略など特定のタスクで人間を超える性能を発揮しています。一方で、AIには根本的な限界が存在し、2026年現在もすべてが解決されているわけではありません。ここでは、AIの限界の全体像を整理します。

AIが得意なこととできないこと

AIの能力と限界を理解するには、得意な領域と不得意な領域を明確に分けて把握することが重要です。以下の表に、主要な項目ごとの得意・不得意をまとめました。

| 項目 | AIが得意なこと | AIが苦手なこと |

|---|---|---|

| データ処理 | 大量データの高速分析・パターン認識 | 少量データからの汎化・未知の状況への対応 |

| 知識活用 | 学習済みデータに基づく予測・分類 | 因果関係の理解・常識的な判断 |

| 創造性 | 既存パターンの組み合わせによる生成 | 真に新しい概念の創造・芸術的直感 |

| コミュニケーション | テキストの生成・翻訳・要約 | 感情の理解・文脈を踏まえた共感 |

| 意思決定 | ルールベースの判断・確率的な推論 | 倫理的判断・曖昧な状況での優先順位付け |

実務でAI導入を検討する際は、この得意・不得意の境界線を意識することが不可欠です。AIが苦手な領域に無理に適用しようとすると、期待した成果が得られず投資が無駄になるケースが多く報告されています。

AIができることできないことについては、こちらの記事でさらに詳しく解説しています。

2026年時点のAIの到達点

2026年現在、生成AIの登場によりAIの活用範囲は飛躍的に広がりました。企業の89%がAIを何らかの業務に導入しており、グローバルAI市場は約3,760億ドル規模に成長しています。

しかし、AIプロジェクトの80%以上が期待した成果を出せていないという調査結果もあります。その背景には、ハルシネーション(事実と異なる情報の生成)、フレーム問題、ブラックボックス問題といった技術的な限界が存在します。以降のセクションでは、これらの限界を体系的に解説し、解決に向けた最新のアプローチを紹介します。

フレーム問題とは

フレーム問題は、AI研究における最も有名な難問のひとつです。AIが意思決定を行う際に「関連する情報だけを選び出し、無関係な情報を無視する」能力に欠けることを指します。

フレーム問題の背景と定義

この概念は、1969年にAI研究者のジョン・マッカーシーとパトリック・J・ヘイズが論文の中で提起しました。当初は、ロボットが動作を計画する際にすべての可能性を考慮しなければならないという計算上の困難を説明するために定義されたものです。

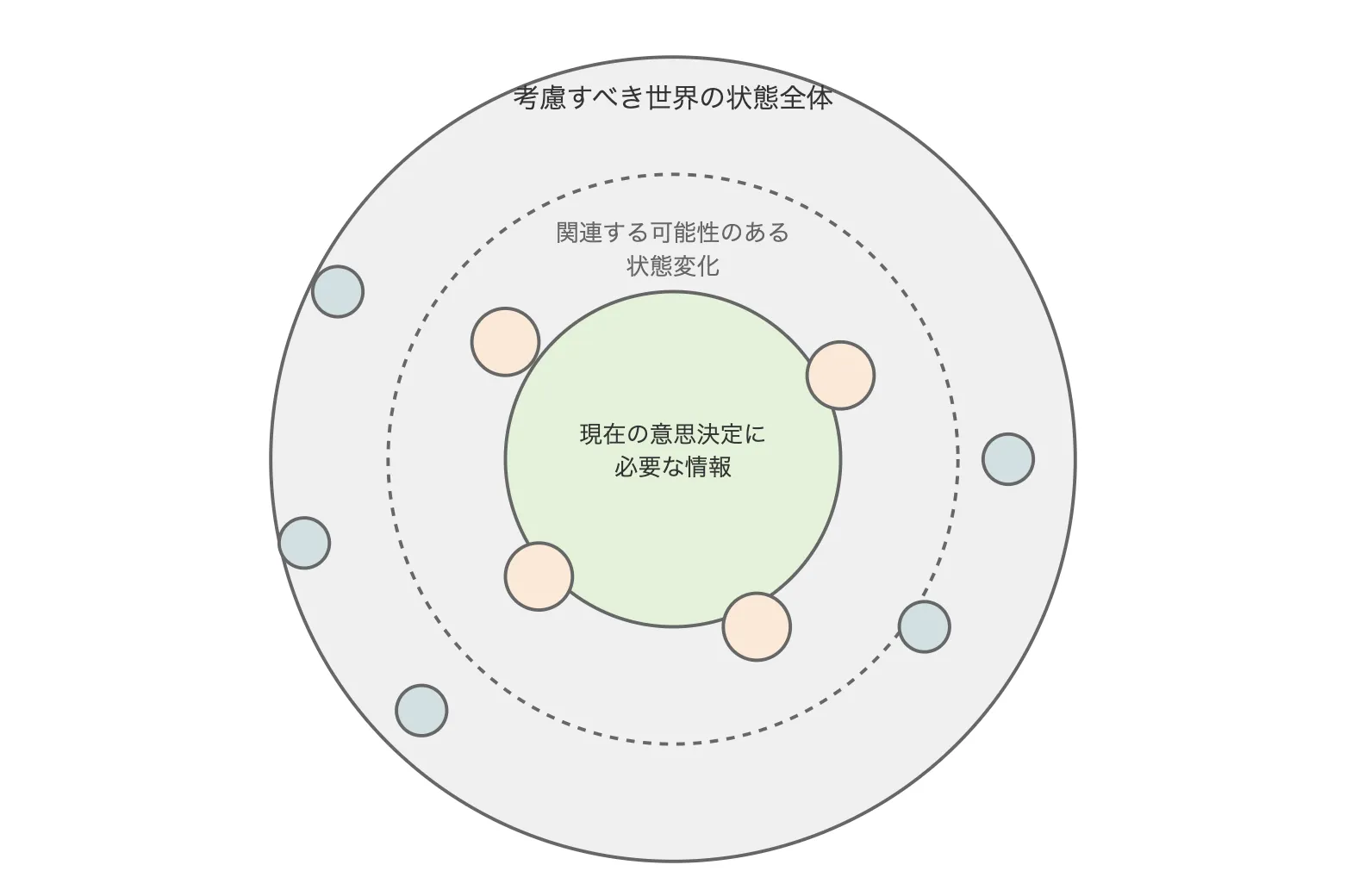

フレーム問題の概念図

簡単に言えば、人間は「今この瞬間に関係のあること」を無意識に選別できますが、AIにはその能力が備わっていません。人間が部屋に入ったとき、ドアノブの材質や天井の高さを逐一確認しないように、膨大な情報の中から「今やるべきこと」に必要な情報だけを直感的に選べるのが人間の強みです。AIはこの選別を効率的に行えないため、計算量が爆発的に増加してしまいます。

フレーム問題の具体例

フレーム問題を直感的に理解するために、AI研究で有名な2つの思考実験を紹介します。

-

電話帳のフレーム問題(マッカーシー&ヘイズ)

ある人物の電話番号を調べるというタスクをAIに与えたとします。人間なら「電話帳を開いて名前を探す」だけで済みますが、AIは「電話帳を開くと部屋の温度は変わるか」「電話帳のページをめくると地球の自転に影響するか」といった無関係な変化まで検証しようとする可能性があります

-

爆弾とロボットの問題(ダニエル・デネット)

部屋の中に爆弾が仕掛けられており、ロボットがバッテリーを取り出すというタスクを与えられたとします。最初のロボットはバッテリーを載せたワゴンごと引き出しましたが、爆弾もワゴンに載っていたため爆発しました。次のロボットは行動の副作用をすべて考慮しようとしましたが、計算が終わらないうちに爆弾が爆発しました。3番目のロボットは「関係のないことは無視する」よう設計されましたが、何が関係ないかを判定する計算に時間がかかり、やはり間に合いませんでした

これらの例が示すのは、「何が関係あり、何が関係ないか」を効率的に判断すること自体が極めて難しい問題であるということです。フレーム問題はAI研究の初期から議論されてきましたが、2026年現在もニューラルネットワークや現実世界の意思決定においては完全には解決されていません。

AIが直面する技術的な課題

explainable AI (参考:IBM explainable AI)

フレーム問題以外にも、AIにはいくつかの技術的な課題が存在します。以下の表に、2026年時点で特に重要とされている6つの課題を整理しました。

| 課題 | 内容 | 2026年の状況 |

|---|---|---|

| ハルシネーション | 事実と異なる情報を生成する問題。法律分野では18.7%、医療分野では15.6%の誤り率が報告されている | 最良モデルで0.7%まで低下したが、数学的に完全な解消は現行アーキテクチャでは不可能と証明されている |

| ブラックボックス問題 | ディープラーニングモデルの判断根拠が説明困難。医療・法務・金融で信頼性の障壁となる | XAI(説明可能なAI)の研究が進展し、部分的に改善中 |

| データ依存性 | 偏ったデータで学習すると不公正な判断や差別的な出力が生じる | データ品質の重要性への認識は高まったが、バイアス完全除去の手法は確立されていない |

| リアルタイム処理の限界 | 高度なAI処理には大量の計算リソースが必要で、即時応答が困難な場合がある | GPUやTPUの進化で改善傾向だが、エッジデバイスでの処理には依然課題がある |

| 汎用性の不足 | 特定タスクに特化したAIは、未知の状況や学習していないタスクに対応できない | AGI(汎用人工知能)は依然として実現の見通しが立っていない |

| 倫理的課題 | AIの判断による差別、プライバシー侵害、責任所在の不明確さ | EU AI Act(2026年8月完全施行)や日本のAI推進法(2025年6月施行)で法的枠組みが整備中 |

特にハルシネーションは、生成AIの普及に伴い企業導入の最大のリスク要因となっています。先進的な推論モデルほどハルシネーション率が上昇するという「推論と正確性のトレードオフ」も報告されており、単純にモデルを高性能にすれば解決する問題ではないことが明らかになっています。

フレーム問題の解決に向けた取り組み

フレーム問題に対しては、AI研究の歴史の中でさまざまなアプローチが試みられてきました。2026年時点での主な取り組みを整理します。

論理ベースの解決

1980年代までに、論理プログラミングの枠組みの中ではフレーム問題は技術的に解決されています。知識グラフや論理プログラミングを活用して、関連する情報を効率的に選別する手法が開発されました。Googleのナレッジグラフはこの応用例のひとつで、検索クエリに関連する情報を迅速に提供し、不要な情報を除外しています。

ただし、この解決はあくまで形式論理の範囲内であり、現実世界の複雑さには対応しきれません。

機械学習による実用的な回避

ディープラーニングを用いたニューラルネットワークは、膨大なデータを学習することで、関連性の高い情報を自動的に抽出する能力を獲得しています。フレーム問題を「解決」したわけではありませんが、実用的なレベルでは多くのタスクで問題を回避できるようになりました。

画像認識や自然言語処理など、入力と出力の関係が明確なタスクでは、ディープラーニングがフレーム問題の影響を事実上無力化しています。一方で、自動運転のように環境が刻一刻と変化する場面では、何が関連情報で何が無関係かを正確に判断できない場面が依然として存在します。

強化学習と適応的学習

強化学習では、エージェントが試行錯誤を通じて効率的な行動を学習します。メタラーニング(学習の学習)と組み合わせることで、新しいタスクに対して適応的に学習し、重要な情報だけを選別する能力が向上しています。

2026年の最新アプローチ

最新の研究では、以下の技術がフレーム問題への新たなアプローチとして注目されています。

-

確率的プログラミング

新しい情報に応じて信念を確率的に更新し、関連情報の選別をより柔軟に行う手法です。従来の論理ベースとは異なり、不確実性を前提とした意思決定が可能になります

-

階層的タスクネットワーク

行動を階層的に整理し、AIが関連する変化にのみ集中できるよう設計されたアーキテクチャです。タスクの分解により、各レベルで扱う情報量を制限できます

-

文脈認識システム

大規模言語モデルが周囲のコンテキストから意味を推論する能力を活用し、関連情報の理解を深めるアプローチです。プロンプトエンジニアリングによりコンテキストを明示的に与えることで、AIが「何に注目すべきか」を効率的に絞り込めます

論理ベースのAIではフレーム問題は技術的に解決されていますが、ニューラルネットワークや現実世界の意思決定では依然として未解決です。完全な解決にはAGI(汎用人工知能)の実現が必要とされており、AI研究の最前線で議論が続いています。

AIの限界を克服する解決策

AIの限界を感じた場合でも、適切なアプローチを取ることで多くの課題は緩和できます。ここでは、実務で有効な3つの解決策を紹介します。

ハイブリッドアプローチ

AIと人間の知識を組み合わせることで、AIの限界を補い、精度や信頼性を向上させる方法です。医療診断ではAIが提示した結果を医師が確認し最終判断を下すことで、信頼性と安全性を確保しています。金融の与信審査や法務のリーガルチェックでも同様のアプローチが一般的になっています。

人間にしかできない「倫理的判断」「感情理解」「創造的思考」と、AIの「高速処理」「大量データ分析」「パターン認識」を組み合わせることで、単体では実現できない成果を生み出せます。Gartnerは、2026年までに企業の50%が「AIフリー」のスキル評価を導入し、批判的思考力の低下に対処する必要があると予測しています。これは、AIに任せきりにせず人間の判断力を維持することの重要性を示唆しています。

説明可能なAI(XAI)の活用

AIの判断プロセスを可視化・説明可能にすることで、ブラックボックス問題を緩和する技術です。判断根拠を示せるAIは、利用者の信頼を獲得しやすく、誤った判断が発生した場合にも原因の特定と修正が容易になります。

医療分野での診断根拠の提示、金融分野での与信判断の説明、法務分野での判定プロセスの明確化など、AIの判断に透明性が求められる場面で導入が進んでいます。

データ品質の向上

学習データの不足やバイアスに対しては、以下のアプローチが有効です。

-

データ拡張

既存データを回転・拡大縮小・色調変更などで増強する手法です。医療画像データなど収集が難しい分野で特に効果を発揮します

-

転移学習

他のタスクで事前学習されたモデルを基に、新しいタスクに適応させる手法です。少量のデータでも高い精度を実現できます

-

合成データの生成

生成モデル(GANやDiffusionモデル)を活用して不足データを人工的に生成する手法です。プライバシーへの配慮が必要なデータの代替としても活用されています

機械学習の基礎を理解したうえでこれらの手法を選択することが、データ品質の課題を効率的に解決するための前提となります。

AIの限界と企業導入の注意点

AIの技術的な限界は、企業がAIを導入する際に直接的な影響を及ぼします。2026年の最新データをもとに、導入時に押さえるべきポイントを整理します。

企業のAI導入の現状

AI導入は急速に広がっていますが、成功と失敗の差が顕著になっています。以下の表に、2026年時点の主要な指標をまとめました。

| 指標 | データ |

|---|---|

| AI導入企業の割合 | 89%が何らかの業務でAIを利用 |

| 生成AI導入率 | 70%以上が業務に導入済み |

| エージェント型AI本番稼働率 | わずか6% |

| AIプロジェクトの失敗率 | 80%以上が期待した成果を出せていない |

| 失敗プロジェクトの平均損失 | 1件あたり平均420万〜680万ドル |

| CEO関与がある場合の成功率 | 68%(関与なしでは11%) |

社内でAIツールを導入したものの、現場に定着せず結局使われなくなった——そんな経験はないでしょうか。AIプロジェクトの失敗原因の80%以上は技術の問題ではなく、組織体制の不備や経営層の関与不足、明確なKPIの欠如にあるとされています(Pertama Partners)。

導入時に押さえるべきポイント

AIの限界を踏まえたうえで、導入を成功させるために以下の3点を特に意識してください。

-

AIガバナンスの整備

自律的に動くAIエージェントに対して、成熟したガバナンス体制を持つ企業はわずか20%にとどまります。EU AI Actの完全施行(2026年8月)や日本のAI推進法の動向も踏まえ、利用ルールの整備が不可欠です

-

AI人材の育成

スキル不足がAI導入の最大の障壁として挙げられています。技術教育だけでなく、AIの限界を理解し適切に活用できるリテラシーを組織全体で底上げすることが求められます

-

スモールスタートとPoCの実施

まずは小規模な検証(PoC)から始め、効果を実測したうえで段階的にスケールアップするアプローチが、失敗リスクの軽減に最も効果的です。PoC段階でAIの限界を把握しておくことが、本番導入時のトラブルを防ぎます

生成AIのセキュリティリスクについても、導入前に確認しておくことを推奨します。

AI関連の投資動向とコスト

AIの限界が完全に解消されていないにもかかわらず、AI関連の投資は拡大を続けています。ここでは、2026年時点の市場規模と導入コストの目安を整理します。

AI市場の規模

以下の表に、主要な市場データをまとめました。

| 市場 | 2026年規模 | 2034年予測 | 成長率(CAGR) |

|---|---|---|---|

| グローバルAI市場 | 約3,760億ドル | 約2兆4,800億ドル | 26.6% |

| 日本AI市場 | 約209億ドル | — | 32%(2033年まで) |

| AI関連支出(Gartner) | 約2兆ドル | — | — |

| 日本AIインフラ投資 | 約55億ドル | — | 前年比18%増 |

日本のAI市場はグローバルの約5.1%のシェアを占めており、AIエージェント分野ではCAGR 49.9%という急成長が見込まれています(Grand View Research)。

AI導入のコスト目安

企業がAIを導入する際のコスト目安を、規模別に整理しました。

| 導入規模 | コスト目安 | 主な用途 |

|---|---|---|

| PoC(概念実証) | 100万〜500万円 | 課題の特定、小規模な検証 |

| 部門導入 | 500万〜3,000万円 | チャットボット、文書分類、データ分析 |

| 全社導入 | 3,000万円〜数億円 | 基幹システム連携、カスタムモデル開発 |

AIプロジェクトの失敗による損失は1件あたり平均420万〜680万ドル(約6億〜10億円)に達するという調査結果もあります(Pertama Partners)。投資判断にあたっては、AIの技術的な限界を正しく理解し、過度な期待を持たずにPoCから始めることが、コスト効率の面でも重要です。

AIの限界を理解した上で業務への導入を設計する

AI技術の課題把握が導入成功の鍵

AIの限界とフレーム問題を理解した方なら、過度な期待を避けてAI導入を設計できます。220ページの実践ガイドで、AIの限界を踏まえた現実的な業務導入の手順を確認できます。

AIの限界を踏まえた現実的な業務AI導入を計画するなら

フレーム問題やハルシネーションなどAIの技術的限界を正確に理解した方は、過度な期待に振り回されることなく業務へのAI導入を設計できます。「AIにできること」と「人間が担うべきこと」の線引きが明確であるほど、AI導入プロジェクトの成功確率は高まります。

AI総合研究所では、AIの限界を織り込んだ現実的な業務AI導入の実践ガイドを提供しています。220ページの資料で、PoCから段階的に本格導入へ進める手順を確認できます。

AIの限界を正しく理解した今、AI総合研究所のガイドで現実的な業務AI化の計画を立ててみてください。

AIの限界を理解した上で業務への導入を設計する

AI技術の課題把握が導入成功の鍵

AIの限界とフレーム問題を理解した方なら、過度な期待を避けてAI導入を設計できます。220ページの実践ガイドで、AIの限界を踏まえた現実的な業務導入の手順を確認できます。

まとめ

本記事では、AIの限界とフレーム問題の基本概念から、6つの技術的課題、解決に向けた最新の取り組み、企業導入の注意点、投資動向とコスト目安までを体系的に解説しました。

2026年現在、フレーム問題は論理ベースのAIでは技術的に解決されていますが、ニューラルネットワークや現実世界の意思決定においては依然として未解決の課題です。ハルシネーションやブラックボックス問題も含め、AIの限界を正しく理解したうえで活用することが、プロジェクト成功の前提条件となります。

まずは自社の業務課題を明確にし、AIの得意な領域と苦手な領域を見極めたうえで、小規模なPoCから段階的に導入を進めてみてください。AIの限界を把握したうえで適用範囲を絞ることが、成果を出すための第一歩です。