この記事のポイント

ディープフェイク対策は「別チャネルでの本人確認」が最も有効。Ferrari社の事例が証明している

検出ツールはSensity AI(精度98%)を第一候補に。動画検出は精度50%にとどまるため人間の目視と併用すべき

EU AI Act第50条の2026年8月施行に向け、AI生成コンテンツのラベリング体制を今すぐ整備すべき

C2PA Content Credentialsへの対応は必須。Google・Samsung端末がネイティブ対応済みで普及が加速している

日本企業はディープフェイク特化の刑事罰が未整備。既存法(名誉毀損・著作権)での対応には限界があり、自社防御策を先行して構築すべき

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

ディープフェイクは、AIを活用して動画・音声・画像を合成し、実在の人物を精巧に再現する技術です。エンターテインメントや企業研修で活用が進む一方、詐欺被害は2025年に米国だけで11億ドルに達し、日本でもインシデントが前年比243%増加しています。

本記事では、ディープフェイクの技術基盤から被害事例、最新の検出技術、世界各国の法規制まで、生成AIの最新トレンドを踏まえて2026年時点の情報を包括的に解説します。

目次

ディープフェイクとは(2026年最新ガイド)

ディープフェイクは、ディープラーニング技術を用いて人物の動画・音声・画像を合成し、実際には行っていない行動や発言をしているかのように改変する技術です。「Deep Learning(深層学習)」と「Fake(偽物)」を組み合わせた造語であり、2017年にRedditユーザーが有名人の合成動画を公開して以降、生成AIの急速な進化とともに精度は飛躍的に向上しました。2026年現在では、わずか3秒の音声サンプルから85%の精度で声を複製できるレベルに達しています。

以下の表で、2026年時点のディープフェイクを取り巻く現状を整理しました。この表を確認いただくことで、被害規模・検出技術・規制動向の全体像を把握できます。

| 項目 | 内容 |

|---|---|

| 技術基盤 | GAN(敵対的生成ネットワーク)、拡散モデル、オートエンコーダー |

| 2025年被害総額(米国) | 約11億ドル(2024年の3倍) |

| 検出市場規模(2025年→2031年) | 8.5億ドル→72.7億ドル(CAGR 42.8%) |

| 年間インシデント増加率 | 前年比880%増(2024年、Pindrop調査) |

| AI検出精度 | 画像97%、音声89%、動画50%(人間は平均55.5%) |

| 主要規制 | EU AI Act第50条(2026年8月施行)、米TAKE IT DOWN Act(2025年5月施行) |

被害規模は2024年から2025年にかけて3倍に急増しており、Deloitteの予測では2027年までに生成AI関連の不正被害が400億ドルに達するとされています。一方で検出技術も進化し、画像認識AIを活用した検出ツールは画像に対して97%の精度を実現していますが、動画に対しては依然として50%程度にとどまっています。

企業にとって特に深刻なのは、Deepfake-as-a-Service(DaaS)の台頭です。ダークウェブではわずか5ドルで合成ID作成キットが入手可能となり、日本国内でもディープフェイク関連のインシデントが前年比243%増加しています。2025年Q1だけで北米における被害額は2億ドルを超えており、自社の経営層や取引先になりすました詐欺への対策は、業種を問わず急務となっています。

ディープフェイクの技術と生成手法

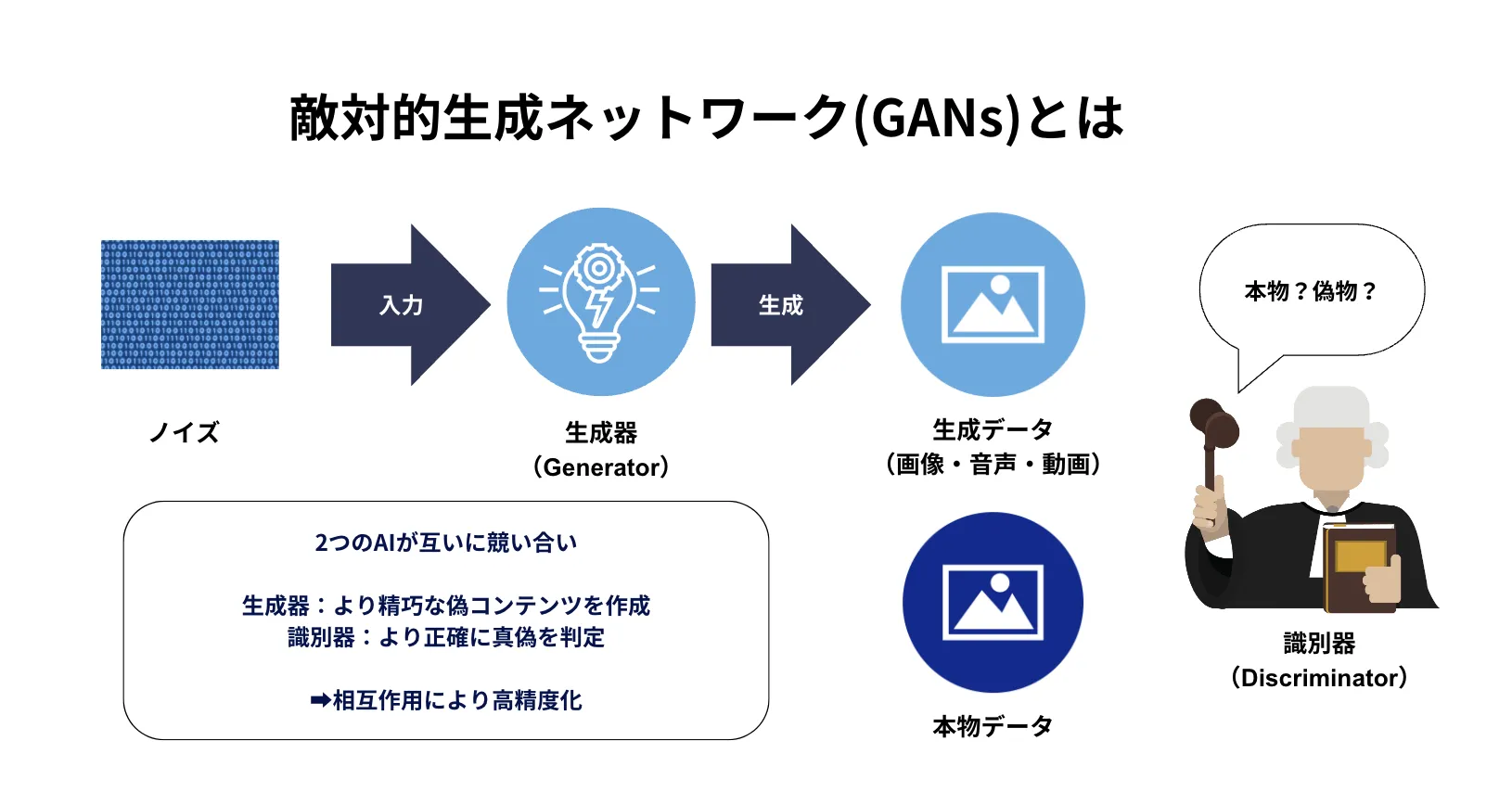

ディープフェイクを生成する中核技術は、敵対的生成ネットワーク(GAN)です。生成器と識別器の2つのニューラルネットワークが互いに競争しながら学習することで、人間の目では判別困難な精巧な合成コンテンツを生成します。GANから派生したStyleGANは、より高精度な画像生成を実現しています。近年はGANに加え、Stable DiffusionやDALL-Eなどの拡散モデル、さらにはボイスクローニング技術も合成コンテンツの生成に広く活用されるようになりました。

ディープフェイクの仕組み

以下の表で、ディープフェイクの主要な生成手法とその特徴を整理しました。手法ごとの精度とコストの違いを把握することで、脅威の実態をより具体的に理解できます。

| 手法 | 技術概要 | 精度 | 生成コスト |

|---|---|---|---|

| フェイスワップ | 人物の顔を別人の顔にリアルタイムで置換 | 高(人間の判別困難) | 無料~50ドル |

| リップシンク | 音声に合わせて唇の動きを自動生成 | 高(自然な口元再現) | 30ドル~ |

| ボイスクローニング | 3秒の音声から話者の声質を複製 | 85%一致(2026年時点で判別不能レベル) | 5ドル~ |

| フルボディ合成 | 全身の動作・表情・音声を統合合成 | 中~高 | 1,000ドル~ |

フェイスワップは最も普及した手法であり、リアルタイムで顔を置き換えることが可能です。以下はApple Vision Proを使用したリアルタイムのフェイスワップデモです。

Apple Vision Pro Deepfake app concept #applevisionpro #apple #visionpro pic.twitter.com/Zx8KVW1uuY

— Jesse Richards (@iamjesserichard) February 3, 2024

次に、リップシンク技術の精度を示す投稿です。音声に合わせた自然な唇の動きが再現されており、視覚的にはほぼ見分けがつきません。

Run a few tests to check whether Act 1 @runwayml uses LivePortrait.

— Stelfie the Time Traveller (@StelfieTT) October 23, 2024

I took one ref video from Act 1 and used it on a version of LP which I modified slightly.

My impression is Act 1 is better, probaly gan the face and handle better the movements pic.twitter.com/ugCJvXuEQt

さらに、ElevenLabsのボイスクローニング技術の事例です。わずかな音声サンプルからリアルな音声が生成され、声のトーンやイントネーションまで高精度に再現されます。

Eleven Multilingual is coming to the platform this week🌎!

— ElevenLabs (@ElevenLabs) April 24, 2023

Generate speech in multiple languages using a single prompt, while maintaining each speaker's unique voice characteristics. Uncover new possibilities for localization, accessibility & creativity.

Listen for yourself… pic.twitter.com/P3ZBCzI2Zw

特筆すべきは、生成コストの急激な低下です。2020年から2024年の間にディープフェイクの制作費用は75%低下しており、ダークウェブでは合成IDキットが5ドル、音声偽造メッセージが30ドル、AI画像生成サービスを悪用した偽画像は10ドル程度で取引されています。この価格破壊が生成AIのセキュリティリスクを一段と深刻化させています。

作成プロセスと主要ツール

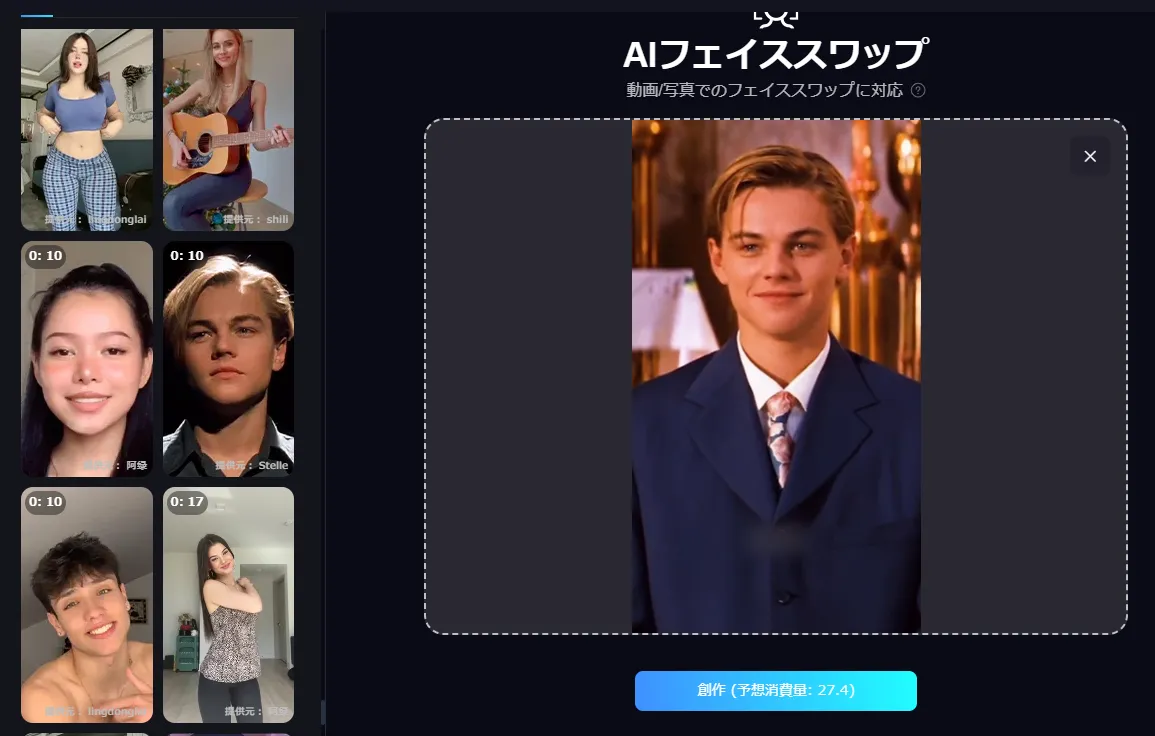

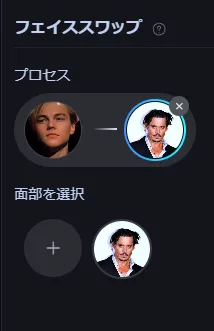

実際のディープフェイク作成プロセスを体験しました。現在の技術では、2枚の素材を用意してボタンを押すだけで精巧な合成動画が完成します。高度な技術知識や専門的なソフトウェアは必要なく、誰でもアクセスできる状態であることが、脅威をさらに深刻にしている要因です。

まず、差し替え元となる画像を用意します。

元となる画像を選択

次に、合成したい人物の顔画像をアップロードします。

変更したい顔画像をアップロード

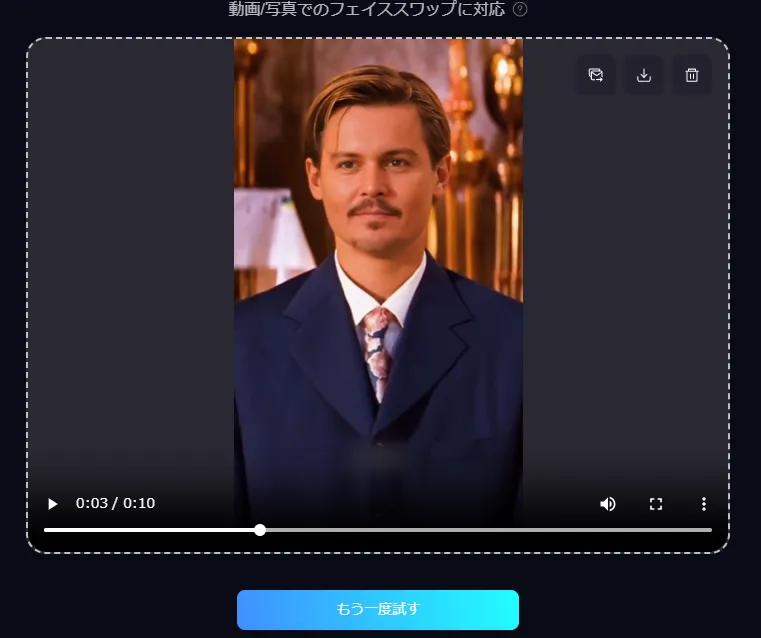

素材の準備後、ワンクリックでディープフェイク動画が完成します。

完成したディープフェイク動画

この手軽さが、ディープフェイクの急速な拡散を後押ししています。技術の理解は防御策の構築に不可欠ですが、ディープフェイクの作成にあたっては倫理的なガイドラインを遵守し、他者の権利を侵害する使用は絶対に避けてください。

被害事例と脅威の実態

ディープフェイクによる被害は金融詐欺から政治的プロパガンダまで多岐にわたり、その規模は年々拡大しています。Sumsub Identity Fraud Report 2025-2026によると、高度な不正手法の割合は2024年の10%から2025年には28%へ急増しており、ディープフェイクは全不正行為の11%を占めています。特にフィンテック分野ではディープフェイク関連インシデントが700%増加しており、暗号資産領域では全検出事案の88%を占めるほど深刻化しています。

以下の表で、2024年から2026年にかけて報告された主要なディープフェイク事件を整理しました。金融詐欺から政治工作まで、被害の多様さと規模の大きさがこの表から読み取れます。

| 事件 | 時期 | 被害額・影響 | 手法 |

|---|---|---|---|

| 英Arup社ビデオ会議詐欺 | 2024年2月 | 2,560万ドル(約40億円) | CFO含む複数幹部のリアルタイム映像合成 |

| Ferrari CEO音声詐欺(未遂) | 2024年7月 | 被害なし(質問で阻止) | CEOの声質・イタリア語訛りを複製 |

| Taylor Swiftフェイク画像 | 2024年1月 | 4,700万回閲覧 | DALL-E 3による性的画像生成 |

| Biden大統領偽ロボコール | 2024年1月 | 100万ドル罰金(通信業者) | AI音声合成で投票抑制を指示 |

| イタリア国防相音声詐欺 | 2025年2月 | 約100万ユーロ(回収済み) | 国防相の声を複製しArmani等を標的 |

| 日本国内ディープフェイク | 2024-2025年 | 243%増加 | 性的画像52万枚超を生成・販売 |

特に深刻なのが、英国の大手エンジニアリング企業Arup社の事件です。香港の財務担当者が、CFOや同僚を含む参加者全員がディープフェイクで構成されたビデオ会議に参加し、1日で15件の送金指示に従い2,560万ドルを送金しました。この事件は、リアルタイム映像合成が複数人を同時に再現できるレベルに達していることを示しています。

一方、Ferrari社の事件は防御に成功した好例です。WhatsAppでCEOの声を模倣した詐欺電話を受けた幹部が、CEOだけが知り得る情報(最近推薦した書籍のタイトル)を質問したところ、詐欺師は回答できずに通話を切りました。この事例は、AIセキュリティ対策においても、最終的には人的な確認プロセスが重要であることを示しています。

政治分野では、2022年のウクライナ侵攻時にゼレンスキー大統領の降伏を呼びかける偽動画が拡散されました。ウクライナ政府は速やかに否定しましたが、紛争下での偽情報の危険性が浮き彫りになりました。

https://x.com/_delanay/status/1504048298520371201?s=20

Surfsharkの調査によると、2021年以降38カ国で選挙期間中にディープフェイクが確認されており、影響を受けた人口は38億人に上ります。インドでは2024年の総選挙でAI生成コンテンツに推定5,000万ドルが投じられ、韓国では500校以上の学校で生徒が同級生の性的ディープフェイクを作成・共有する事件が発生し、最大チャネルには22万人以上のメンバーが参加していました。

エンターテインメントと企業での活用

ディープフェイク技術は、動画生成AIの一種として映画産業でポジティブな活用も進んでいます。故人の演技を再現して物語を完結させたり、俳優を若返らせる用途で実績を重ねています。

映画「ワイルド・スピード SKY MISSION」では、撮影中に事故死した故ポール・ウォーカーの姿をディープフェイク技術で再現し、彼の弟が代役として演じたシーンに合成されました。ファンにとって感動的なクライマックスが実現した事例です。

映画「ローグ・ワン/スター・ウォーズ・ストーリー」では、故キャリー・フィッシャーが演じたレイア姫の若い頃の姿がAI技術で再現されました。物語の一貫性を保つためにこの技術が活用されています。

俳優ブルース・ウィリスは、失語症による引退後もディープフェイク技術を活用した広告に出演しました。この事例はデジタル肖像権(パブリシティ権)の譲渡をめぐる法的議論のきっかけにもなっており、2020年にニューヨーク州で成立した死後のパブリシティ権譲渡法とも密接に関連しています。

ただし、Pew Research Centerの調査では61%の視聴者がAI生成パフォーマンス(特に故人の再現)に不安を感じていると回答しており、AI活用における倫理問題への配慮も欠かせません。2023年のSAG-AFTRAストライキではAIによる「デジタル肖像」の保護が勝ち取られ、2025年までに多くの契約に使用期限・コンテンツ制限・使用ログの開示条項が含まれるようになっています。

企業活用の面では、AIアバター動画プラットフォームのSynthesiaがFortune 100企業の70%以上を含む65,000社以上に導入されており、ARR(年間経常収益)は1億ドルを突破しています。以下の表で、ディープフェイク技術のビジネス活用事例を整理しました。

| 企業・分野 | 活用内容 | 効果 |

|---|---|---|

| DuPont(製造業) | AIアバターによる社内研修動画 | 制作費1本あたり10,000ドル削減、制作時間80%短縮 |

| Zoom(IT) | 製品紹介・チュートリアル動画 | 動画制作時間90%短縮(数日→数時間) |

| BSH(家電) | eラーニングコンテンツ | エンゲージメント30%以上向上 |

| 医療(UC Davis) | ALS患者の音声復元 | 脳コンピューターインターフェースとAI音声合成で失われた声を再現 |

制作コストの観点では、多言語ローカライゼーション(リップシンク翻訳)に71%のブランドが活用しており、ディープフェイクを活用した広告はリコール率が従来動画より23%高いというデータもあります。一方で、消費者の61%が広告におけるディープフェイク使用のラベリングを求めており、透明性の確保が企業にとっての課題となっています。

検出技術と法規制の最前線

ディープフェイクの脅威に対し、検出技術と法規制の両面から対策が急速に進んでいます。個人レベルでは情報源の確認とコンテンツへの批判的思考が基本ですが、AI検出ツールやC2PA規格といった技術的対策、さらに各国の法整備が2025年から2026年にかけて大きく前進しました。

個人レベルの対策

以下の表で、2026年時点の主要なディープフェイク検出ツールを比較しました。ツールごとに対応メディアや精度が異なるため、用途に応じた選定が重要です。

| ツール・技術 | 開発元 | 検出精度 | 特徴 |

|---|---|---|---|

| FakeCatcher | Intel | 96% | 生体信号(血流パターン)を分析、CES 2026でオンデバイス動作を実演 |

| Sensity AI | Sensity | 98% | 映像・音声・メタデータの多層分析、Microsoft Teamsプラグイン連携 |

| Reality Defender | Reality Defender | 95%以上 | マルチモーダル対応、日米ディープフェイク対策チャレンジ優勝 |

| SynthID | Google DeepMind | — | 100億以上のコンテンツにウォーターマーク付与済み、テキスト・画像・動画・音声対応 |

| Universal Detector | UC San Diego | 98% | 生成手法を問わない汎用的な検出(2025年8月発表) |

| NEDO統合システム | 富士通・NEC・NII | — | 偽情報の検知から社会的影響評価までの統合基盤(2026年3月完成目標) |

AI検出ツールは画像ディープフェイクに対して最大97%の精度を達成していますが、動画に対しては50%程度にとどまっています。フロリダ大学の研究(2026年2月)では、AIは画像の検出に優れる一方で動画の検出は苦手であり、人間はその逆のパターン(動画は得意、画像は苦手)を示すことが判明しています。この補完関係を活かした人間とAIの協調的な検証プロセスが、検出精度向上の鍵です。

コンテンツの真正性を証明するC2PA(Coalition for Content Provenance and Authenticity)規格も急速に普及しています。C2PA仕様はv2.2に到達し、Google Pixel 10やSamsung Galaxy S25にはC2PAへのネイティブ対応が搭載されました。Content Authenticity Initiative(CAI)の参加企業は5,000社を超え、Cloudflareが主要CDNとして初めてContent Credentialsの保持に対応したことで、ウェブ全体の約20%をカバーしています。日本国内でもNTTドコモがC2PAを活用した偽情報対策の実証実験を実施し、改ざんコンテンツの識別精度85%以上を達成しました。

ただし、画像認識サービスを含む既存の検出技術にも課題があります。主要SNSプラットフォームはアップロード時にファイルを再エンコードするため暗号署名が破壊されてしまうことが最大の障壁であり、Deepfake-as-a-Service(DaaS)プラットフォームの台頭により技術的知識がなくても精巧な偽コンテンツを生成できる状況が加速しています。Gartnerの予測では、2026年までに30%の企業が従来の本人確認手法を単体では信頼できなくなるとされており、多要素認証と検出ツールの組み合わせが不可欠です。

法規制の世界動向と日本の対応

ディープフェイクに対する法規制は2024年から2026年にかけて世界各国で急速に整備されています。以下の表で主要国の規制状況を比較しました。各国の対応範囲と罰則の差異を確認できます。

| 国・地域 | 法律・規制 | 施行時期 | 主な内容 |

|---|---|---|---|

| EU | AI Act第50条 | 2026年8月 | AI生成コンテンツのラベリング義務化、違反企業に罰則 |

| 米国 | TAKE IT DOWN Act | 2025年5月 | 非同意性的画像の公開を犯罪化、48時間以内削除義務 |

| 米国 | DEFIANCE Act | 2026年1月上院通過 | 性的ディープフェイク被害者に最大25万ドルの損害賠償請求権 |

| 韓国 | 性暴力犯罪特別法改正 | 2024年9月 | 作成・配布は7年以下の懲役、所持は3年以下 |

| 英国 | データ利用法改正 | 2026年2月 | 性的ディープフェイク作成を犯罪化、最大6ヶ月の禁固刑 |

| 中国 | AI生成コンテンツラベリング規則 | 2025年9月 | 明示的・暗黙的ラベリングの二重義務化 |

| 日本 | AI利活用促進法 | 2025年5月 | AI全般の推進法、ディープフェイク特化規定なし |

AI規制法の国際動向において特に注目すべきは、EU AI Act第50条です。2026年8月の施行により、AI生成コンテンツのラベリングが義務化されます。欧州委員会は2025年12月にAI生成コンテンツの透明性に関するCode of Practiceの第1次草案を公表しており、最終版は2026年6月に発表予定です。EU域内でビジネスを展開する企業は、準拠に向けた対応を進める必要があります。

米国ではTAKE IT DOWN Act(2025年5月署名)が連邦レベルで初めてディープフェイクを含む非同意性的画像の公開を犯罪化しました。プラットフォームには通知から48時間以内の削除義務が課されています。さらにDEFIANCE Actが2026年1月に上院を全会一致で通過し、被害者に最大25万ドルの損害賠償請求権を認める法案として下院での審議が進んでいます。

日本については、2025年5月にAI利活用促進法が成立しましたが、ディープフェイクに特化した刑事罰は設けられていません。性的ディープフェイクの処罰には名誉毀損や著作権侵害といった既存法律で対応しているのが現状です。警察庁の調査では、2025年1月〜9月に未成年者を標的とした性的ディープフェイクの被害が79件以上報告されており、加害者の半数以上が同級生であったことが判明しています。生成AIのガイドライン整備を含む包括的な法整備が求められている状況です。

ディープフェイクの未来

MarketsandMarketsによると、ディープフェイクAI市場は2025年の8.5億ドルから2031年に72.7億ドルへ成長する見込みであり、検出技術への投資も加速しています。Europol(欧州刑事警察機構)は2026年までにオンラインコンテンツの最大90%がAI生成になる可能性を指摘しており、今後も検出技術と法規制の両面からの対策強化が不可欠です。

ディープフェイクの理解を業務でのAIリスク管理に活かすなら

ディープフェイクの生成原理と検出技術を理解できたなら、その知識はAI導入時のセキュリティ設計にも直結します。なりすましリスクへの備えや生成コンテンツの真贋判定は、AIを業務に取り入れる企業にとって避けて通れないテーマです。

AI総合研究所では、AIセキュリティを考慮した業務導入の実践手法を220ページのガイドにまとめています。リスクを正しく把握したうえで安全にAIを活用したい方は、ぜひお手に取ってみてください。

ディープフェイクの理解を業務でのAIリスク管理に活かす

AI業務自動化ガイド

ディープフェイクの脅威と対策を把握できたなら、次はリスクを織り込んだ安全なAI導入です。AI総合研究所のAI業務自動化ガイドでは、AIセキュリティを考慮した業務導入の実践手法を220ページで解説しています。

まとめ

ディープフェイク技術は2026年現在、検出市場が2031年に72.7億ドルへ成長する見込みがある一方で、被害額は2027年に400億ドルに達するとの予測もあり、技術の進化と脅威のスピードが同時に加速しています。生成AIの今後を見据え、企業も個人もディープフェイクへの備えを段階的に進めることが重要です。

以下の3ステップで、ディープフェイク対策を始めることを推奨します。

-

ステップ1 検証習慣の確立

重要なビデオ会議や送金指示を受けた際に、別チャネルでの本人確認を必ず実施する仕組みを導入してください。Ferrari社の事例のように、本人だけが知り得る情報による確認が最も効果的です

-

ステップ2 検出・認証技術の導入

C2PA Content Credentialsに対応したツールやSensity AIのような検出サービスの導入を検討してください。生成AIのリスクに対する技術的な防御層を構築することで、人的確認と併せた多層防御が実現できます

-

ステップ3 法規制・業界動向のフォロー

EU AI Act第50条(2026年8月施行)への準拠準備、日本国内の法改正動向、C2PAの生成AI市場における普及状況を定期的に確認し、自社の対策を最新の状態に保ってください