この記事のポイント

ChatGPTの回答を業務判断にそのまま使うのは避けるべき。ハルシネーションは構造的な問題であり、完全には排除できない

数値・日付・固有名詞を含む回答は必ず一次情報で裏取りすべき。特に法務・医療・財務分野では誤情報のリスクが高い

ハルシネーション対策にはプロンプト設計が有効。「根拠を示して」「不明な場合は不明と回答して」と明示するだけで精度が改善する

社内利用ではRAG(検索拡張生成)との併用が最適解。社内ナレッジを参照させることで、根拠のない回答を大幅に抑制できる

ChatGPTを下書きツールとして活用し、人間が最終チェックするワークフローを構築すべき。AI任せの完全自動化はリスクが大きい

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

ChatGPTは強力なAIアシスタントですが、時として誤った情報を提供することがあります。

この記事では、ChatGPTが示す誤情報や嘘、通称「ハルシネーション」について解説します。

なぜChatGPTが誤りを生じさせるのか、その原因を探るとともに、AIの潜在的なリスクへの対処法や、嘘を見抜く方法についても提案していきます。

ChatGPTを安心して利用するための知識を深めていきましょう。

ChatGPTの新料金プラン「ChatGPT Go」については、以下の記事をご覧ください。

ChatGPT Goとは?料金や機能、広告の仕様、Plus版との違いを解説

✅最新モデル「GPT-5.4」については、以下の記事をご覧ください。

GPT-5.4(ChatGPT5.4)とは?使い方や料金、GPT-5.2との違いを徹底解説

ChatGPTの嘘とは?

このChatGPTの"嘘"とは一般的にハルシネーションと呼ばれます。

ハルシネーションとは、ユーザーが入力したプロンプトに対して「実際には存在しない、事実に基づかない情報を生成する現象」を指します。

この用語は英語で「幻覚」を意味する「Hallucination」から来ており、AIがもっともらしい嘘を出力することで、まるで幻覚を見ているかのような状態を表現しています。

人間が幻覚を見るように、AIも「幻覚」を見ているかのような結果を出力するため、この名称が用いられています。

このハルシネーションは、ChatGPTによって生成されたデータが実際のものと異なることにより、正確さや意味のある情報提供を阻害するといった影響があり、問題視されています。

読売新聞によるChatGPT誤情報の記事(出典:読売新聞)

NHKによるChatGPT誤情報の記事 (出典:NHK)

ChatGPTはなぜ嘘をつく?

ChatGPTが嘘を提供する原因としては、大きく分けて以下のようなものが挙げられます。

- 確率的モデルの性質

- データの鮮度

- 読み書きへの特化と他分野の苦手意識

- 学習データの不足

以下では、それぞれのパターンについて、具体的な事例を交えながら詳しく解説していきます。

確率的モデルの性質

ChatGPTは文章を一から作るのではなく、確率の高い言葉を並べることで回答を作成しています。

そこでは正確な情報を伝えることに特化しておらず文脈に違和感のない回答を作成し回答します。

そのため、ユーザーはChatGPTの嘘の回答を、一見すると「間違いのない正しい情報である」と勘違いしてしまうことが多いです。

ここから先は少し専門的な話となりますが、この確率的なモデルにはTransformer(トランスフォーマー)と呼ばれる革新的なデータの処理方法と学習方法が使用されています。

以下の記事で、ChatGPTにも搭載されているTransformer(トランスフォーマー)の仕組みについて詳しく説明しています

ぜひ一読してみてください。

Transformerとは?自己回帰モデルの概要やBERTとの違いを解説 | AI総合研究所

AIと自然言語処理(NLP)に革命をもたらしたトランスフォーマーモデルの基本から応用例、その仕組みと開発モデルについてわかりやすく解説します。

https://www.ai-souken.com/article/transformer-overview

データの鮮度

ChatGPTの回答は過去の大量の学習データをもとに作成されるため、その学習データが最新情報かなどに大きく影響を受けます。

ChatGPTの回答は過去の大量の学習データをもとに作成されるため、その学習データが最新情報かなどに大きく影響を受けます。

最新のGPT-5では学習データが2024年6月まで更新されており、従来のモデルと比べて最新情報への対応が大幅に改善されています。

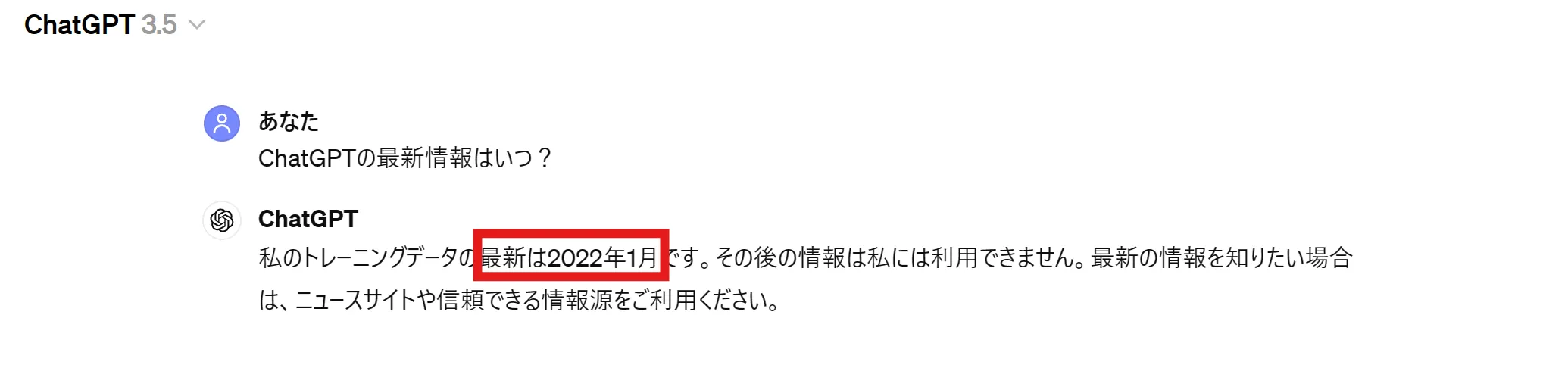

ChatGPTのGPT-3.5の最新情報は2022年1月まで

以下に学習したデータが過去のものであり、現在の情報と一致していない例を示します。

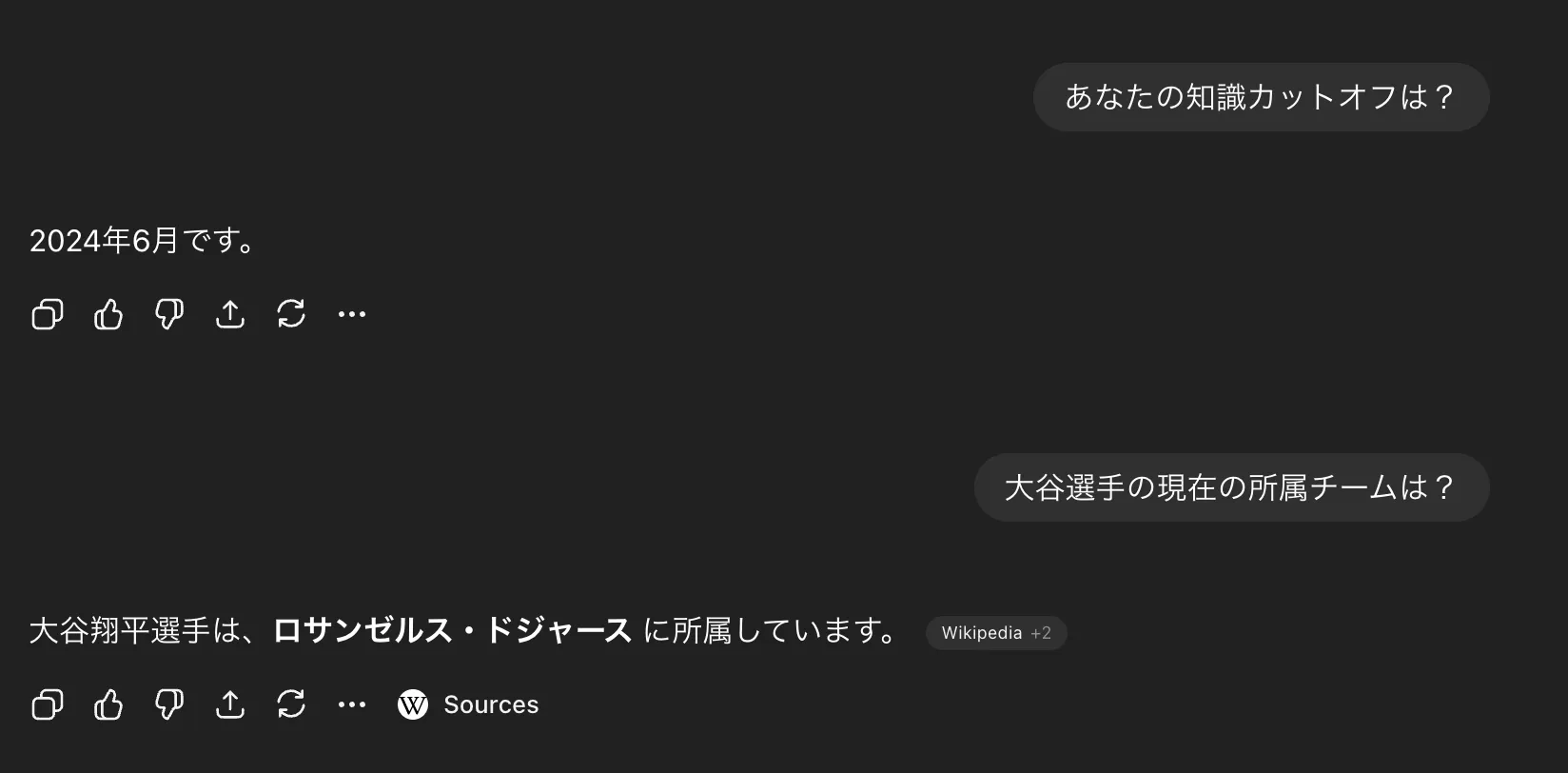

ChatGPTに2024年5月現在の大谷翔平選手の所属チームを尋ねたところ、ロサンゼルス・エンゼルスと回答がありました。

しかし実際に大谷翔平選手は2023年12月にドジャースに移籍しており10年契約を結んでいます。

実際の2024年5月大谷翔平の所属チーム

GPT5になってから再度同じ質問をしたところ、ドジャースに所属していると正しい回答が返ってきました。

GPT5による大谷翔平の所属チームの回答

ソースもついているためカットオフ以上に最新の知見が反映されていることでより精度が高くなっています。

ただし、あくまでインターネットの情報を参考にしているため、スポーツの記録といった結果が刻々と変動する更新が必要な情報ではハルシネーションが起きやすい傾向があります。

読み書きへの特化と他分野の苦手意識

ChatGPTは読み書きが特異な一方で計算といった他の分野は苦手な一面があります。

これはユーザーの求める計算内容の桁数が大きくなると組合せ爆発を起こしてしまい、かなり複雑な言語モデルが必要になるためと考えられています

以下に例を示します。

455×1876という掛け算の答えは、実際に計算機で計算すると「853,580」という値が正しい答えです。

実際に計算機で求めた計算結果

しかし、ChatGPTに計算を頼むと「855,980」という嘘の回答が返ってきました。

ChatGPTによる計算結果

学習データの不足

ChatGPTの莫大な学習データですが、これはすべての事象を網羅しているわけはありません。

一般的でなく、特殊で専門的な情報などはChatGPTの学習データに含まれていない場合が多く嘘の回答を推測で行ってしまう場合があります。

特に地域性のある情報や特定の人物に関する情報は学習データに含まれていない場合が多く嘘の回答が生じることがあります。

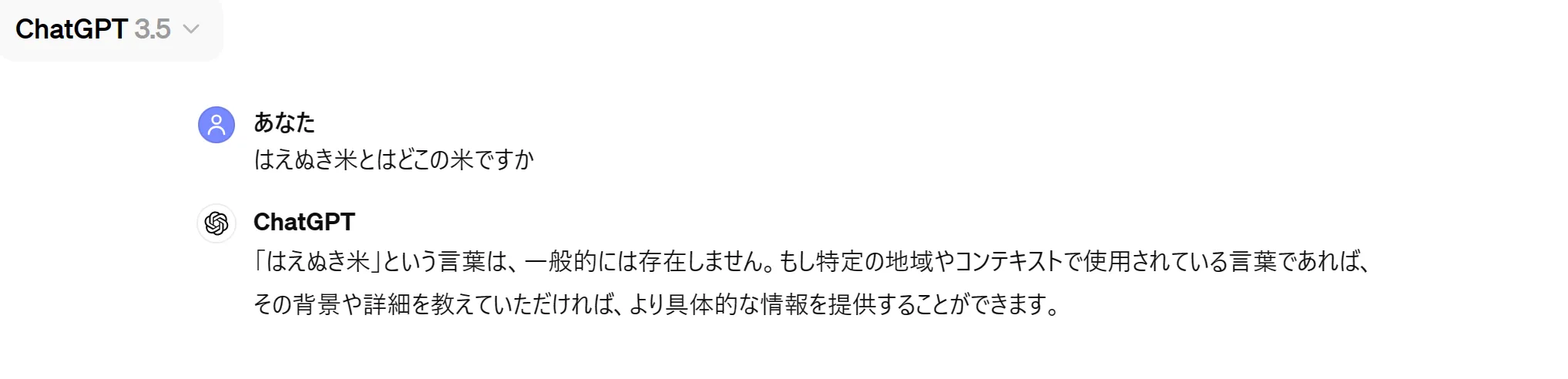

例えば、ChatGPTにはえぬき米とはどこの米ですかと生産を尋ねると、一般的に存在しないという回答が返ってきました。

ChatGPTによるはえぬき米の生産地の回答

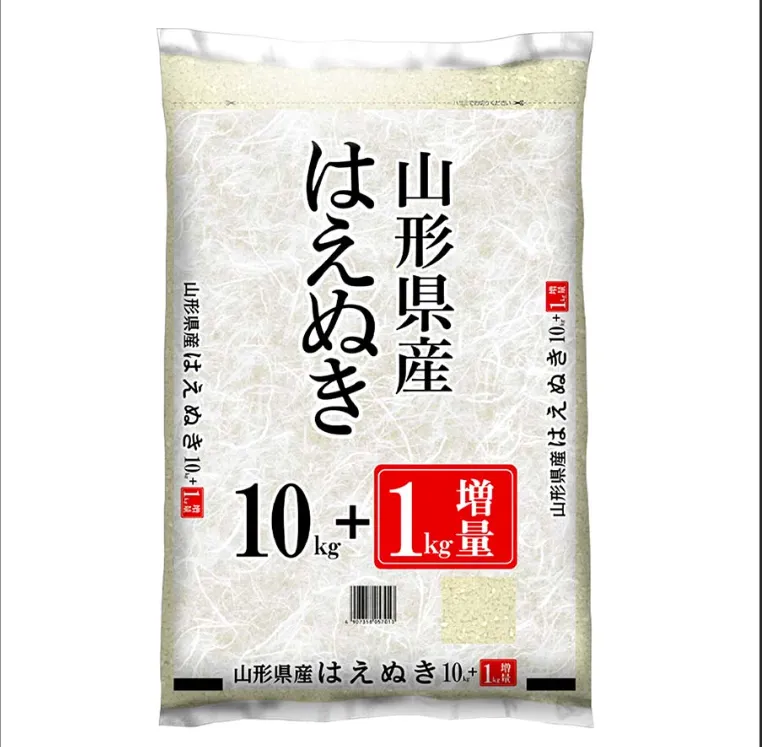

はえぬき米は、山形県の県内で多く消費されている名産品でふるさと納税の返礼品としても人気のお米です。

これはCharGPTが特定の地域に関する情報が学習データに含まれていないために起きた嘘の回答と考えられます。

山形産はえぬき米

このような地域的な情報や専門的な事象については、ChatGPTに正確な回答を求めるよりも、アシスタントや参考程度として使用することが推奨されます。

専門的な情報が必要な場合は、その分野の専門家から直接アドバイスを得るのが賢明でしょう。

ChatGPTによる嘘(ハルシネーション)の例をいくつか紹介しました。

より多くの嘘や誤回答の例を知りたい方は、以下の記事もぜひ読んでみてください。

ChatGPTの嘘を見破るヒントが得られるでしょう。

ChatGPTの誤回答とは?ハルシネーションの原因・具体例・対策を徹底解説 | AI総合研究所

ChatGPTの誤回答(ハルシネーション)の原因をOpenAIの最新研究に基づいて解説。GPT-5.4のハルシネーション33%減少データ、法律分野の裁判所制裁事例206件超、モデル別比較表、7つの対策、料金まで網羅。

https://www.ai-souken.com/article/collection-of-chatgpt-errors

ChatGPTの嘘(ハルシネーション)に対処するための対策

ここからは、このようなChatGPTの嘘への対処について紹介します。

ChatGPTの嘘に適切に対処し、AIを効果的に活用するためには、以下のような点に注意しましょう。

最新の情報を自分で確認する

最新のGPT-5では学習データが2024年6月まで更新されており、従来モデルと比較して最新情報への対応が大幅に改善されています。しかし、それ以降の最新情報は反映されていない可能性があります。 重要な情報については、必ず自分で最新のデータを確認するようにしましょう。

また、Microsoft CopilotやGPT-5のWeb検索機能を備えたAIアシスタントを使用する場合は、最新の情報に基づいた回答が得られる可能性が高くなります。

ただし、Web上の情報も完璧ではないため、やはり重要な情報については複数の情報源を確認し、ファクトチェックを行うことが大切です。

【関連記事】

➡️ChatGPTの学習データはいつまで?最新情報を取得する方法を解説

情報を鵜呑みにしない

ChatGPTの回答には、本記事で紹介したような嘘の情報が含まれることが多くあります。

そのため、ChatGPTの回答をそのまま信じ込むのではなく、常に批判的な目を持つことが重要です。

特に重要な意思決定に関わる情報については、複数の情報源を確認し、ChatGPTの回答の正確性を検証するようにしましょう。

また、専門的な質問については、ChatGPTではなく、その分野の専門家に相談するのが賢明です。専門家は最新の知見を持ち、文脈を踏まえたアドバイスを提供してくれるでしょう。

これらの点に注意しながらChatGPTを使いこなすことで、AIの力を借りつつ、その限界を補うことができるでしょう。

ChatGPTの限界を理解したなら業務でのAI活用を正しく設計する

ハルシネーションの原因と対策を知ることは、AIを業務で安全に活用するための前提知識です。「何をAIに任せるか」「どこに人間のチェックを入れるか」を適切に設計できれば、AIの精度に過度に依存しない業務フローを構築できます。

AI業務自動化ガイドでは、AIの特性を踏まえた業務プロセスへの組み込み方を220ページ超で体系的にまとめています。AI総合研究所がこれまでの導入支援で蓄積した、安全性と効率を両立するAI活用の設計手法をご確認ください。

AIの特性理解を安全な業務AI導入の設計に活かす

220ページ超のAI業務自動化ガイドを無料配布中

ハルシネーションの仕組みと対策を理解したことは、AIを業務で安全に使うための基盤知識です。何をAIに任せ、どこに人間のチェックを入れるかの設計方法を、AI業務自動化ガイドが220ページ超で体系的に解説しています。

まとめ

ChatGPTは、適切に使用することで強力なツールとなり得ますが、その可能性を最大限に引き出すためには、ユーザーの理解と使い方がカギを握ります。

本記事では、ChatGPTの嘘(ハルシネーション)の典型的なパターンとして、ChatGPTが確率的モデルであること、ChatGPTは読み書きに特化していること、ChatGPTの学習データは過去のもの、またChatGPTの学習データの不足といった4つを取り上げ、それぞれの具体例を交えて解説しました。

これらの問題に適切に対処するためには、最新の情報を自分で確認し、ChatGPTの回答を鵜呑みにせず批判的に吟味することが重要です。また、専門的な事象については、ChatGPTではなく専門家の意見を求めるのが賢明でしょう。

なお、最新のGPT-5では、ハルシネーション(幻覚)が従来モデル比で大幅に削減されており、より信頼性の高いAI体験が可能になっています。それでも、AIアシスタントの特性を理解し、適切に活用することが求められています。

ChatGPTの長所と短所を理解し、適切に活用することで、AIの力を借りつつ、その限界を補うことができます。AIアシスタントが日常的になりつつある今、その特性をしっかり理解し、うまく付き合っていくことが求められています。