この記事のポイント

構図・ポーズの精密制御が必要ならControlNetが第一候補で、プロンプトだけでは再現困難な指定をZero Convolution技術で実現すべき

2026年の環境構築はWeb UI Forge+Cannyプリプロセッサから始めるのが最短ルートで、13種のプリプロセッサは用途に応じた使い分けが不可欠

FLUX.1対応ならControlNet Union Pro 2.0、ワークフロー自動化ならComfyUIが最適で、商用利用時はモデルごとのライセンス確認が前提条件

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

ControlNetは、Stable Diffusionに視覚的な条件制御を追加する拡張モデルとして、AI画像生成の精度を飛躍的に高めた技術です。

画像生成AIのプロンプトだけでは難しかった構図やポーズの指定を、参照画像やスケッチから実現します。

2026年現在、ControlNet Union Pro 2.0によるFLUX.1対応、ComfyUIの標準ワークフロー化(60%のワークフローがControlNet使用)、SD 3.5 Large公式ControlNetの登場と、エコシステムは急速に進化しています。

本記事では、Zero Convolutionの技術的背景から13種のプリプロセッサの使い分け、Web UI Forgeでのインストール手順、Cannyを使った実践操作、商用利用の注意点まで、2026年の最新情報を交えて解説します。

目次

ControlNet Union Pro 2.0とComfyUI主導が変えるControlNetの2026年動向

インストールからCannyによる実践操作までのステップバイステップガイド

ControlNetとは(2026最新ガイド)

ControlNetは、Stable Diffusionをベースとした画像生成AIに、より詳細な制御機能を追加する拡張モデルです。2023年初頭にStanford大学のLvmin Zhang氏らの研究チームによって発表され、画像生成AIの制御精度を飛躍的に向上させました。

従来のAI画像生成では、プロンプトによるテキスト指示が主な制御手段でしたが、意図した通りの構図やポーズを得ることは困難でした。ControlNetは、参照画像やスケッチなどの視覚的な条件を追加することで、この課題を解決しています。核となる技術は「Zero Convolution」と呼ばれる特殊な畳み込み層で、追加の学習なしで既存のStable Diffusionモデルに制御機能を組み込むことを可能にしました。

以下の表は、ControlNetの基本情報を整理したものです。技術的な位置づけから2026年の最新動向まで、全体像を把握できます。

| 項目 | 内容 |

|---|---|

| 技術名 | ControlNet(条件付き制御拡張モデル) |

| 開発者 | Lvmin Zhang氏ら(Stanford大学、2023年) |

| ベースモデル | Stable Diffusion 1.5 / SDXL / SD 3.5 Large / FLUX.1 |

| 主な用途 | ポーズ指定、エッジ検出、深度制御、線画生成、セグメンテーション |

| AI画像生成市場 | 4.1億ドル(2025年)から300億ドル(2033年)CAGR 32.5%(Fortune Business Insights) |

| 主要UI | ComfyUI(106,000 Stars、60%がControlNet使用)/ Web UI Forge |

| 2026年注目動向 | ControlNet Union Pro 2.0(FLUX.1対応)、SD 3.5 Large公式ControlNet、IP-Adapter統合 |

AI画像生成市場が2033年に300億ドル規模に達する見通しの中で、ControlNetは構図やポーズの精密制御を担う基盤技術として不可欠な存在となっています。

ControlNetの技術は、以下の3つの仕組みで成り立っています。

-

元のディフュージョンモデルをロック(固定)する

ControlNetでは、Stable Diffusionなどのすでに学習済みのモデルをロックします。数十億枚の画像でトレーニングされた元モデルの知識をそのまま利用するためです。このロックにより、元の画像生成能力を維持したまま制御機能を追加できます。

-

追加の条件を学習するtrainable copy(学習可能なコピー)

元のモデルの各層に「trainable copy」と呼ばれる新しい部分を追加します。このtrainable copyが、ポーズやエッジ情報、深度マップなど、ユーザーが指定した条件を学習し、生成に反映する役割を担っています。

-

Zero Convolution(ゼロ初期化された畳み込み層)による条件の統合

元のモデルとtrainable copyをつなぐために「Zero Convolution」という特殊な1x1の畳み込み層を使用します。最初は重みが0に設定されており、学習の初期段階では元のモデルに何も影響を与えません。学習が進むにつれて重みが増加し、trainable copyで学習された条件情報が元のモデルの出力に自然に反映されていきます。

参考:Adding Conditional Control to Text-to-Image Diffusion Models

ControlNet Union Pro 2.0とComfyUI主導が変えるControlNetの2026年動向

2026年のControlNetエコシステムでは、3つの重要な変化が起きています。第一に、Stability AIがSD 3.5 Large向けの公式ControlNet(Blur、Canny、Depth)を2024年11月に公開しました。SD 3.5 Large(8Bパラメータ)専用モデルとして、Community Licenseのもと商用利用も可能です。

第二に、FLUX.1およびFLUX.2向けのControlNetが急速に整備されています。Shakker-LabsのControlNet Union Pro 2.0は、Canny、Soft Edge、Depth、Pose、Grayを1つのモデルに統合し、モデルごとにファイルをダウンロードする手間を解消しました。XLabs-AIのCanny/Depth/HED(v3)やInstantXのUnionモデルと合わせ、FLUX.1エコシステムでのControlNet活用が本格化しています。

第三に、ComfyUIがControlNet利用の主要プラットフォームとして確立されました。GitHub Stars 106,000(2026年3月時点)、50,000人のDiscord月間アクティブメンバー、2,500,000件の共有ワークフローを有し、全ワークフローの60%がControlNetを使用しています。Web UI Forgeと比較して、ノードベースのワークフロー設計による柔軟なControlNet活用が可能な点が支持されています。IP-AdapterとControlNetを組み合わせた「構造+スタイル」の同時制御や、AnimateDiffとの連携による動画生成など、複合的なワークフローが標準的に利用されるようになっています。

ControlNetのプリプロセッサと使い方

ControlNetの画像制御は「プリプロセッサ(操作ツール)」によって実現されています。プリプロセッサは、元画像からエッジやポーズ、深度などの特徴を抽出して条件情報としてモデルに提供し、生成画像にそれを反映させる役割を担います。以下の表は、主要なプリプロセッサの機能と用途を一覧にしたものです。

| プリプロセッサ | 機能 | 主な用途 |

|---|---|---|

| Canny | エッジ検出、輪郭情報の抽出 | 線画構造に基づく画像生成 |

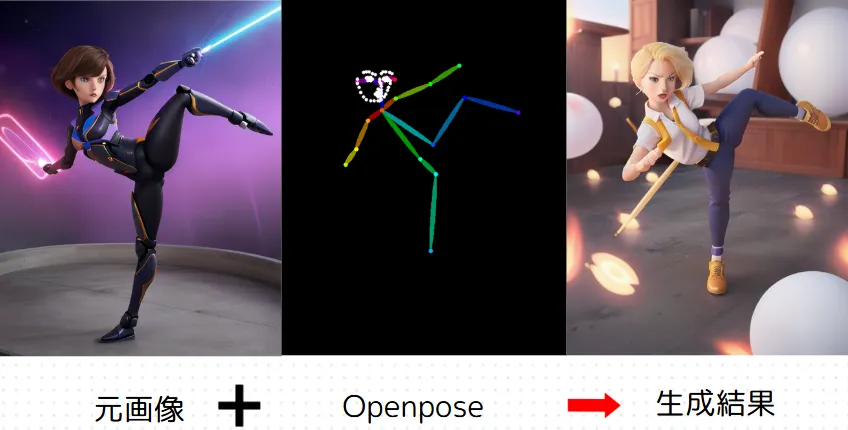

| OpenPose | 人のポーズをスケルトン形式で表現 | キャラクターの構図・姿勢指定 |

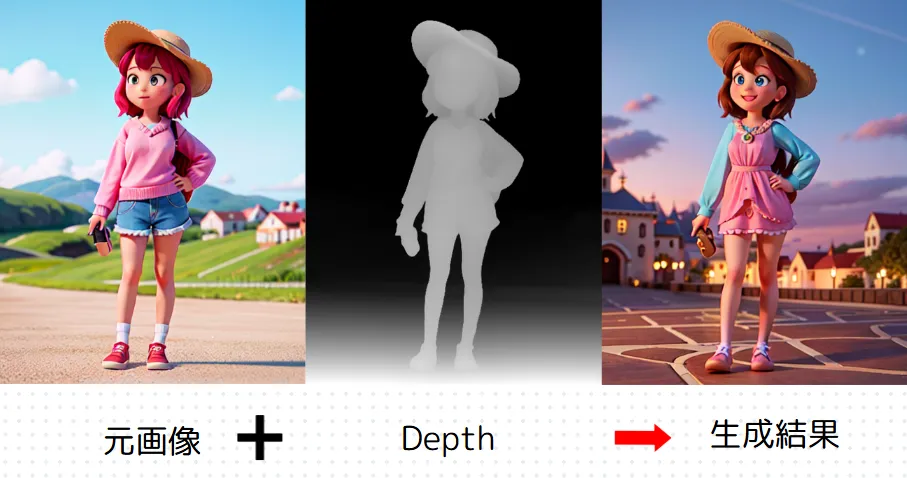

| Depth | 画像の深度(奥行き)情報を抽出 | 立体的な構図、遠近感の再現 |

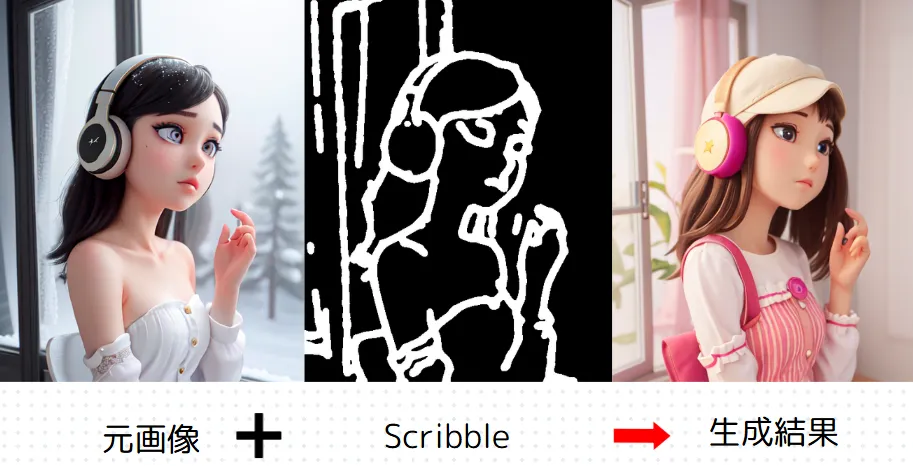

| Scribble | 手書きの落書きや線画から生成 | ラフスケッチベースの画像生成 |

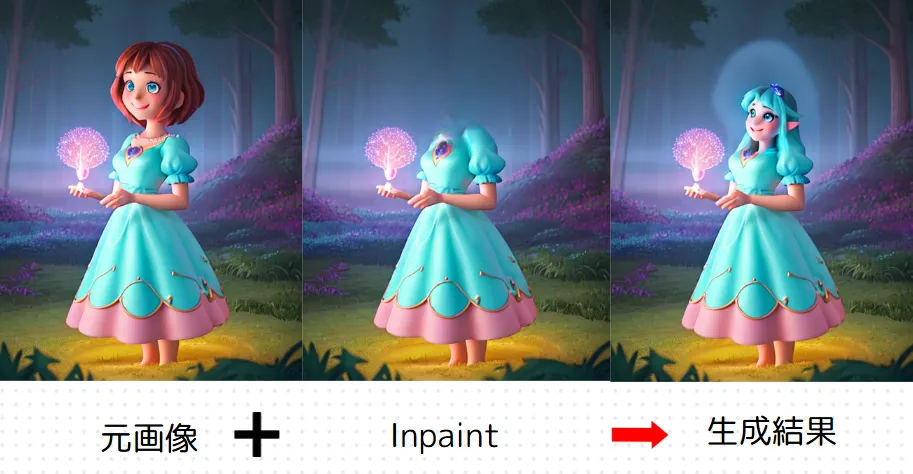

| Inpaint | 画像内の選択範囲を修正・補完 | 部分的な修正、欠損補完 |

| Reference | 元画像のスタイルや色を保持して生成 | スタイル維持での新規生成 |

| MLSD | 直線部分の抽出 | 建築物や構造物の構図生成 |

| Tile | 低解像度画像のアップスケール | 画質維持での画像拡大 |

| LineArt | 線画情報の抽出 | 線画スタイルの画像生成 |

| Normal | 法線マップによる立体表現 | 3D的な陰影表現 |

| Segmentation | 要素ごとの領域分割 | 領域別の条件適用 |

| SoftEdge | 柔らかな輪郭の抽出 | 柔和な輪郭の画像生成 |

各プリプロセッサはControlNetの事前処理として機能し、目的に応じた特徴抽出を行います。OpenPoseはキャラクターのポーズ指定に、Depthは立体感のある構図制御に適しています。

以下の画像は、各プリプロセッサによる出力例です。

OpenPose例

OpenPose例

Depth例

Depth例

Inpaint例

Inpaint例

Tileはアップスケール用途、LineArtは線画スタイルの生成に適しており、用途に応じて最適なプリプロセッサを選択することが重要です。

インストールからCannyによる実践操作までのステップバイステップガイド

Stable Diffusion Web UI Forgeへのインストール手順

Stable Diffusion Web UI Forgeをまだインストールしていない場合は、上記リンク先の記事を参照してください。ForgeにはControlNet自体がすでに組み込まれているため、使用したい機能に合わせたモデルをインストールするだけで利用を開始できます。

まず、Hugging FaceのPythonライブラリをインストールします。

pip install huggingface_hub

次に、モデルを一括インストールするためのPythonスクリプトを作成します。

nano download_controlnet.py

編集画面が開いたら、以下のスクリプトを貼り付けてください。

from huggingface_hub import snapshot_download

# ダウンロード設定

snapshot_download(

repo_id="comfyanonymous/ControlNet-v1-1_fp16_safetensors",

revision="main",

allow_patterns="*.safetensors",

local_dir="/home/azureuser/stable-diffusion-webui-forge/models/ControlNet"

)

保存したPythonファイルを以下のコマンドで実行します。Pythonファイルを作成したディレクトリで実行する必要があります。

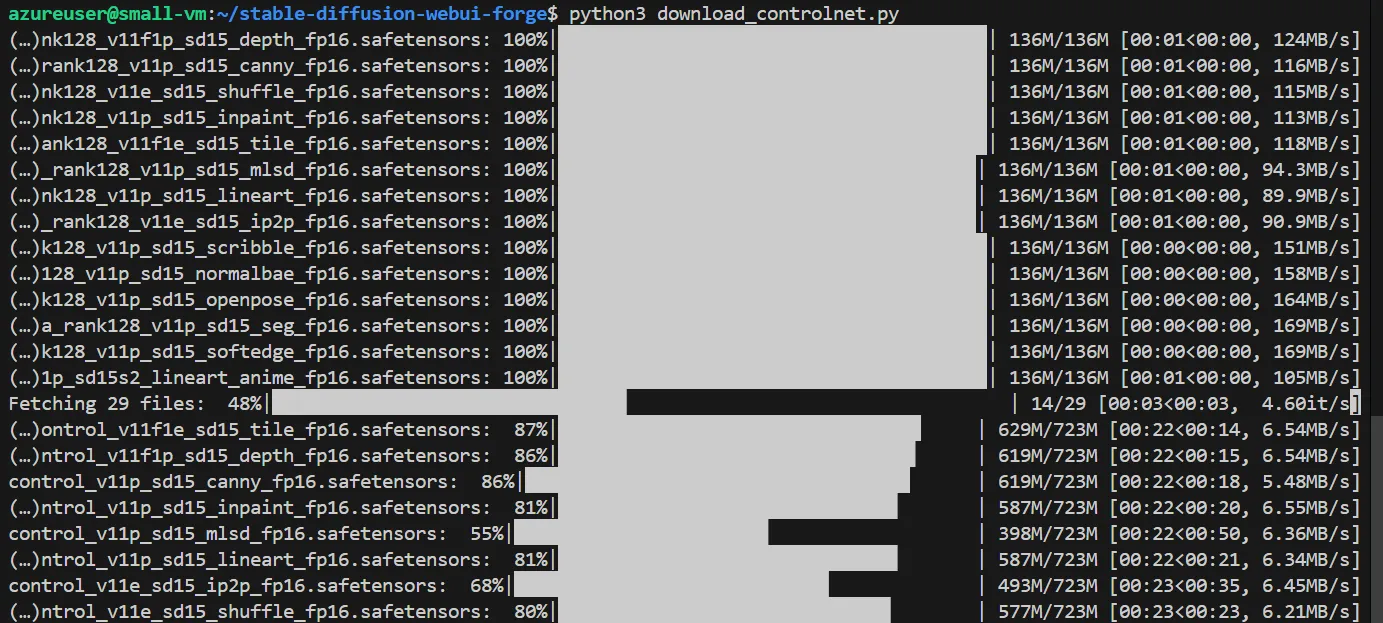

python3 download_controlnet.py

ControlNetのモデルインストール中の画面

ControlNetのモデルインストール中の画面

インストールが完了したら、ControlNetを使用する準備は整いました。

ControlNetの基本操作とCannyを使った実践例

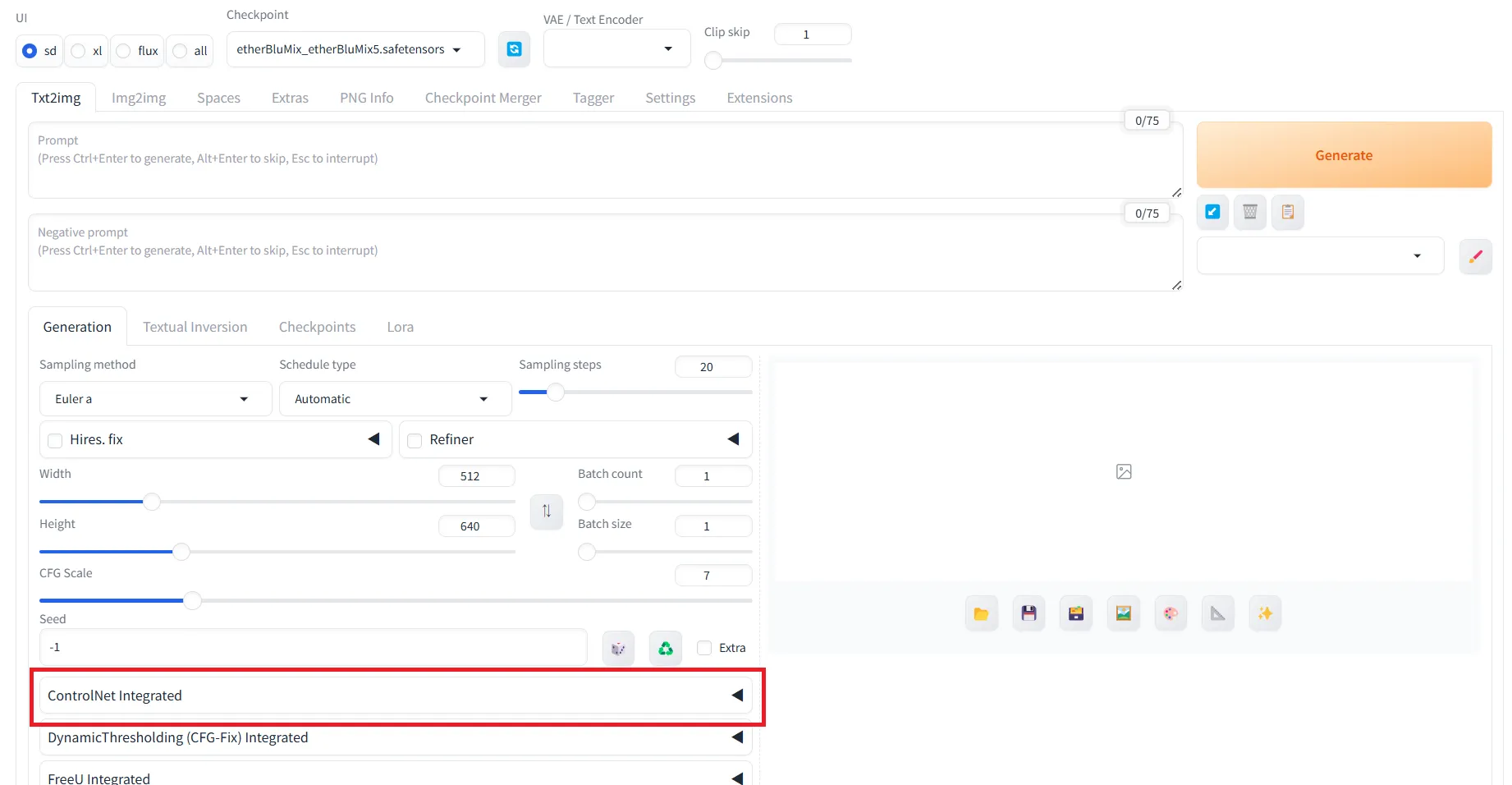

ControlNetはForgeの画面下部に表示される「ControlNet Integrated」から使用します。

ControlNet Integratedの表示

ControlNet Integratedの表示

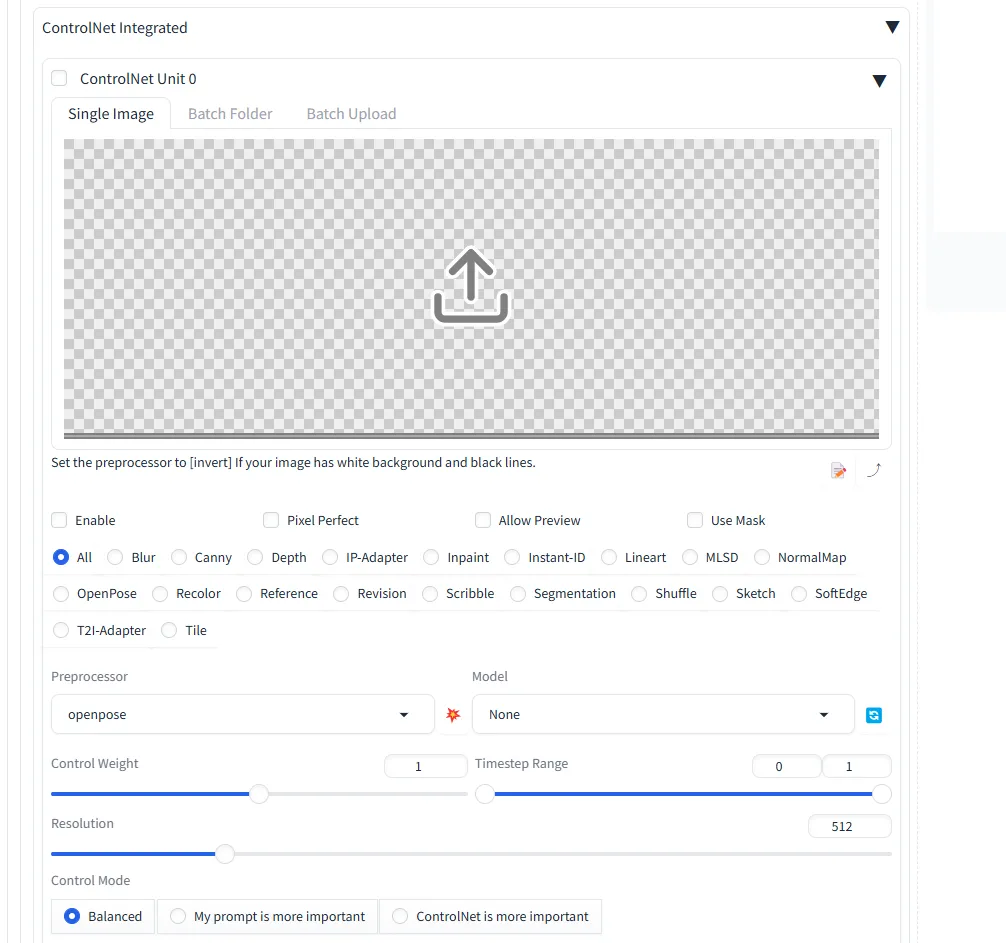

ControlNet Integratedは以下のような構成になっており、写真の添付やモデルの設定を行うことでControlNetを使用できます。

ControlNet Integratedの中身

ControlNet Integratedの中身

ControlNetの使用手順は以下の4ステップです。

まず、使用したい写真をアップロードします。

写真のアップロード

写真のアップロード

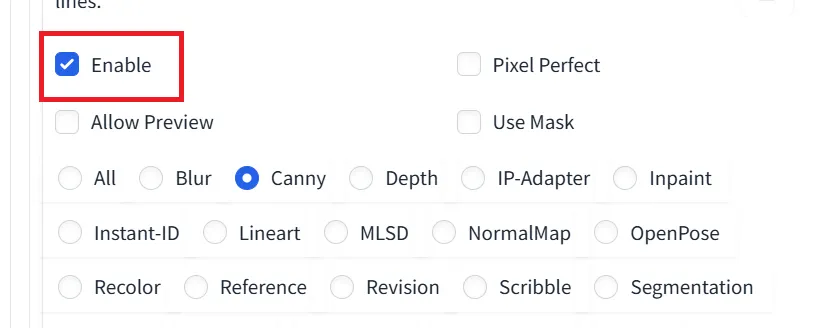

次に、「Enable」にチェックを入れます。

Enableへのチェック

Enableへのチェック

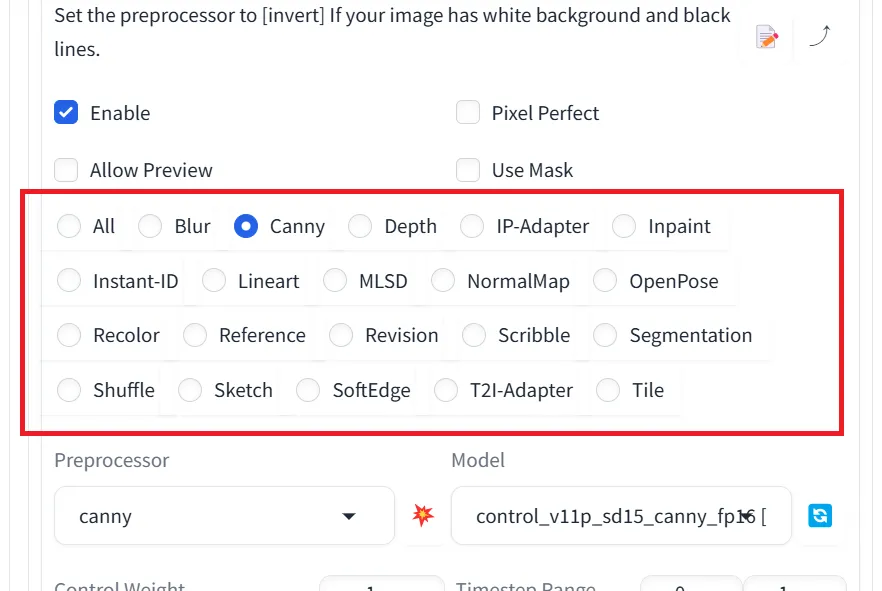

ControlNetの中で使用したい機能を選択します。

使用したい機能の選択

使用したい機能の選択

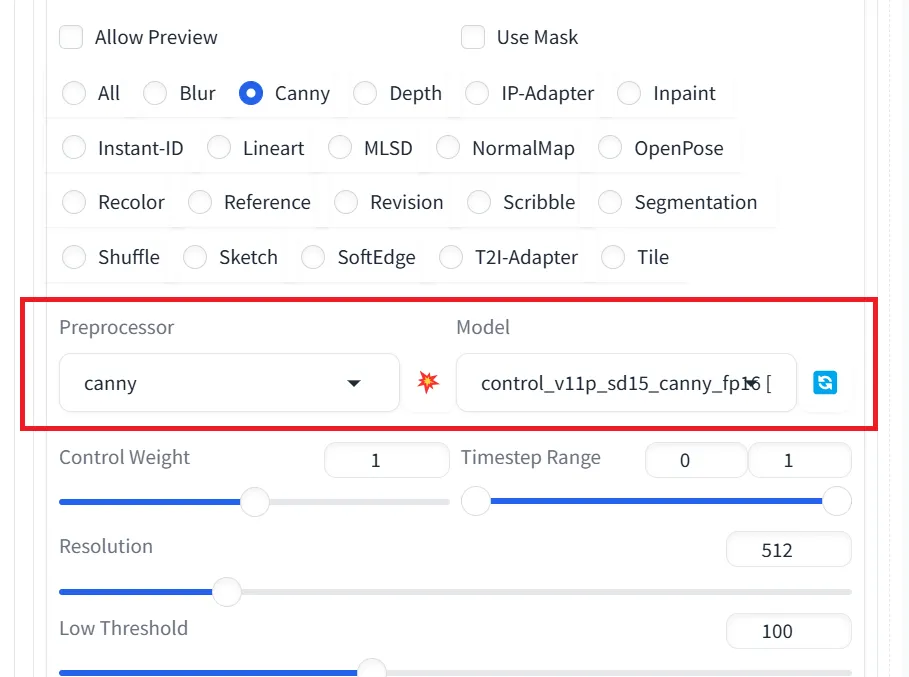

最後に、選択した機能に対応するPreprocessorとModelのファイルを選択します。

PreprocessorとModelの選択

PreprocessorとModelの選択

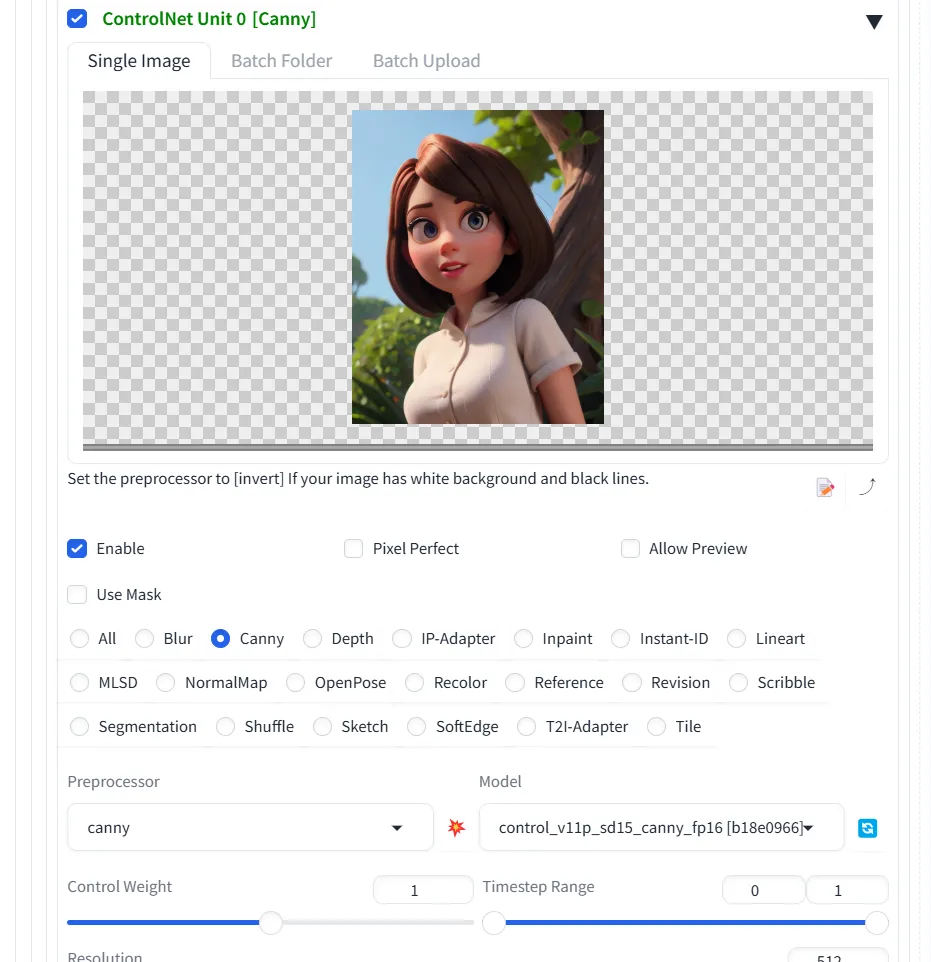

ここではCannyを設定して画像生成を行います。以下のように設定が完了しました。

Cannyの設定紹介

Cannyの設定紹介

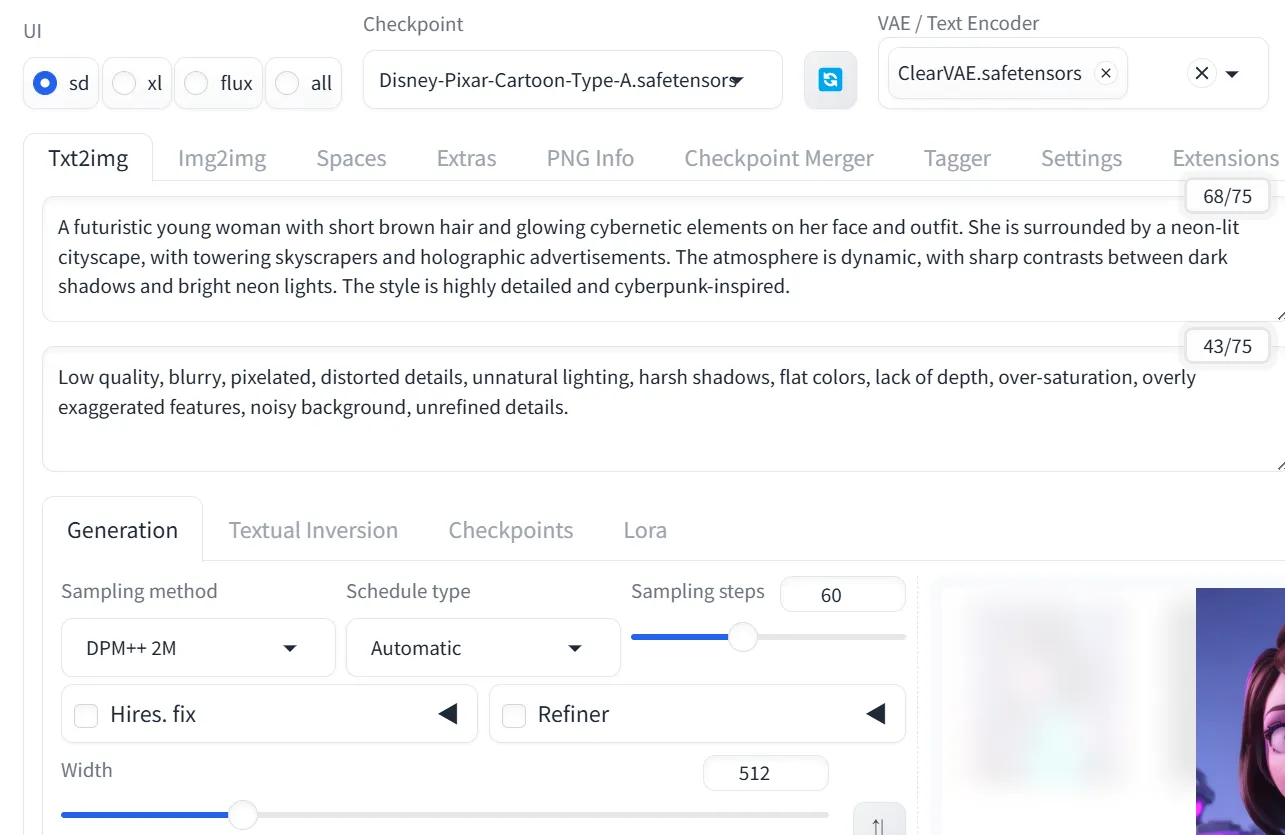

サイバーパンク風になるようにプロンプトを記述し、通常通りの設定を行います。

Canny生成時の画面

Canny生成時の画面

実行すると、以下のような画像が生成されました。

Cannyの実行例

Cannyの実行例

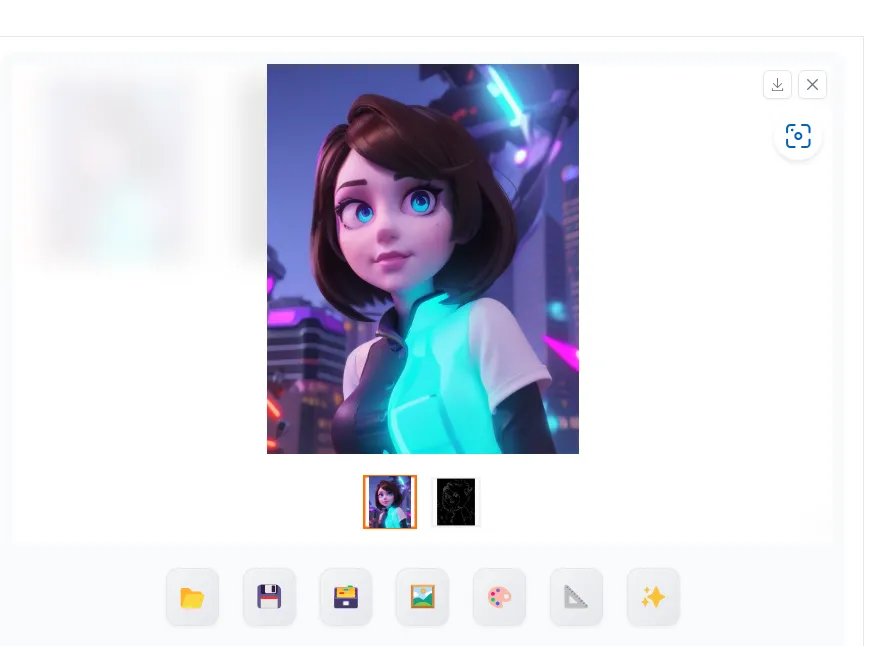

生成結果の表示部分を見ると、2つの画像が表示されています。左側が今回の生成結果、右側がCannyによって抽出された線画です。

Canny生成時の出力部分

Canny生成時の出力部分

Cannyによって抽出された線画

Cannyによって抽出された線画

最終的な生成の流れは以下の通りです。元画像からCannyがエッジを検出し、その線画情報をControlNetがStable Diffusionに条件として渡すことで、構図を維持したまま新しいスタイルの画像を生成します。

Cannyの生成の流れ

Cannyの生成の流れ

パラメータ設定のポイント

ControlNetを効果的に使用するためには、以下のパラメータの調整が重要です。

-

Control Weight

ControlNetが生成結果にどの程度影響を与えるかを調整するパラメータです。値が高いほどControlNetの条件が強く反映され、低いほどプロンプトの影響が大きくなります。

-

Timestep Range

ディフュージョンモデルの生成プロセスのどの段階でControlNetの影響を適用するかを設定します。序盤のステップに適用すると構図全体に影響し、終盤に適用するとディテールに影響します。

-

Pixel Perfect

入力画像のサイズと生成される画像の解像度を自動的に調整するオプションです。有効にすることで、解像度の不一致による品質低下を防止できます。

ControlNetの活用事例と他ツール比較

ControlNetはさまざまなクリエイティブ分野での活用が広がっています。以下に代表的な活用領域を紹介します。

イラスト制作では、OpenPoseでキャラクターのポーズを指定し、Depthモデルと組み合わせて自然な立体感を持つキャラクターを作成できます。背景制作においても、Cannyエッジで構図を制御し、Segmentationで領域ごとの条件を適用することで、複雑な背景を効率的に生成できます。

写真編集では、Depthモデルで遠近感を再構成し、Normalマップで光源や陰影を調整することが可能です。プロンプトを利用してアニメ風や水彩画風に変換するスタイル変換にも活用されています。LoRAと組み合わせることで、特定のスタイルを維持しながら構図を制御する高度な生成も実現できます。

映画やゲームのコンテンツ制作では、シナリオに基づいたシーンの構成やキャラクターの動きをAIに制御させ、プロトタイプ映像の迅速な生成が進んでいます。AnimateDiffとControlNetを組み合わせたComfyUIワークフローにより、構造的な一貫性を保った短尺動画の生成も可能になっています。

ControlNetとIP-Adapter/ChatGPT画像生成の使い分けと選定基準

2026年現在、AI画像生成の制御技術はControlNet以外にも多様な選択肢があります。以下の表は、主要な画像制御技術の特徴を比較したものです。

| 項目 | ControlNet | IP-Adapter | ChatGPT画像生成 |

|---|---|---|---|

| 制御方式 | 構造制御(エッジ/ポーズ/深度) | スタイル制御(参照画像のスタイル転写) | プロンプト(テキスト指示) |

| 精密さ | 高い(構図・ポーズを精密に指定) | 中程度(スタイルの方向性を指定) | 低い(テキストのみで制御) |

| 操作難易度 | 高い(UIの理解とパラメータ調整が必要) | 中程度(参照画像の選定が重要) | 低い(テキスト入力のみ) |

| 対応モデル | SD 1.5 / SDXL / SD 3.5 / FLUX.1 | SD 1.5 / SDXL / FLUX.1 | GPT Image(クローズドモデル) |

| 組み合わせ | IP-Adapterと併用可能 | ControlNetと併用可能 | 単独使用のみ |

| コスト | 無料(ローカル実行) | 無料(ローカル実行) | 有料(APIまたはサブスクリプション) |

構図やポーズを厳密に制御したい場合はControlNet、参照画像のスタイルを活かしたい場合はIP-Adapter、手軽にテキストから画像を生成したい場合はChatGPTの画像生成が適しています。ComfyUIではControlNetとIP-Adapterを同時に使用する「構造+スタイル」の同時制御ワークフローが標準的に利用されており、おすすめモデルと組み合わせることで高品質な画像生成が可能です。ネガティブプロンプトの適切な設定と合わせて活用することが推奨されます。

画像生成AIの制御技術から組織のAI導入設計へ

ControlNetによる精密な条件制御を理解したことで、AIは「指示に従って正確に動かせる技術」であるという実感が得られたのではないでしょうか。この「AIを業務要件に合わせて制御する」という視点は、画像生成に限らず組織の業務プロセス全体にも直結します。

AI総合研究所では、Microsoft環境でAI業務自動化を段階的に進めるための実践ガイド(220ページ)を無料提供しています。部門別のユースケースをBefore/After付きで解説し、PoC→全社展開までの具体的なロードマップを収録しています。

AI総合研究所が、AI技術の知見を組織全体の業務効率化につなげる道筋を設計からサポートします。

画像生成の制御技術を業務設計へ活かす

段階的なAI導入の実践ガイド(220p)

ControlNetによる画像生成の細かな制御を理解した次は、AIを組織の業務フローに組み込む段階設計です。Microsoft環境でAI業務自動化を段階的に進める220ページの実践ガイドで、画像生成に限らないAI導入の全体像をご確認ください。

ControlNetの商用利用ガイドと導入の展望

ControlNetを商用目的で使用する場合は、法的な考慮事項とライセンスの確認が重要です。2025年5月に成立したAI推進法(2025年9月施行)では、AI生成物に関するソフトローアプローチが採用されていますが、著作権については依然として慎重な確認が必要です。以下の表は、商用利用時に確認すべき事項を整理したものです。

| 確認事項 | 詳細 | 対策 |

|---|---|---|

| ベースモデルのライセンス | モデルにより商用利用の可否が異なる | 商用利用可能なモデルを選択 |

| 学習データの権利処理 | データセットの利用規約と著作権の確認 | 権利処理済みデータを使用したモデルを選定 |

| 出力結果の権利帰属 | AI生成物の著作権は原則として発生しない | 人間の創作的寄与が認められる範囲を確認 |

| ControlNetモデル自体のライセンス | Apache 2.0(ControlNet 1.1)、Community License(SD 3.5) | 使用するモデルごとにライセンスを確認 |

| 文化庁ガイドライン | AIと著作権チェックリスト(2024年7月公表) | 開発・学習段階と生成・利用段階の2段階で確認 |

文化庁のガイドラインでは、AI生成物は原則として著作権の保護対象とならないとされていますが、人間の「創作的寄与」が認められる場合には著作権が発生する可能性があります。商用利用を検討する際は、ベースモデルのライセンスと学習データの権利処理を必ず確認してください。

段階的導入ステップとFAQ

ControlNetの導入は、以下の3ステップで段階的に進めることが効果的です。

-

ステップ1 Cannyによる基本操作の習得(1から2週間)

Web UI ForgeまたはComfyUIをインストールし、Cannyプリプロセッサを使った基本的な画像生成を習得します。Control Weightやタイムステップの調整を繰り返し、ControlNetの動作原理を体感的に理解します。

-

ステップ2 複数プリプロセッサとIP-Adapterの組み合わせ(2から4週間)

OpenPose、Depth、Scribbleなど複数のプリプロセッサを使い分け、用途に応じた最適な制御方法を習得します。IP-Adapterとの併用による「構造+スタイル」の同時制御も試し、ワークフローの幅を広げます。

-

ステップ3 FLUX.1対応とワークフロー最適化(1から3か月)

ComfyUIでのノードベースワークフロー構築に移行し、ControlNet Union Pro 2.0を活用したFLUX.1ベースの高品質画像生成を実践します。AnimateDiffとの連携による動画生成など、高度な活用にも挑戦します。

以下は、ControlNetに関してよくある質問への回答です。

-

ControlNetはどのStable Diffusionモデルに対応していますか

SD 1.5向けのControlNet 1.1が最も成熟しており、SDXL向けにはControlNet Unionが利用可能です。SD 3.5 LargeにはStability AIの公式ControlNet(Blur/Canny/Depth)が提供されています。FLUX.1向けにはXLabs-AI、InstantX、Shakker-LabsのControlNetモデルが利用できます。

-

ComfyUIとWeb UI Forgeのどちらを使うべきですか

初学者にはWeb UI Forgeの直感的なインターフェースが適しています。ControlNetとIP-Adapterの組み合わせや複雑なワークフローを構築したい場合は、ノードベースのComfyUIが柔軟性に優れています。2026年現在、ComfyUIのGitHub Starsは106,000に達し、プロフェッショナルの主要プラットフォームとなっています。

-

ControlNet Union Pro 2.0とは何ですか

Shakker-Labsが開発したFLUX.1-dev向けの統合ControlNetモデルです。Canny、Soft Edge、Depth、Pose、Grayを1つのモデルに統合しており、個別のモデルファイルをダウンロードする手間を省けます。

-

ControlNetで生成した画像は商用利用できますか

ControlNet自体のライセンス(Apache 2.0)は商用利用を許可していますが、使用するベースモデルのライセンスによって制限が異なります。SD 3.5 Large ControlNetはStability AI Community Licenseで商用利用可能です。出力結果の著作権については、文化庁のAIと著作権チェックリストに沿って確認することが推奨されます。

-

ControlNetの学習に必要なGPUスペックはどの程度ですか

推論(画像生成)にはVRAM 8GB以上のGPUが推奨されます。SDXL向けControlNetの利用には12GB以上、FLUX.1向けには16GB以上が目安です。ControlNeXtのような軽量版モデルでは、学習パラメータを最大90%削減できるため、より少ないリソースでの運用も可能になりつつあります。

画像生成AIの制御技術を組織の業務活用に広げるなら

ControlNetによる画像生成の細かな制御を理解した今、個別ツールの使いこなしに留まらず、AIを組織の業務プロセスへどう組み込むかの段階設計が次のステップです。

AI総合研究所では、Microsoft環境でのAI業務自動化を段階的に進めるための実践ガイド(220ページ)を無料で提供しています。Copilot Chat→M365 Copilot→Copilot Studioと積み上げる導入ロードマップ、経費精算・請求書処理・人事など部門別のBefore/AfterとKPIを収録しており、画像生成に限らないAI活用の全体像を描けます。

AI総合研究所が、画像生成AIの技術理解を組織全体のAI導入設計へつなげる道筋を提示します。

画像生成の制御技術を業務設計へ活かす

段階的なAI導入の実践ガイド(220p)

ControlNetによる画像生成の細かな制御を理解した次は、AIを組織の業務フローに組み込む段階設計です。Microsoft環境でAI業務自動化を段階的に進める220ページの実践ガイドで、画像生成に限らないAI導入の全体像をご確認ください。

まとめ

本記事では、ControlNetの技術的背景から13種のプリプロセッサの使い分け、Web UI Forgeでのインストール手順と実践操作、商用利用の注意点まで解説しました。

ControlNetの価値は、以下の3点に集約されます。

-

Zero Convolution技術による高精度な画像制御

元のモデルの品質を維持したまま、ポーズ・構図・深度といった視覚的条件を精密に制御できるControlNetは、プロンプトだけでは実現できない画像生成を可能にします。

-

FLUX.1対応とComfyUI主導のエコシステム拡大

ControlNet Union Pro 2.0によるFLUX.1対応、SD 3.5 Large公式ControlNet、IP-Adapterとの統合と、2026年のエコシステムは急速に進化しています。FLUX.1 Kontextのようなマルチモーダル画像編集モデルとControlNetの併用も広がりを見せており、ComfyUIでの「構造+スタイル」同時制御ワークフローが標準となっています。

-

商用利用を含む実務的な活用基盤の整備

AI推進法の施行と文化庁のガイドライン公表により、商用利用の法的枠組みが整備されつつあります。ライセンスの確認と権利処理を適切に行うことで、クリエイティブ業務におけるControlNetの活用を安心して進められます。