この記事のポイント

低遅延・オフライン・プライバシーの3要件が揃う現場ではエッジAIを第一候補にすべき

実務ではエッジ単独よりクラウドとのハイブリッド構成が最適。学習はクラウド、推論はエッジが基本

導入の成否はハードウェア選定よりも運用設計(モデル更新・監視体制)で決まる

ローカルLLMは小規模検証には有効だが、品質・電力・セキュリティの制約を見極めてから本番適用すべき

コスト判断は機器単価ではなくTCO(開発・更新・監視の運用費込み)で行うのが鉄則

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

エッジAIは、カメラやセンサー、スマホなど「データが生まれる現場」でAI推論を実行するアプローチです。クラウドに送らずに判断できるため、低遅延・プライバシー・オフライン耐性を同時に重視する業務で効果を発揮します。

一方で、端末の計算資源制約、モデル更新、デバイス管理といった運用の難しさがあり、クラウドAIと同じ感覚で進めるとつまずきやすいのも事実です。

本記事では、エッジAIの定義からクラウドAIとの違い、活用事例、生成AI(ローカルLLM)との関係、導入手順、コストの考え方まで、2026年時点の観点で整理します。

目次

エッジAIとは

エッジAIとは、データ生成源に近い位置、つまりエッジ(端末・センサー・現場のゲートウェイ等)でAI推論を実行する考え方です。

これまでのAIは、データをクラウドやデータセンターに集めて処理する形が一般的でした。一方エッジAIでは、データを送らずに現場で判断できるため、低遅延・プライバシー・オフライン耐性といった要件に対応しやすくなります。

なお、エッジAIで主に指すのは「学習」ではなく「推論」です。大量データと計算資源が必要な学習はクラウドで行い、学習済みモデルを現場に配布して推論する、という役割分担が基本になります。

エッジAIとエッジコンピューティングの関係

エッジコンピューティングは「クラウドの手前(現場側)で計算・保存・通信を行う」考え方です。エッジAIは、その中でも特にAI推論を現場側に寄せたものと捉えると理解しやすいでしょう。

同じエッジでも、スマホのようなオンデバイスから、工場内の小型サーバー(エッジサーバー)まで幅があるため、「どこまでをエッジとするか」はシステム設計で変わります。

学習と推論の役割分担

エッジAIは、現場に近いほどリアルタイム性に強くなりますが、計算資源や電力の制約も厳しくなります。よくある設計として、多くのシステムでは次のように役割を分けます。

- 現場(エッジ) 推論、一次判定、データのフィルタリング

- クラウド 学習、モデル評価、全体最適の分析、モデル配布・管理

この設計により、必要なデータだけをクラウドへ送って運用できるため、通信量やデータ保護の観点でもメリットが出やすくなります。

エッジAIが注目される理由

ここでは、法人でエッジAIが採用されやすい理由として、主なメリットを現場要件に直結する観点で整理します。

- 低遅延・リアルタイム処理

画像・音・センサーデータをその場で処理でき、ライン停止や安全制御など即時性が求められる業務に向きます。

- 通信量・クラウド負荷の削減

すべてを送らず、必要なイベントや特徴量だけを送信できるため、帯域・保存・クラウド処理のコストを最適化できます。

- プライバシー・データ主権への対応

生データを外部に出さずに処理できるため、個人情報や機密情報を扱う領域で設計しやすくなります。

- オフライン/不安定回線でも動く

工場・建設現場・移動体など、回線品質が保証できない環境でも、機能を維持できます。

ただし、後述するように「運用(更新・監視・セキュリティ)」の難しさも増えるため、メリットとセットで設計することが重要です。

エッジAIとクラウドAIの違い

エッジAIとクラウドAIは、ともに人工知能技術を使用しますが、処理がどこで行われるかという点で大きな違いがあります。

クラウドAIはデータセンターやクラウド上で処理するのに対し、エッジAIは現場の端末や近接サーバーで直接処理します。クラウドAIの強みは計算パワーとデータ統合で、複雑なモデルや大規模データに基づく分析を得意とします。

一方で、データ転送の遅延や通信コスト、データ持ち出し制約などにより、リアルタイム処理や機密データの扱いで課題になることがあります。

【関連記事】

➡️クラウドAIとは?エッジAIとの違いやメリット、主要サービスを解説

エッジAIは、データが生成される場所に近いところで処理が行われるため、レスポンスタイムを短縮しやすく、即時性が求められる業務に向きます。また、生データを外部へ送らずに済む設計にしやすい点も重要です。

どちらが優れているかではなく、要件に合わせて使い分けるのが実務の基本です。まずは比較表で整理します。

| 観点 | エッジAI | クラウドAI |

|---|---|---|

| レイテンシ | 低遅延にしやすい | 通信を挟むため不利になりやすい |

| 回線依存 | 低い(オフラインも設計可能) | 高い(送受信が前提になりやすい) |

| 計算資源 | 端末制約がある | 大規模な計算資源を使える |

| データ保護 | 生データを外に出さない設計がしやすい | データ送信や保管が前提になりやすい |

| 運用 | デバイス管理が難しい | 集中管理しやすい |

この表を踏まえると、リアルタイム性とデータ保護が強いほどエッジAI寄り、全社横断での学習や大規模分析が中心ならクラウドAI寄りに設計すると判断しやすいです。

クラウドAIとエッジAIの連携

多くのケースでは、エッジAIとクラウドAIは互いに補完し合い、連携して動作することで最大の価値を提供します。エッジAIが一次判定とリアルタイム応答を担い、クラウドAIが学習・全体分析・モデル配布を担うイメージです。

例えば設備保全では、エッジAIが異常の兆候を検知して即時アラートを出し、クラウド側で長期データを集約して予測モデルを改善する、といった分担が現実的です。

エッジAIの代表的な構成

エッジAIという言葉は幅が広く、設計次第で「推論の実行場所」が変わります。代表的には、次の3層で整理できます。

- オンデバイスAI

スマホ・PC・カメラ・機器内で推論します。レイテンシとプライバシーに強い反面、モデルサイズや電力・熱の制約が大きいです。

- エッジサーバー(ゲートウェイ)

現場の小型サーバーや産業用PCで推論します。複数端末の処理を集約しやすく、管理もオンデバイスよりは集中しやすくなります。

- クラウド

学習や大規模推論、全社横断の分析を担当します。モデル更新はしやすい一方で、遅延とデータ送信の課題が出ます。

このどこに推論を置くかは、レイテンシ要件、データ保護、運用体制、コストのバランスで決めるのが実務的です。

実現を支える技術要素

2026年時点の観点で整理すると、エッジAIを成立させるには、ハードウェア・モデル最適化・運用の3点セットが必要になります。

- ハードウェア(AIアクセラレータ)

スマホやAI PCで普及が進むNPU、組み込み向けGPU、産業向け加速カードなど。

- モデル最適化

量子化・蒸留・枝刈りなどにより、精度と速度、電力のバランスを取ります。

- 推論ランタイム/SDK

端末向けの推論環境を選びます。例えばGoogleのLiteRT(旧TensorFlow Lite)、AppleのCore ML、ONNX Runtime、OpenVINO、NVIDIA TensorRTなどが代表例です。

- 運用(監視・更新・セキュリティ)

モデルの更新配布、デバイスのパッチ適用、ログ収集、ドリフト監視などを前提に設計します。

要するに、エッジAIはモデルだけでなく、端末と運用を含めた仕組みづくりまでセットで考える必要があります。

【参考(一次ソース)】

➡️Google LiteRT 公式ドキュメント

➡️Apple Core ML 公式ドキュメント

➡️ONNX Runtime 公式ドキュメント

➡️OpenVINO 公式ドキュメント

➡️NVIDIA TensorRT 公式ドキュメント

➡️NVIDIA JetPack 公式ドキュメント

【関連記事】

➡️NPUとは?その必要性やGPU・CPUとの違いをわかりやすく解説

➡️NVIDIA Jetsonとは?主な特徴や性能比較、活用事例をわかりやすく解説

エッジAIの活用事例

エッジAIは「現場で即時判断したい」領域で強みが出ます。ここでは代表例を、業界別に整理します。

スマートフォン・PC

スマホやAI PCでは、端末上で完結するオンデバイスAIとして、カメラ画像の認識、音声の文字起こし、翻訳、迷惑通話の判定などの機能が増えています。

最近は生成AIも端末側に寄りつつあり、例えばGoogle Pixelシリーズのように、端末側でのAI処理を前提にした設計も一般化しています。

![]()

Google Pixel

【関連記事】

➡️Geminiとは?その概要や日本語での使い方、料金体系を徹底解説

製造

製造業では、スマートファクトリーの取り組みとして、外観検査、異常検知、予知保全など、ミリ秒単位の判断が求められる工程が多く、エッジAIとの相性が良い領域です。

例えば設備の振動や音、画像を現場で解析し、異常兆候を検出してライン停止や保全判断につなげます。クラウドと組み合わせる場合でも、まずはエッジ側で必要なイベントだけを抽出し、集約分析やモデル改善はクラウド側で行う設計が現実的です。

【関連記事】

➡️異音検知AIとは?その仕組みやメリット、実際の活用事例を解説!

モビリティ

モビリティ領域では、ADASや自動運転支援のために、車載カメラやLiDARなどのセンサーデータをリアルタイムに処理し、危険回避や運転支援に活用します。車両は常に安定した回線があるとは限らないため、基本は車載(エッジ)で推論し、クラウドには学習データや分析結果を送る形になりやすいです。

ヘルスケア

ウェアラブルや在宅見守りでは、心拍、睡眠、行動などのデータを端末側で解析し、異常兆候を早期に検知します。個人情報の塊でもあるため、できるだけ端末側で処理し、必要な指標だけを共有する設計が有効です。

都市インフラ

都市インフラの監視カメラや交通管理では、映像のリアルタイム解析が価値に直結します。現場側で人物や車両を検知し、混雑や事故兆候を検出したうえで、必要な情報だけをセンターに集約することで、コストとレイテンシのバランスを取りやすくなります。

エッジAIと生成AI

エッジAIと生成AIの融合は、2026年における大きな潮流です。端末や現場サーバーで生成AIを動かせれば、プライバシーを守りつつ高速に応答でき、クラウドに依存しない業務体験を作りやすくなります。

これを可能にする技術がローカルLLMです。ローカルLLMは、クラウドではなくユーザー端末や社内エッジサーバー上で直接動作する大規模言語モデルを指します。

ローカルLLMは、当初は高性能GPUが前提でしたが、軽量モデルや量子化の進展、NPUの普及により、用途を絞ればオンデバイスでも実用になりつつあります。

軽量ローカルLLMの例(Phiシリーズ)

【参考(一次ソース)】

➡️Microsoft Research: Phi-3 Technical Report

➡️Azure: Phi

ローカルLLMでできること

ローカルLLMは「外部に出せない情報がある」「応答を速くしたい」領域で価値が出ます。代表例は次の通りです。

- 社内文書の要約や分類(機密文書を外に出さない)

- 端末内データを使ったアシスタント(メール下書き、議事メモ、問い合わせ一次対応など)

- 画像・音声などの現場データと組み合わせた説明生成(点検記録、作業報告の自動化など)

まずはこのような「機密性×応答速度」の用途から検討すると、価値が出やすいです。

できないこと・注意点

クラウドと同じ感覚で使うとつまずきやすいため、ローカルLLMの制約も押さえておきましょう。

- 品質差

大規模モデルと比べると、難易度が高いタスクで精度差が出やすいです。

- 電力・熱

端末で高頻度に推論すると、バッテリー消費や熱設計がボトルネックになります。

- セキュリティ

端末が侵害されると、モデルや入力データが漏えいするリスクがあります。暗号化や権限設計が重要です。

- 幻覚対策

ローカルでも誤回答は起きます。業務で使う場合は、根拠提示やルールベース併用などの設計が必要です。

業務適用では、用途の限定とガードレール設計を前提に進めましょう。

生成AIをエッジで使う実装パターン

現実的には、次のようなハイブリッドが成功しやすいです。

- 端末側は小型モデルで「分類・抽出・短い文章生成」を担当する

- 難しい生成や長文はクラウド側にフォールバックし、利用条件(機密度・回線状況)で切り替える

この切り替え設計により、体感速度と安全性を確保しつつ、品質も担保しやすくなります。

今後は、推論ランタイムの整備やモデル最適化の進展により、オンデバイス生成AIの適用範囲がさらに広がると考えられます。ただし「すべてを端末で完結させる」よりも、要件に合わせてエッジとクラウドを使い分ける設計が、当面は現実的です。

エッジAI導入時の課題と注意点

エッジAIは多くのメリットを提供しますが、導入を成功させるには「制約」と「運用」を最初から織り込む必要があります。代表的な課題を整理します。

- 計算資源と熱設計の制約

端末側はCPU/GPU/NPUやメモリ、消費電力に上限があります。モデルの軽量化や推論頻度の最適化が必要です。

- デバイス管理と更新の難しさ

端末台数が増えるほど、ソフトウェア更新、モデル配布、設定管理が難しくなります。OTA更新や資産管理が前提になります。

- セキュリティとコンプライアンス

端末の物理盗難、改ざん、サプライチェーンリスクなど、クラウドとは違う攻撃面が増えます。ログや権限、暗号化設計が必須です。

- データ断片化と品質管理

現場ごとにデータが分断されると、学習データの偏りや再現性の問題が起きます。データ定義と収集設計が重要です。

- モデル劣化(ドリフト)

現場環境が変わると精度が落ちます。監視と再学習の運用を最初から組み込みましょう。

これらを踏まえると、エッジAIは「作って終わり」ではなく、運用まで含めてシステムとして設計することがポイントになります。

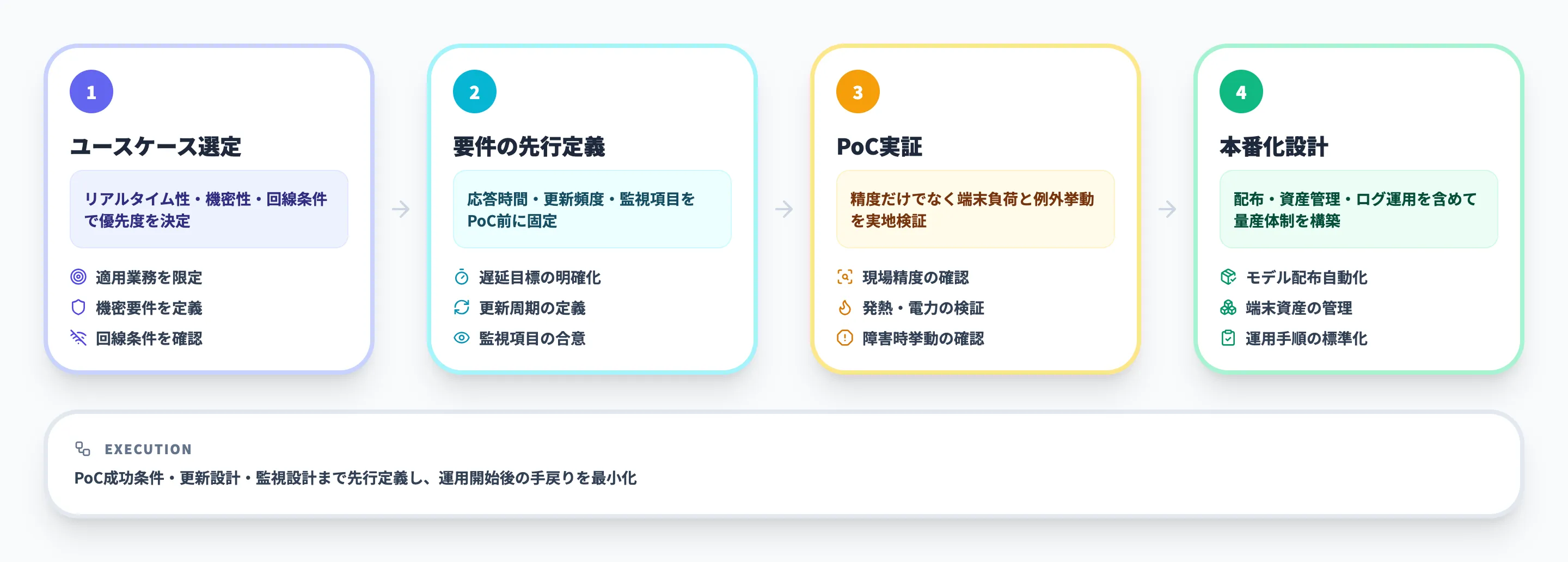

エッジAI導入の進め方

最後に、エッジAIを実務導入する際の基本手順を整理します。ポイントは「最初に運用要件まで決める」ことです。

1. ユースケース選定

まず「なぜクラウドではなくエッジなのか」を言語化します。例えば次の条件に当てはまるほど、エッジAIの優先度が上がります。

- リアルタイム性が重要(安全、品質、停止ロス削減など)

- 生データを外部へ出せない(個人情報、機密)

- 回線が不安定、またはオフラインが前提

これらの条件が揃うほど、エッジAIの投資対効果が出やすくなります。

2. データと運用要件を先に決める

PoCの前に、最低限次を決めておくと手戻りが減ります。

- 推論の応答時間(何ミリ秒以内が必要か)

- 更新頻度(モデルをどれくらいの周期で更新するか)

- 監視項目(精度劣化、端末障害、セキュリティイベントなど)

ここが曖昧だと、PoCは成功しても本番で運用が破綻しやすくなります。

3. PoCで検証し、本番要件へ落とす

PoCでは「精度」だけでなく、現場で使えるかを検証します。特に次は見落としがちです。

- 実環境での精度(照明・ノイズ・設置角度などで精度が落ちる)

- 端末負荷(電力・発熱・スループット)

- 例外時の挙動(回線断、再起動、更新失敗)

実環境での再現性が確認できたら、本番要件に落とし込みます。

4. 本番化まで含めて設計

本番では、モデルの配布と更新、端末の資産管理、ログ収集までが要件になります。運用が回らないと、精度劣化やセキュリティ事故が起きやすくなるため、ここを最初から予算と体制に組み込むことが重要です。

エッジAIの料金・コストの考え方

エッジAIは「月額いくら」のSaaSとは違い、ハードウェアと運用を含む総コスト(TCO)で考える必要があります。ここでは、見積りで抜けやすい項目を整理します。

コストの内訳

エッジAIのコストは「端末代」だけではありません。代表的には次の要素で構成されます。

- ハードウェア費

端末・カメラ・センサー・ゲートウェイ・エッジサーバー、予備機、保守。

- 開発費

データ収集、モデル開発、組み込み実装、現場検証、UI/連携開発。

- 運用費

監視、更新配布、セキュリティ対応、再学習、障害対応、端末交換。

- クラウド費(ハイブリッドの場合)

学習、集約分析、ログ保管、モデル配布基盤。

特に運用費は後から増えやすいので、最初から見積りに入れておくのが安全です。

見積りのポイント

エッジAIは台数が増えるほど運用が効いてきます。TCOで判断するために、見積りでは次の観点が重要です。

- 端末1台あたりのライフサイクル(故障率、交換周期、保守体制)

- モデル更新の頻度と手間(更新が多いほど運用費が効く)

- 「送らない」ことで減るコスト(通信、保存、クラウド処理)と、増えるコスト(端末管理)のバランス

台数が増えるほど、仕組み化(監視・更新・資産管理)の効果が出ます。

コストを抑える実践ポイント

最後に、費用対効果を出しやすい打ち手を挙げます。

- ユースケースを絞って始める(リアルタイム性や機密性が高い領域から)

- モデルを小さくする(推論頻度や入力解像度も含めて最適化する)

- 端末管理と更新の仕組みを早期に作る(後回しにするとスケールで破綻しやすい)

コスト最適化は「小さく始めて運用を作り、伸びるところに投資する」のが基本です。

エッジの現場知見を組織全体のAI活用に広げるなら

エッジAIの導入で「どこで推論し、どこにデータを置くか」を設計した経験は、組織全体のAI業務自動化を進めるうえでも大きなアドバンテージになります。現場の要件定義からインフラ選定、運用設計まで一通り経験しているからこそ、次は組織規模でのAI導入設計に踏み出すタイミングです。

AI総合研究所では、Microsoft環境でのAI業務自動化を段階的に進めるための実践ガイド(220ページ)を無料で提供しています。Copilot Chatの導入から始め、M365 Copilot、Copilot Studio、Microsoft Foundryへと段階的にスケールする設計手順を、部門別のBefore/After・KPI付きユースケースとともに解説しています。エッジで培った「小さく始めて運用を作る」アプローチは、このガイドが提案する段階的導入プロセスとも共通する考え方です。

AI総合研究所の専任チームが、現場AIの経験を組織のAI導入戦略に接続するところまで支援します。まずはガイドで、自社の業務にどう段階設計を組み立てるかをご確認ください。

現場AIの知見を組織のAI導入設計に活かす

エッジからクラウドまで段階的に設計する

エッジAIで得た現場要件の理解を、組織全体のAI業務自動化に発展させませんか。Microsoft環境での段階的な導入設計と部門別ユースケースを220ページの実践ガイドで解説しています。

まとめ

本記事では、エッジAIの定義からクラウドAIとの違い、活用事例、生成AI(ローカルLLM)との関係、導入手順、コストの考え方まで整理しました。

エッジAIは、低遅延・プライバシー・オフライン耐性といった現場要件に強い一方で、計算資源制約やデバイス管理、セキュリティなど「運用の難しさ」が増えます。

成功の近道は、エッジにする理由が明確なユースケースから始め、エッジとクラウドの役割分担を設計し、監視と更新まで含めてTCOで判断することです。これらを押さえれば、エッジAIは現場の効率化と新しい価値創出につながる強力な選択肢になります。