この記事のポイント

この記事ではMicrosoft AzureのAIセキュリティ強化とリスク軽減に関する取り組みを紹介しています。

生成AIの脅威に対抗するために、Microsoftは新しいセキュリティツールの導入と多層的な防御戦略を実装しています。

監修者プロフィール

坂本 将磨

Microsoft AIパートナー、LinkX Japan代表。東京工業大学大学院で技術経営修士取得、研究領域:自然言語処理、金融工学。NHK放送技術研究所でAI、ブロックチェーン研究に従事。学会発表、国際ジャーナル投稿、経営情報学会全国研究発表大会にて優秀賞受賞。シンガポールでのIT、Web3事業の創業と経営を経て、LinkX Japan株式会社を創業。

AIのセキュリティ環境は日々進化し、新たなリスクや脅威に迅速に対応する必要があります。特にクラウドプラットフォーム上で動作するAI技術は、悪意を持った攻撃に晒されることがあり、これに適切に対処することが極めて重要です。

本記事では、マイクロソフトがAzureにおいて取り組む、生成AIのセキュリティ強化とリスク軽減戦略についてご紹介します。新しいセキュリティツールの導入から、オープンソースコミュニティへの貢献、さらには一般社会に対する情報提供と啓蒙活動に至るまで、Microsoftが展開する多角的なアプローチを解説していきます。

安全なAI活用のために重要な知識と情報を得たい方々に、この記事が実践的なヒントを提供します。

Microsoft AzureにおけるAIセキュリティ強化の取り組み

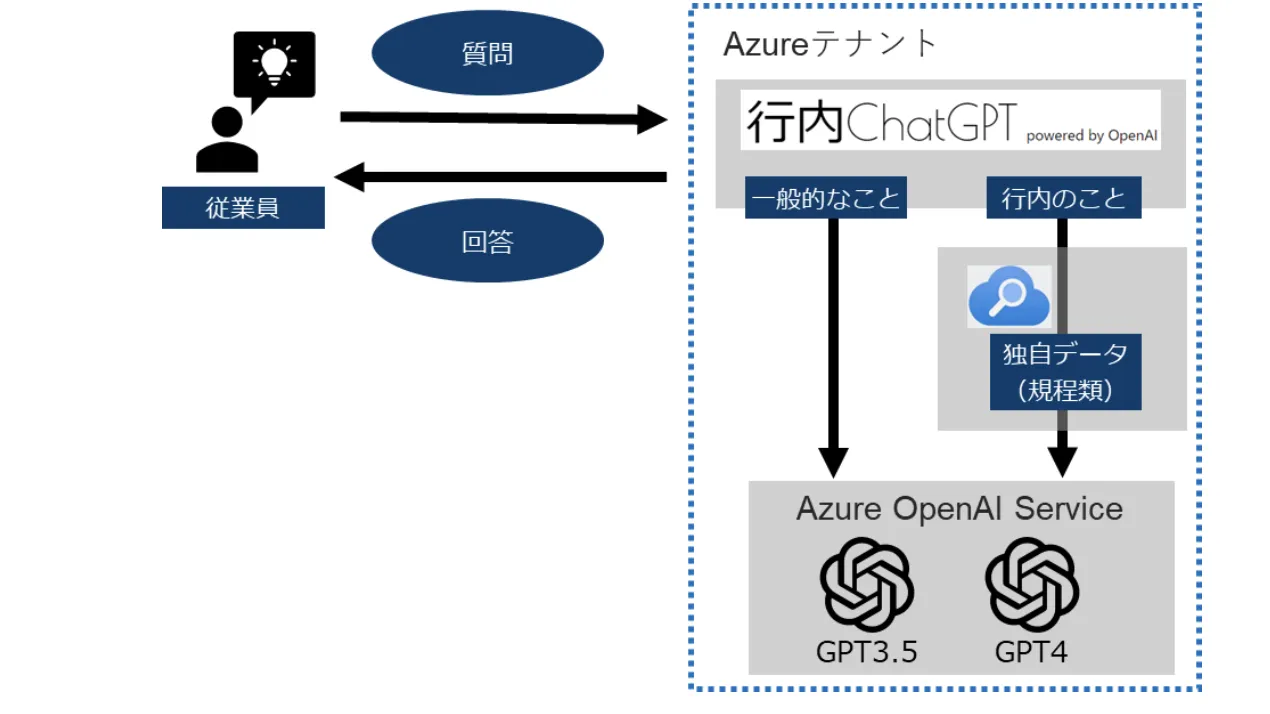

MicrosoftのMark Russinovich氏は、Azureプラットフォーム上で展開されるAI技術のセキュリティを強化するための新しい取り組みについて説明しました。

この取り組みの中心は、生成AIに関する脅威への対抗策の開発です。AIは有用なツールですが、悪意のあるプロンプトや中毒コンテンツによって悪用されるリスクも含んでいます。

そこで、MicrosoftはAI開発者のためのセキュリティツールを新たに導入し、多層的な防御戦略を実装しています。これにより、プロンプト注入攻撃やCrescendo攻撃といった複雑な攻撃手法にも効果的に対抗できるようになります。

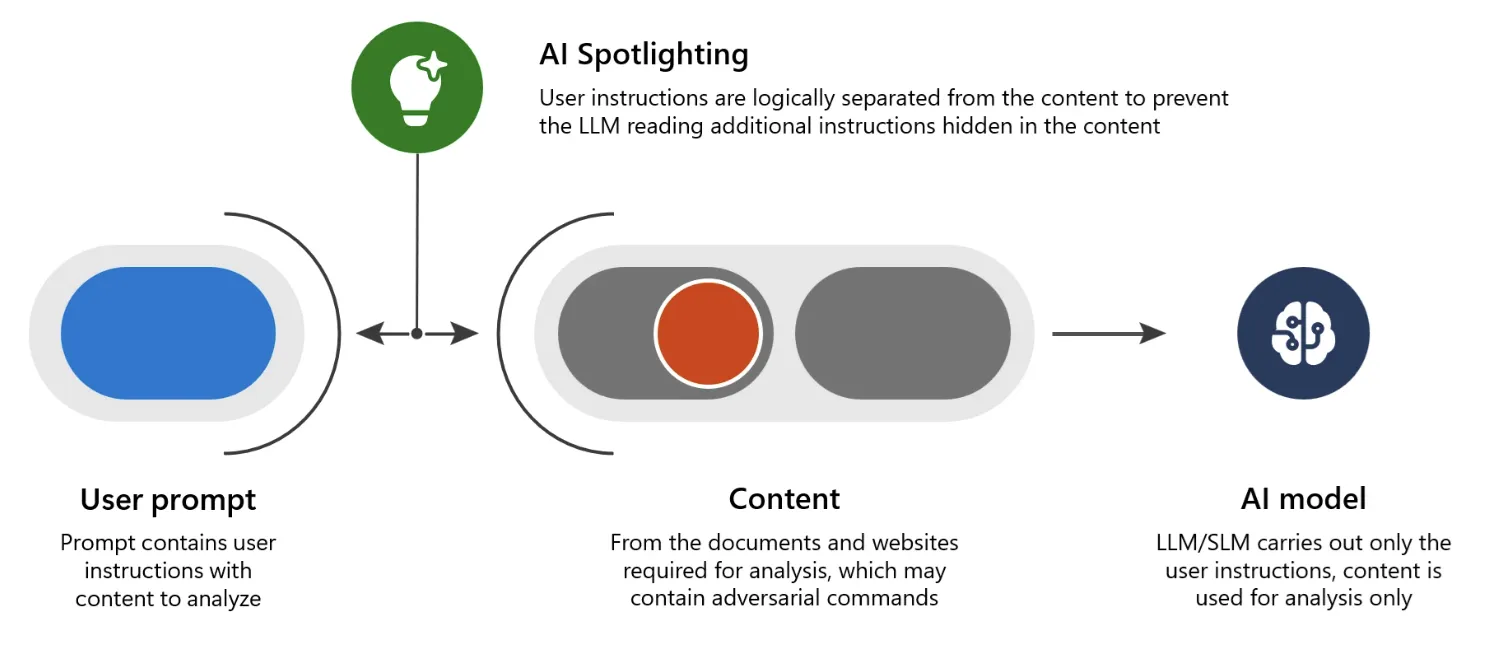

また、「Spotlighting」やプロンプトフィルターといった技術がこれらの脅威からAIを守るために使用されています。

Spotlighting

Microsoftが提供するAIセキュリティのオープンソースツールとコミュニティへの貢献

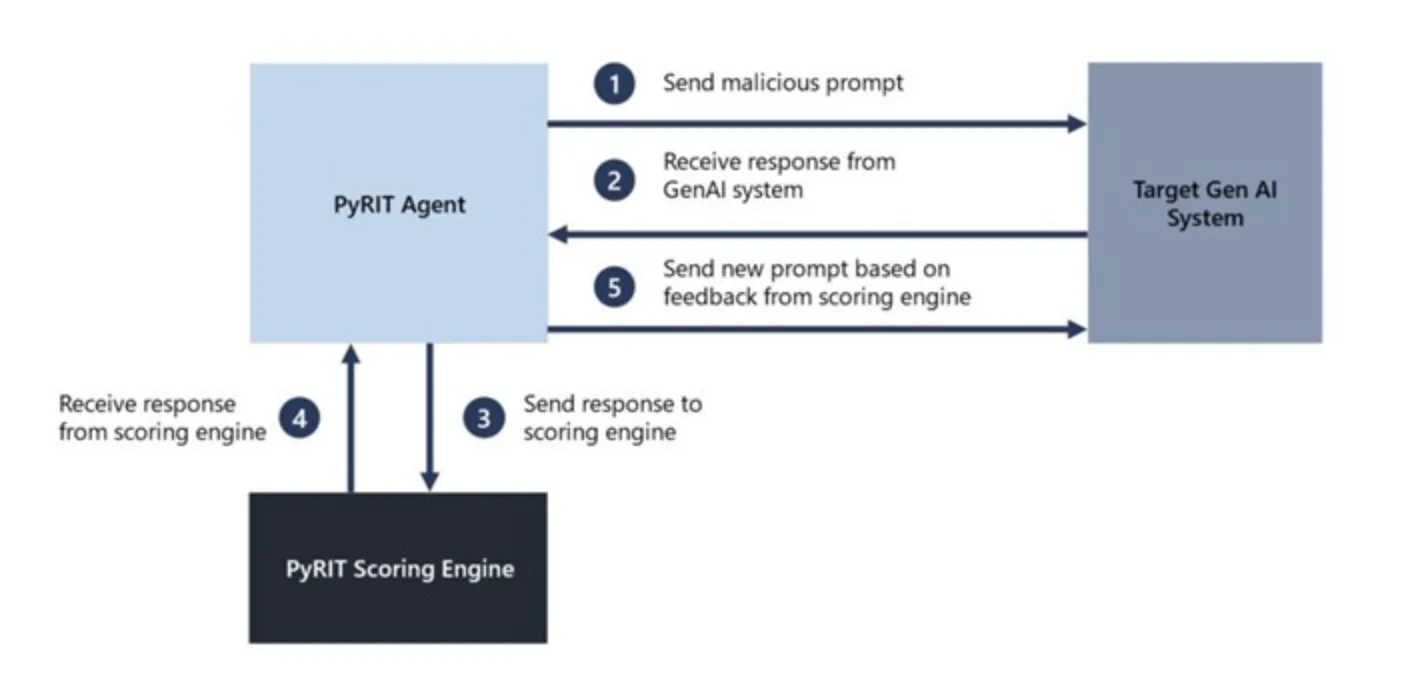

MicrosoftはAIのセキュリティ強化にあたり、オープンソースコミュニティへの貢献も活発に行っています。その一環として、生成AIのリスクを特定するためのオープンソースツール「PyRIT」を公開しました。

このツールを用いることで、開発者や研究者はAIが悪意のあるコンテンツにどのように反応するかを評価し、セキュリティ対策を講じることができます。

さらに、Microsoftは他のAIベンダーとの協力を重視しており、自社で発見したセキュリティ上の脆弱性や防御策を共有し、業界全体のセキュリティレベル向上を目指しています。また、バウンティプログラムを通して、脆弱性の責任ある開示を奨励しています。

*

*

PyRITの仕組み (参考:Microsoft Security)

Microsoftによる社会への情報提供とAIセキュリティの啓蒙活動

Microsoftは、AIセキュリティの情報を一般社会にも積極的に提供しています。LinkedInやTwitterなどのソーシャルメディアを通じて、AIセキュリティに関する最新の取り組みや更新情報を公開し、ユーザーに対してセキュリティ意識の向上を促しています。

これにより、消費者やビジネスユーザーは、AI技術を安心して使うための知識を得ることができ、セキュリティリスクを理解しやすくなります。

教育と情報提供はセキュリティ対策の重要な要素であり、Microsoftはそれを社会全体のレベルで支援しています。

Microsoft 責任あるAIソリューション (参考:Microsoft)

出典:Microsoft