この記事のポイント

この記事は、AI技術の進歩として12兆パラメータを持つ多言語AI言語モデル「Stable LM 2 12B」に関して解説しています。

Stable LM 2 12Bは、英語を含む7つの言語に対応し、多岐にわたるタスクに適用可能なモデルです。

監修者プロフィール

坂本 将磨

Microsoft AIパートナー、LinkX Japan代表。東京工業大学大学院で技術経営修士取得、研究領域:自然言語処理、金融工学。NHK放送技術研究所でAI、ブロックチェーン研究に従事。学会発表、国際ジャーナル投稿、経営情報学会全国研究発表大会にて優秀賞受賞。シンガポールでのIT、Web3事業の創業と経営を経て、LinkX Japan株式会社を創業。

AI技術がまたしても飛躍を遂げた2023年、多言語対応の巨大言語モデル「Stable LM 2 12B」が登場しました。12兆パラメータを有するこのモデルは、英語やスペイン語など複数の言語に対応し、基本モデルと指示チューニングモデルの2種類で展開され、幅広いタスクに適用可能です。

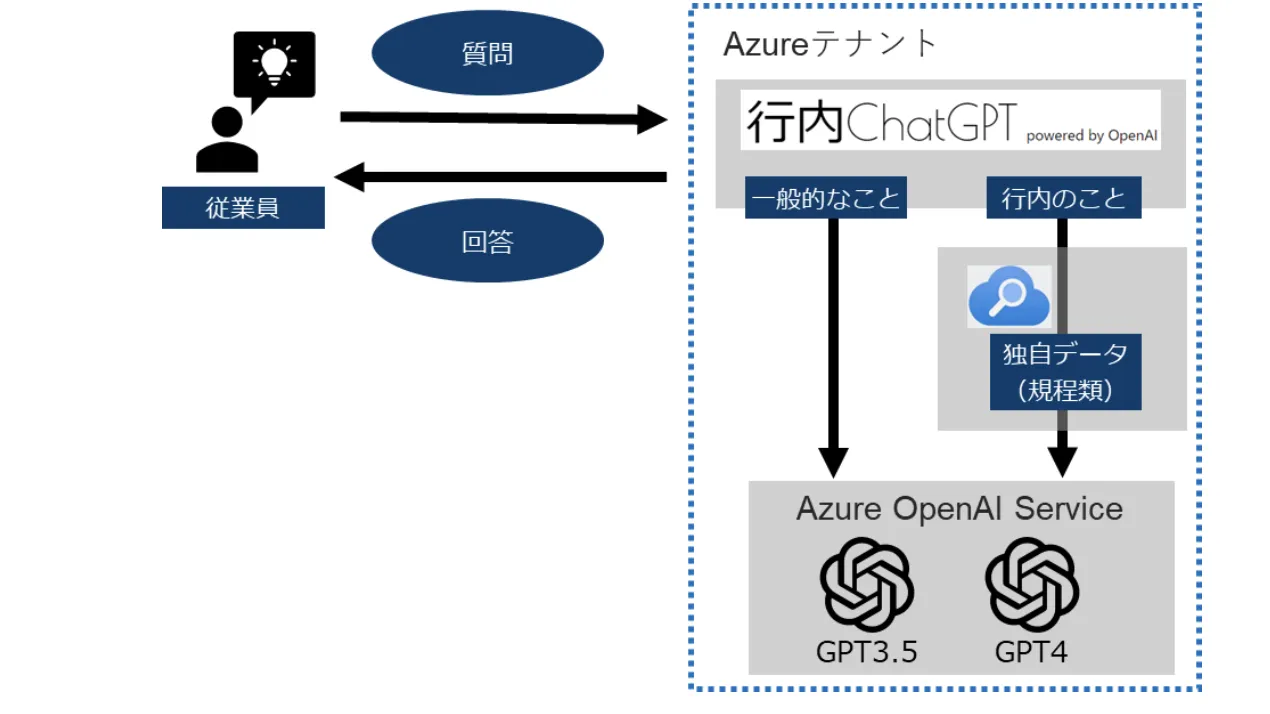

また、Hugging FaceでのテストとStability AIメンバーシップを通じた商業的・非商業的利用が可能となっており、これまでのStable LM 2 1.6Bを更新し、会話能力を高めるなど、性能が向上しています。

本記事では、AI技術の最前線を担うStable LM 2 12Bの特徴と潜在能力について、その効率的な動作や多言語対応能力、優れたパフォーマンスなどを探っていきます。

Stable LM 2 12B:多言語対応の新しいAI技術

2023年、AI技術は新たな進化を遂げました。今回紹介するStable LM 2 12Bは、英語やスペイン語など7つの言語に対応した言語モデルで、なんと12兆ものパラメータを持っています。このモデルは、基本モデルと指示チューニングモデルの2種類があり、さまざまなタスクに対応することを目的としています。

Hugging Faceというサイトでテストすることができ、Stability AIメンバーシップを通じて、商業的な目的にも非商業的な目的にも使用できます。Stable LM 2 12Bは、既に存在するStable LM 2 1.6Bのアップデート版であり、さらに会話スキルを向上させています。また、長文脈バリアントの導入も予定されており、そのリリースが待ち遠しいですね。

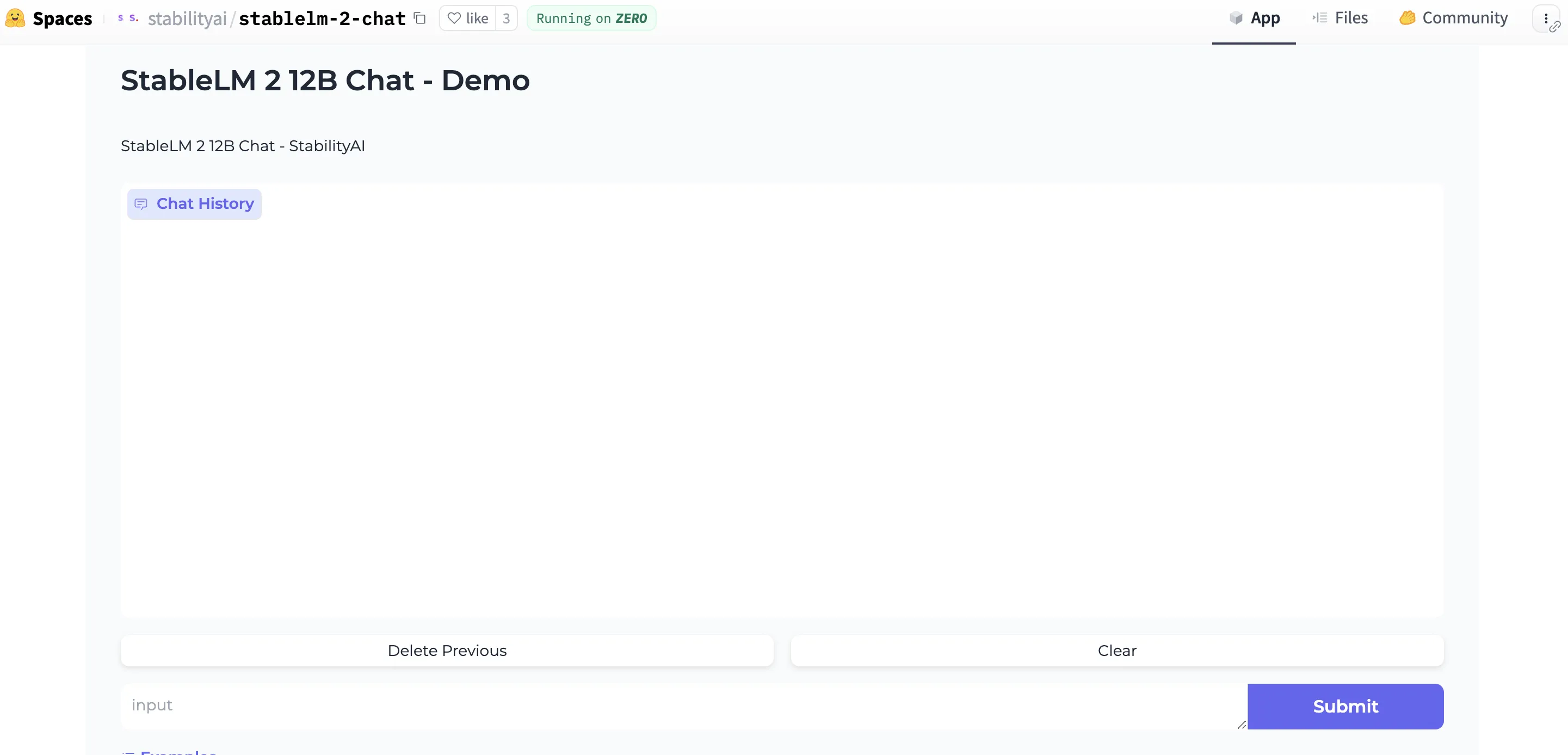

Stable LM 2 12Bのデモ画面

能力:効率的で強力な多言語AIモデル

Stable LM 2 12Bは、効率的に動作する設計になっており、大規模なモデルが必要とする計算能力やメモリリソースを大幅に削減することに成功しています。

例えば、Mixture-of-Experts(MoEs)という大きなモデルがありますが、Stable LM 2 12Bはこれよりも手軽にさまざまなタスクをこなせる点が魅力です。指示チューニングされたバージョンは、特にツールの使用や機能呼び出しにおいて高いパフォーマンスを発揮し、検索RAGシステムの中心部分としても活用できます。

これにより、開発者はより柔軟に、そして強力なAI言語技術を使って革新を起こせるようになります。

パフォーマンス:優れた性能を誇る新AIモデル

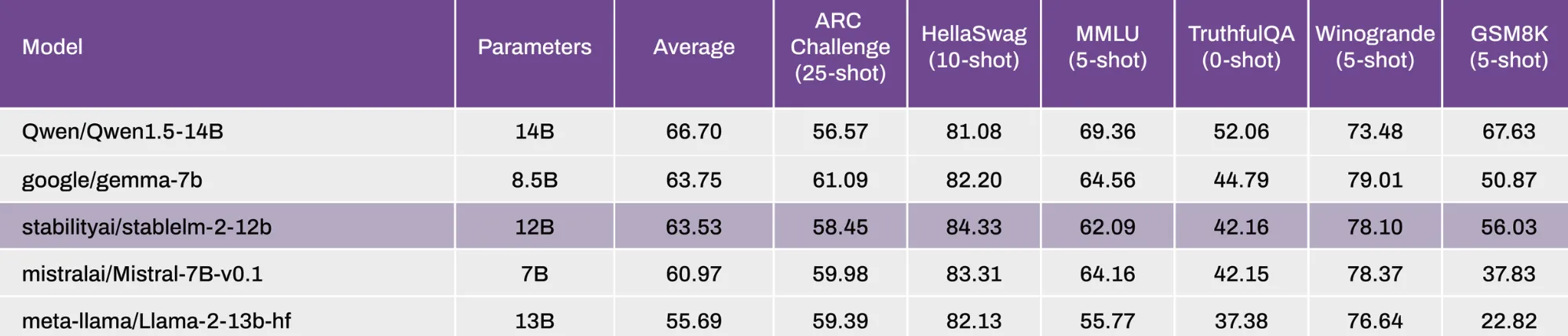

Stable LM 2 12Bのパフォーマンスは、他の人気のある言語モデルと比較しても非常に優れています。

Mixtral、Llama2、Qwen 1.5、Gemma、Mistralなどの強力なモデルとの比較結果が、Open LLMリーダーボードやMT-Benchといったベンチマークで公開されています。

ゼロショットおよびフューショットタスクでのパフォーマンスが特に注目されており、新しいStable LM 2 12Bはこれらのタスクにおいて堅実な成績を収めています。

この新しいリリースにより、StableLM 2ファミリーのモデルはさらに進化し、開発者や企業が自分たちのデータを完全に制御しながら将来を構築する手助けとなることでしょう。

Open LLM リーダーボード