この記事のポイント

この記事は、UIと言語両方を統合理解するScreenAIの特徴と利点について解説しています。

ScreenAIは、UIの機能を理解し、より直感的な操作を実現する技術です。

視覚言語モデルを活用して、コンピューターが画像やテキストの意味を人間に近い方法で処理します。

また、言語理解において、ユーザーインタフェースのテキストが意味するアクションを予測能力を有します。

この技術により、人間とコンピューターの対話がより自然で簡単になり、ユーザーエクスペリエンスの向上が期待されます。

監修者プロフィール

坂本 将磨

Microsoft AIパートナー、LinkX Japan代表。東京工業大学大学院で技術経営修士取得、研究領域:自然言語処理、金融工学。NHK放送技術研究所でAI、ブロックチェーン研究に従事。学会発表、国際ジャーナル投稿、経営情報学会全国研究発表大会にて優秀賞受賞。シンガポールでのIT、Web3事業の創業と経営を経て、LinkX Japan株式会社を創業。

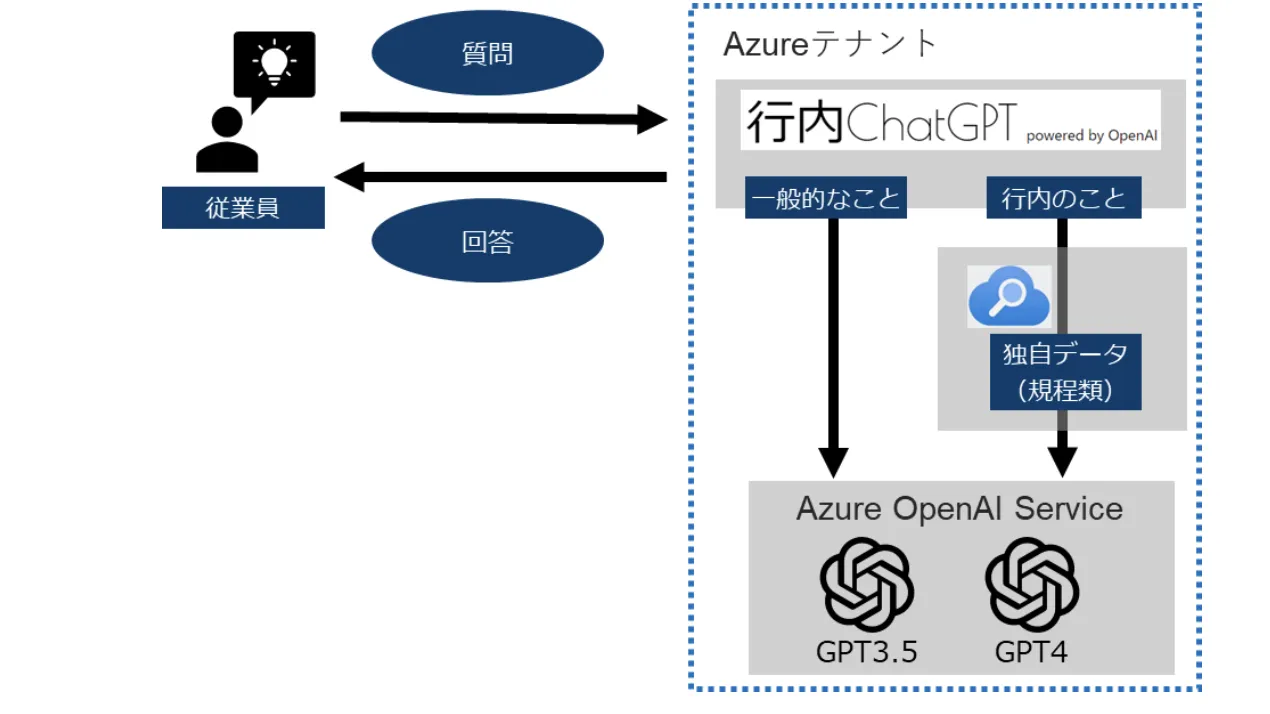

近年のテクノロジーの進化により、ユーザーインターフェース(UI)の解析と使いやすさはますます重要になっています。ScreenAIは、UIの各要素を理解し、視覚と言語の両方の情報を統合することで、ユーザーインタラクションを革新的に向上させるモデルです。この記事では、画面上で何が起こっているかを認識し、その機能を理解する能力に優れたScreenAIのメカニズムと、アプリやウェブサイト開発者が受けることができる恩恵についてご紹介します。また、言語理解においても人間の対話に近い自然さを実現するScreenAIの可能性に迫ります。UIと視覚要素を深く理解する視覚言語モデルによるインタラクションの強化に注目し、より円滑なデジタル体験の未来を探ります。

ScreenAIでUI解析が革新

ScreenAIは、コンピューターの画面上のユーザーインターフェイス(UI)の部分を読み取り、それがどんな機能を持っているかを理解することができます。例えば、ボタンが表示されていれば、そのボタンが何をするのか、またはどの領域が入力フィールドであるかどうかをScreenAIは認識します。

これによりアプリやウェブサイトの開発者は、自分たちの作ったUIが人々にどのように使われるか、もっと詳しく知ることができるようになります。またこの技術は利用者がもっと直感的に操作できるようにするためのヒントを提供することも可能です。

視覚言語モデルの新機軸

視覚言語モデルとは、画像の中にある物や文字をコンピューターが認識し、それについての理解を深める技術です。ScreenAIの場合、このモデルは画面上のUIを見て「これはメニューバーだ」「ここにはログイン情報を入力する場所がある」といった風に理解することができます。

視覚言語モデルはただ画像として認識するだけでなく、その画像が何を意味しているのかまで理解することが出来ます。ScreenAIはこの技術を使って、UIの解析をすることで、より人間に近い方法でコンピューターが情報を処理する手助けをしています。

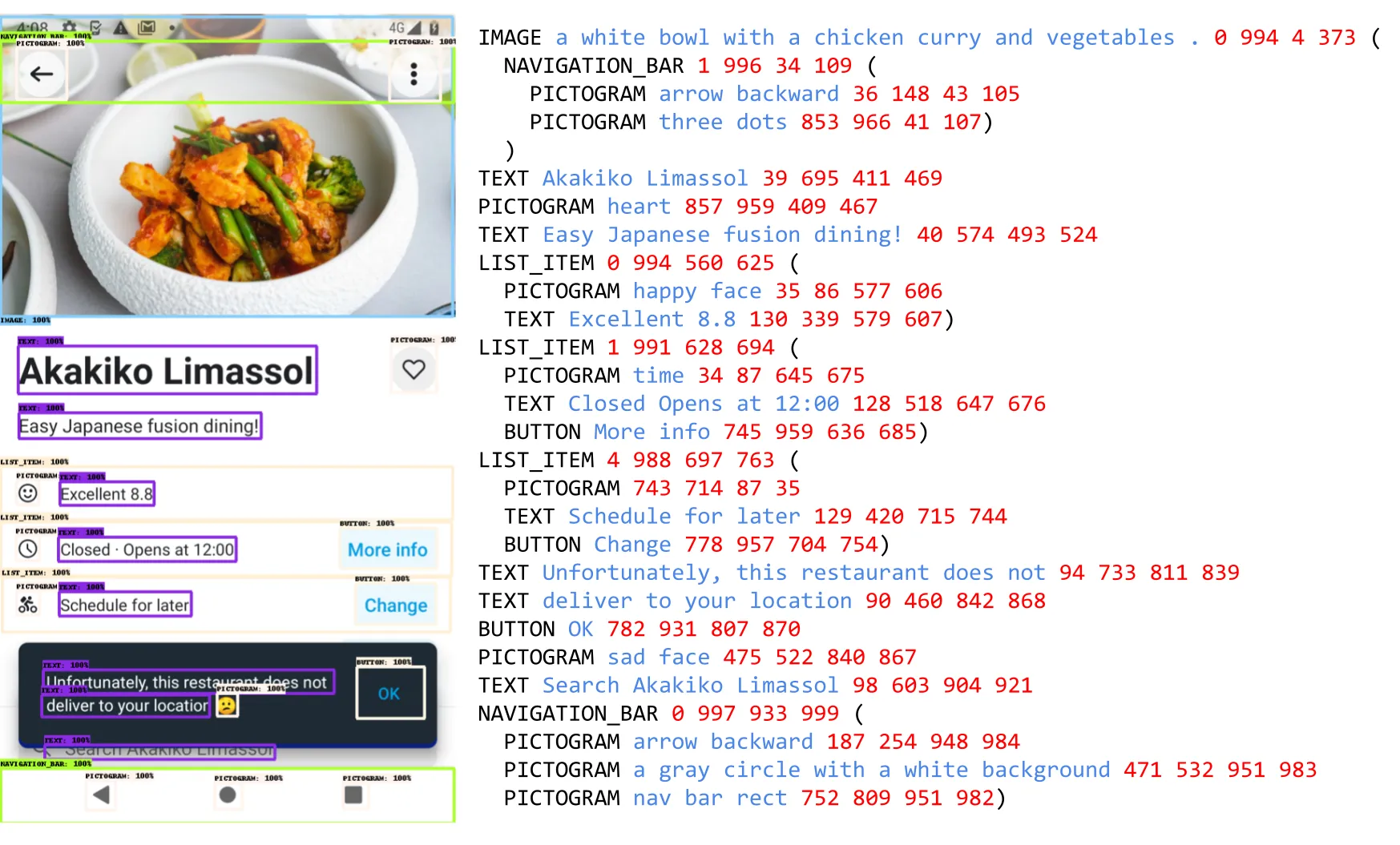

ScreenAIの利用画面

UI・言語理解でインタラクション強化

ScreenAIはUIだけでなく、言語理解の分野においても重要な役割を果たしています。言語理解とは、人間が使う言葉をコンピューターが理解する技術のことです。ScreenAIは、UIの中にあるテキスト、例えばボタンの上に書かれている「送信」という言葉が何を意味するのかを理解し、ユーザーがそのボタンを押したときに何が起こるのかを予測します。

この技術により、人々がコンピューターやアプリと対話するときの自然さや簡単さが向上し、より良いユーザーエクスペリエンスを提供することができます。

出典:https://blog.research.google/2024/03/screenai-visual-language-model-for-ui.html