この記事のポイント

この記事は、MITの新技術「Policy Composition(PoCo)」による多目的ロボットの学習効率向上について説明しています。

異なるデータソースを統合することで、ロボットが多様な作業を効率的に学習できるようにする技術です。

PoCoは、新しいタスクに対しても適応できるロボットの能力を高めることが可能です。

実世界のデータとシミュレーションデータの組み合わせを活用して、ロボットの性能を改善します。

MITの研究チームは将来、より多くのタスクやデータセットを使用してロボットのパフォーマンスを向上させることを目指しています。

監修者プロフィール

坂本 将磨

Microsoft AIパートナー、LinkX Japan代表。東京工業大学大学院で技術経営修士取得、研究領域:自然言語処理、金融工学。NHK放送技術研究所でAI、ブロックチェーン研究に従事。学会発表、国際ジャーナル投稿、経営情報学会全国研究発表大会にて優秀賞受賞。シンガポールでのIT、Web3事業の創業と経営を経て、LinkX Japan株式会社を創業。

ロボット技術の進展において、多種多様なタスクをこなす能力は極めて重要です。MITが開発した「Policy Composition(PoCo)」は、この点に革新をもたらす新技術です。

通常、特定のタスクに特化した大量のデータが必要とされるロボットのトレーニングに対し、PoCoは異種のデータソースを統合することで、ロボットが多様な作業を効率的に学習できるようにする手法を提供します。

PoCoの応用により、ロボットは訓練データに含まれない新たなタスクにも適応する能力を身につけ、その潜在能力がさらなる飛躍を遂げることでしょう。

多目的ロボット学習の新技術 PoCo

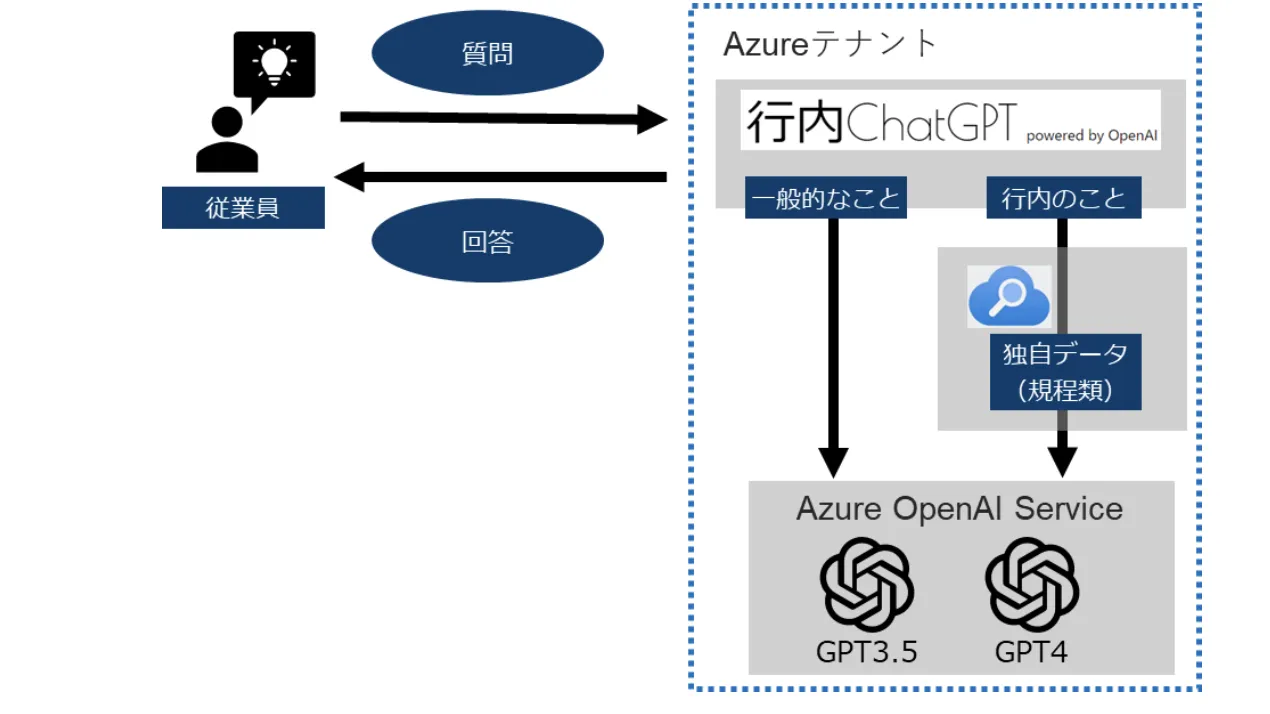

MITの研究チームによって開発された「Policy Composition(PoCo)」という新しい技術は、ロボットが複数の道具を使ってさまざまな作業を学ぶためのものです。

通常、ロボットを訓練するためには特定のタスクに特化した大量のデータが必要ですが、PoCoは異なるデータソースを統合して、ロボットが複数のタスクをこなせるようにするための進歩的なアプローチを提供します。

PoCoは、拡散モデルというジェネレーティブAIを使って、ロボットに異なるタスクの戦略を学ばせ、それらを一つの一般的なポリシーに統合します。

これにより、ロボットは訓練中に見たことのない新しいタスクにも適応可能になります。

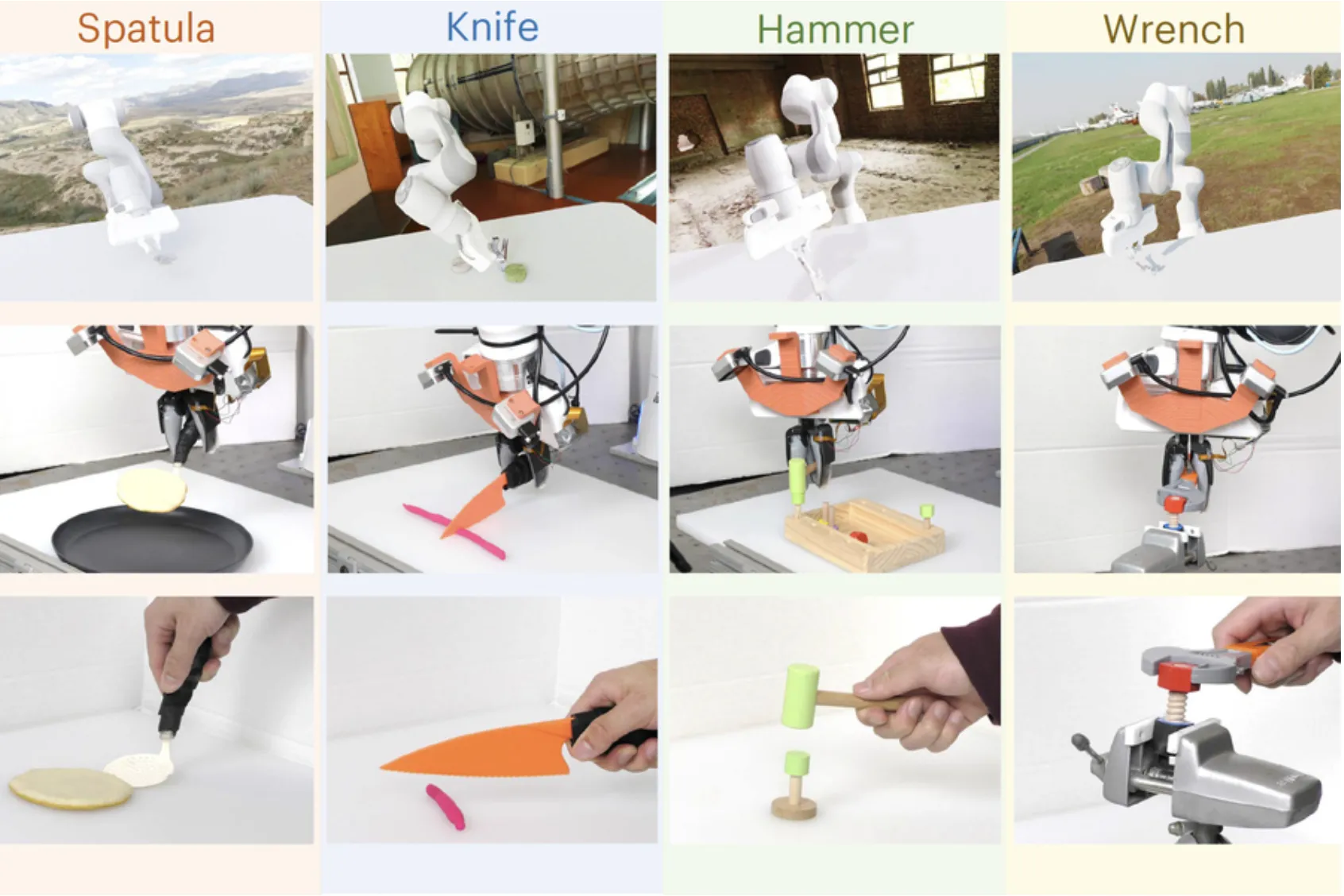

ハンマー、ドライバー、ヘラなどのさまざまなツールを効果的に利用

データ統合でロボットが進化

ロボットのポリシーとは、入力からアクションを生成する機械学習モデルのことです。

MITの研究者たちは、異なるタスクに特化した複数の小さなデータセットを取り、それぞれから学んだポリシーを組み合わせる技術を開発しました。

拡散モデルを使用して各ポリシーを表現し、それらのポリシーを重み付けして組み合わせることで、最終的なポリシーが各個別ポリシーの目的を満たすようにします。

この方法により、ロボットはシミュレーションデータと実世界データの両方の利点を活かして、より優れたタスクパフォーマンスを実現できます。

AIがロボットの適応力を向上

PoCoは、従来のベースラインメソッドと比較して、タスクパフォーマンスを20%向上させることができました。

この技術は、ロボットがハンマーを使って釘を打つ、スパチュラで物をひっくり返すなど、さまざまな道具を使ったタスクを実行するシミュレーションと実際のロボットアームでテストされました。

研究者たちは将来、より長期間のタスクや、さらに大きなロボットデータセットを組み込むことでパフォーマンスを向上させることを目指しています。

インターネットデータ、シミュレーションデータ、実際のロボットデータの組み合わせがロボティクスの成功に不可欠であり、それらを効果的に組み合わせる方法が今後の大きな課題です。

PoCoは、この課題に向けた重要なステップとされています。

出典:MIT