この記事のポイント

生成AI技術の脅威に対する、子ども保護のための産業界の新しい取り組みについて説明しています。

ThornやAll Tech Is Humanと協力した、子どもへのリスクを軽減するための安全対策の誓約が行われています。

AI技術の利用における虐待的コンテンツの検出や予防メッセージの展開など、段階的な安全対策が強調されています。

継続的な監視と保護ツールの開発により、CSAMとCSEMを検出、報告し、これを予防する取り組みが進められています。

監修者プロフィール

坂本 将磨

Microsoft AIパートナー、LinkX Japan代表。東京工業大学大学院で技術経営修士取得、研究領域:自然言語処理、金融工学。NHK放送技術研究所でAI、ブロックチェーン研究に従事。学会発表、国際ジャーナル投稿、経営情報学会全国研究発表大会にて優秀賞受賞。シンガポールでのIT、Web3事業の創業と経営を経て、LinkX Japan株式会社を創業。

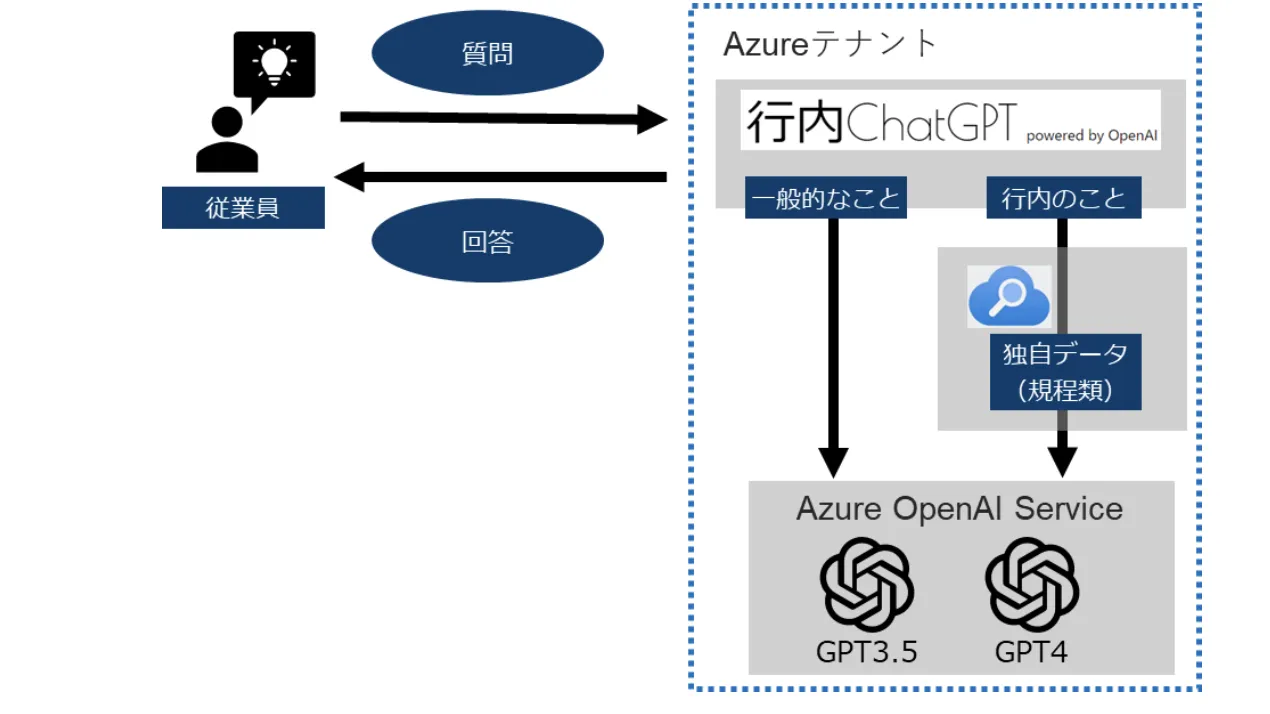

AI技術が目覚ましい発展を遂げる中、その影響は社会のさまざまな領域に浸透しています。特に子どもの保護においては、これらの技術が与えるリスクに早急に対応する必要があるとされています。

本記事では、産業界リーダーたちが「生成AI技術の子ども保護への取り組み」として発表した、革新的な安全対策の誓約について紹介します。

ThornやAll Tech Is Humanと協力し、AIの開発及び展開における安全なガイドラインの実施やセキュリティ向上など、各社がどのようなアプローチで子どもたちの安全を守るべく努力しているのかを解説していきます。

この重要な動きが、今後のAI技術の社会的責任の範疇をどのように変化させるのか、その意義を掘り下げていきましょう。

AI技術で子どもの安全守る: AI産業界の新たな取り組み

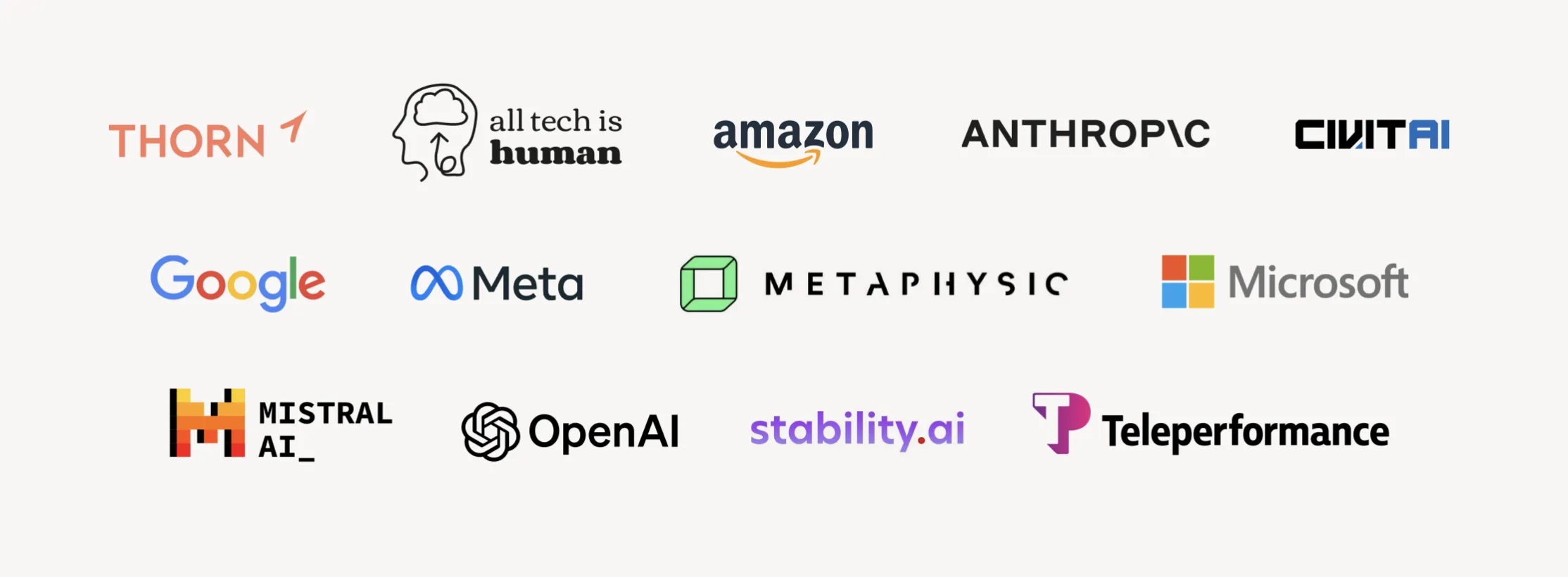

2024年4月23日、AI業界のリーダーたちは、子どもの安全を高めるための重要な取り組みを発表しました。これには、非営利団体であるThornやAll Tech Is Humanとの協力が含まれます。

彼らは、子どもに対する性的虐待素材(CSAM)の生成や拡散を防ぐために、AI技術の開発、展開、維持において安全対策を強化することに注力しています。

この取り組みは、生成AIが子どもに与えるリスクを軽減することを目的としており、AIモデルが安全であることを確実にするために厳格なポリシーの実施、広範なレッドチーミングの実施、外部専門家との協力が優先されています。

AI業界を牽引する企業による、子供の安全への取り組み (参考:Thorn)

安全対策の具体的な内容と段階的な展開

この取り組みでは、AI技術の利用段階での安全対策も重視されています。

これには、入力と出力における虐待的コンテンツの検出、ユーザーの報告機能、執行メカニズムの導入、予防メッセージの展開、段階的なリリースによる初期段階での虐待監視などが含まれます。

さらに、モデルカードに子どもの安全に関するセクションを取り入れることで、安全性に対するコミットメントを明確にしています。

継続的な監視と保護ツールの開発

AI技術の維持においては、NCMECへの報告時にGenerative AI File Annotationを使用し、CSAMとCSEMを検出、報告、削除、予防する取り組みが行われています。

また、AIによる生成操作からコンテンツを保護するためのツールへの投資や、悪意ある行為者によるプラットフォームや製品の悪用防止のためのオープンソースインテリジェンスの活用も含まれています。

これらの対策は、子どもの安全を守ると同時に、AI技術の健全な発展を促進することを目指しています。

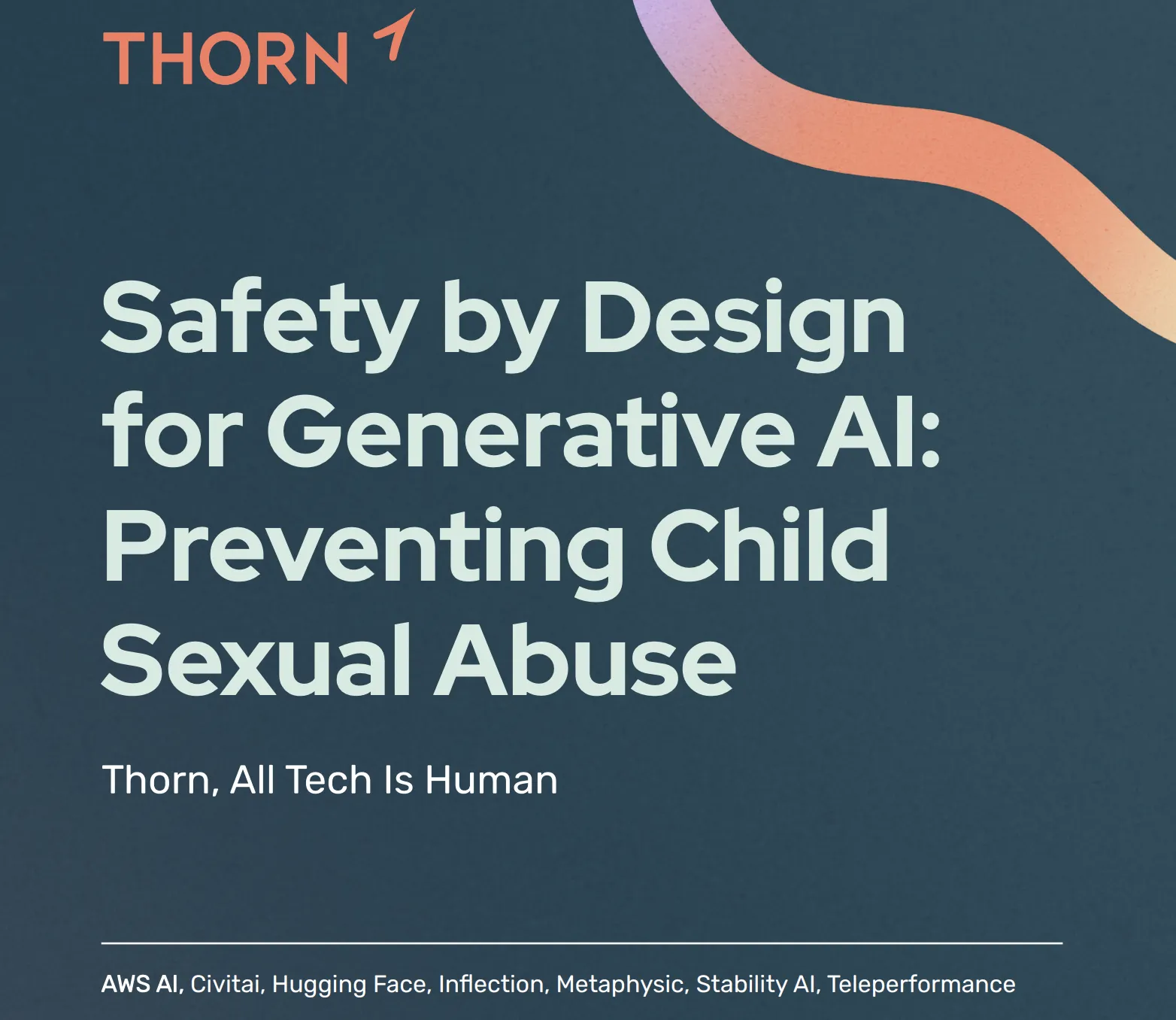

本日発表された論文「ジェネレーティブAIのための安全設計:児童の性的虐待の防止」 (参考:Thron)

出典:Anthropic