NPUとは?

NPU (Nueral Processing Unit) とは、ニューラルネットワークの処理に特化した専用プロセッサのことです。

人工知能 (AI) の演算処理、特に深層学習モデルの推論処理を効率的に実行するために設計されています。このプロセッサによってAI関連やディープラーニングの計算を高速に実行することができます。

従来のCPUやGPUと異なり、NPUはニューラルネットワークの行列演算や畳み込み演算などの特定の計算パターンを高速に処理できるように最適化されています。

NPUとは 参考: Intel

CPU・GPU・NPUの違い

| プロセッサ | 主な用途 | 特徴 | 強み | 弱み |

|---|---|---|---|---|

| CPU | 汎用処理 | 順次処理に優れた汎用プロセッサ | 柔軟性が高く、あらゆる計算が可能 | AI処理には非効率的 |

| GPU | グラフィック処理、AI学習 | 並列処理に優れたプロセッサ | 大量データの並列処理が得意 | 消費電力が高い |

| NPU | AI推論 | エッジデバイス向けAI専用プロセッサ | 低消費電力で高速推論が可能 | 汎用性に欠ける |

CPUは汎用性に優れていますが、AI処理には効率が悪く、GPUは並列処理能力が高いが消費電力が大きいという課題があります。

NPUはこれらの中間に位置し、特にエッジデバイスでの低消費電力高効率AI推論に特化しています。

なぜNPUが注目されているのか

NPUが注目されている理由は、主に以下の3つの要因があります。

-

ローカルAI需要の高まり

大規模言語モデルをはじめとするAIサービスはクラウド上のみで動作し、ユーザはデータを全てクラウドに送信し、処理結果のみを受け取るという形態が主流でした。しかし端末のバックグラウンドや至る所にAIが普及し、端末側でAI推論を行うニーズが高まっています。

スマートフォンのカメラや顔認証、音声認識、あるいは業務PCでの高度なプライバシー保護など、「クラウドにデータを送信することなく、オフライン・リアルタイムでAIを動かすメリット」は今後もさらに広まる見込みがあります。 -

エッジコンピューティングとプライバシー・レイテンシの課題

端末 (エッジ) でAIを処理すると、ネットワーク遅延を気にせずリアルタイムでの応答が可能になります。

また、クラウドにデータを送信せずにデバイス上で処理することで、プライバシー保護とネットワーク遅延問題を同時に解決できます。特に個人データや監視カメラなどのセンシティブなデータを扱う分野では、NPUによるオンデバイス処理が重要視されています。 -

消費電力効率とバッテリ駆動

スマホやノートPCなどのバッテリ駆動の端末では、電力効率がとても重要になります。GPUをフル稼働させてAI推論を行うと膨大な電力を消費し、短時間でバッテリが尽きてしまいます。

従来のGPUと比較して、NPUは特定のAI処理に特化することで消費電力あたりの性能が大幅に優れています。バッテリー駆動のモバイルデバイスや、IoT機器では、この省電力性が決定的な利点となっています。

NPUの仕組みと特徴

NPUがどのような工夫で効率的なAI処理を実現しているのか、その内部構造と設計思想に焦点を当てて解説します。NPUの優位性は、単に専用ハードウェアというだけでなく、AI処理の特性に合わせた複数の最適化技術の組み合わせによって実現されています。

行列演算・畳み込み乗算の最適化

AIで主要となる演算は「行列演算」と「畳み込み演算」です。これらの処理をいかに効率的に行うかがAI処理の速度と電力効率を左右します。

NPUは、これらの演算に特化した専用ハードウェア回路を搭載しています。ニューラルネットワークで頻出する特定パターンの計算に特化した回路設計により、無駄のないデータフローと処理効率を実現しています。

例えば、画像認識で使われる畳み込みニューラルネットワーク (CNN) では、同じフィルタを画像全体に適用する処理が繰り返されますが、NPUではこのパターンを一度にまとめて処理できる専用回路を備えています。

低精度演算と大量並列化

AI推論では、必ずしも高精度の浮動小数点演算が必要ないことが知られています。NPUはこの特性を活かし、INT8 (8ビット整数) や、FP16 (16ビット浮動小数点) などの低精度演算を基本としています。

一方、従来のGPUは32ビッド浮動小数点 (FP32) 演算を標準としており、より高い精度で計算できる代わりに、演算あたりのリソース消費が大きくなります。

NPUは低精度演算を採用することで、同じシリコン面積により多くの演算ユニットを搭載可能となり、並列処理能力と、低消費電力を実現しています。

メモリアクセスの最適化

AI処理の課題の1つとして、膨大なデータ移動によるボトルネックがあります。モデルのパラメータや中間層の特徴マップなど、大量のデータをメモリと演算ユニット間で効率的に転送させる必要があります。

NPUはこの課題に対して、以下のような最適化を行なっています。

- オンチップメモリの活用: 頻繁にアクセスするデータをチップ内の高速メモリに配置

- データフロー制御: 演算間のデータ移動を最小化する処理順序の最適化

- 専用メモリコントローラ: ニューラルネットワークの特性に合わせたメモリアクセスパターンの効率化

これらの工夫により、NPUはデータ供給のボトルネックを解消し、演算ユニットを常に稼働させることで処理効率を最大化しています。

次世代PCにおけるNPUの必然性

NPUの基本的な概念の次に、このプロセッサが現在のパソコン市場にどのような変革をもたらしているのかを見ていきましょう。

近年、主要PCメーカーはこぞってNPUを搭載したモデルを発表しており、AI処理能力がPCの新たな差別化要素となっています。

Copilot+ PCが示すバランスの取れたAIコンピューティング環境

Microsoftは2024年6月、「Copilot+ PC」という新たなPCカテゴリを定義しました。ここでは40TOPS以上のNPU性能を搭載することを要件としています。TOPS (Tera Operations Per Second) とは1秒間に何兆回演算できるかを示す指標です。

この要件は、GPUなどの他の手段で同等のTOPS性能を実現していても「消費電力を抑えつつ、実用的なAI処理を実行できるNPU」であることが重要というメッセージを含んでいます。

Copilot+ PCのコンセプトは、クラウドAIに頼りきらずに、ノートPCのバッテリ環境下でローカルAIを活用できるバランスの取れた環境づくりにあるといえます。

参考: Microsoft

GPUではなくNPUが求められる理由

GPUは大規模な演算能力を持っていますが、本来はグラフィックス描画用に最適化されているため、AI推論に必要以上の電力や回路規模を抱えがちです。特に推論に限れば、8bit〜16bitの低精度演算で十分です。そうした低精度行列演算を大量並列する仕組みこそNPUの真価といえます。

消費電力を考慮したPCやモバイル端末にはNPUが適しています。

GPUとNPUの使い分け

今後はローカルAIをより柔軟に運用するために、GPUとNPUの使い分けが行われるとみられます。高負荷でGPUが得意な処理はGPUへ、低精度かつ、リアルタイム性を要する推論タスクはNPUへ、といったようにアプリケーションやユーザに応じて動的に切り替わるシステム設計が進むと考えられます。

ローカルAIとクラウドAIのハイブリッド運用

NPUの登場により、AI処理をクラウドだけでなくローカルでも効率的に行えるようになりました。

この変化は、クラウドとローカルの両方の長所を活かした新しいAI活用パターンを生み出しています。

企業や個人がNPU搭載デバイスを活用してAIをどのように使い分けるべきか、またそのハイブリッド運用について見ていきましょう。

企業利用における機密データの扱い

企業や組織が保有する機密データをAIに学習させる場合、クラウドへ送ると情報流出のリスクが高まります。一方、NPU搭載PCなどでローカルAIとして完結させれば、機密情報が外部に出ることがありません。

クラウドAIとローカルAIの使い分け

クラウドAIがすべてローカルに置き換わるわけではありません。大規模な学習はクラウドが主流ですし、常に最新モデルを活用したい場面ではクラウド連携が便利です。

ただし今後は、**クラウドAIとローカルNPUによる推論を上手に組み合わせる「ハイブリッド運用」**が進むことが予想されます。

具体的には以下のような要素に基づいて最適な処理場所を動的に判断するシステムが発展するでしょう:

- ネットワークの状態 (帯域、安定性)

- データの機密性レベル

- 処理の緊急性とリアルタイム性

- データサイズと転送コスト

- 必要な計算リソースの規模

このようなハイブリッドアプローチにより、セキュリティとパフォーマンス、コスト効率の最適なバランスを実現できます。NPUの性能向上と普及に伴い、ローカル処理の比重は今後さらに高まっていくことでしょう。

NPU活用がもたらすPC再定義の展望

NPUの普及は、単なる新しいチップの追加にとどまらず、パソコンの使い方や価値そのものを再定義する可能性を秘めています。ここでは、主要メーカーのNPU開発動向を紹介します。

各社のSoC・NPU動向

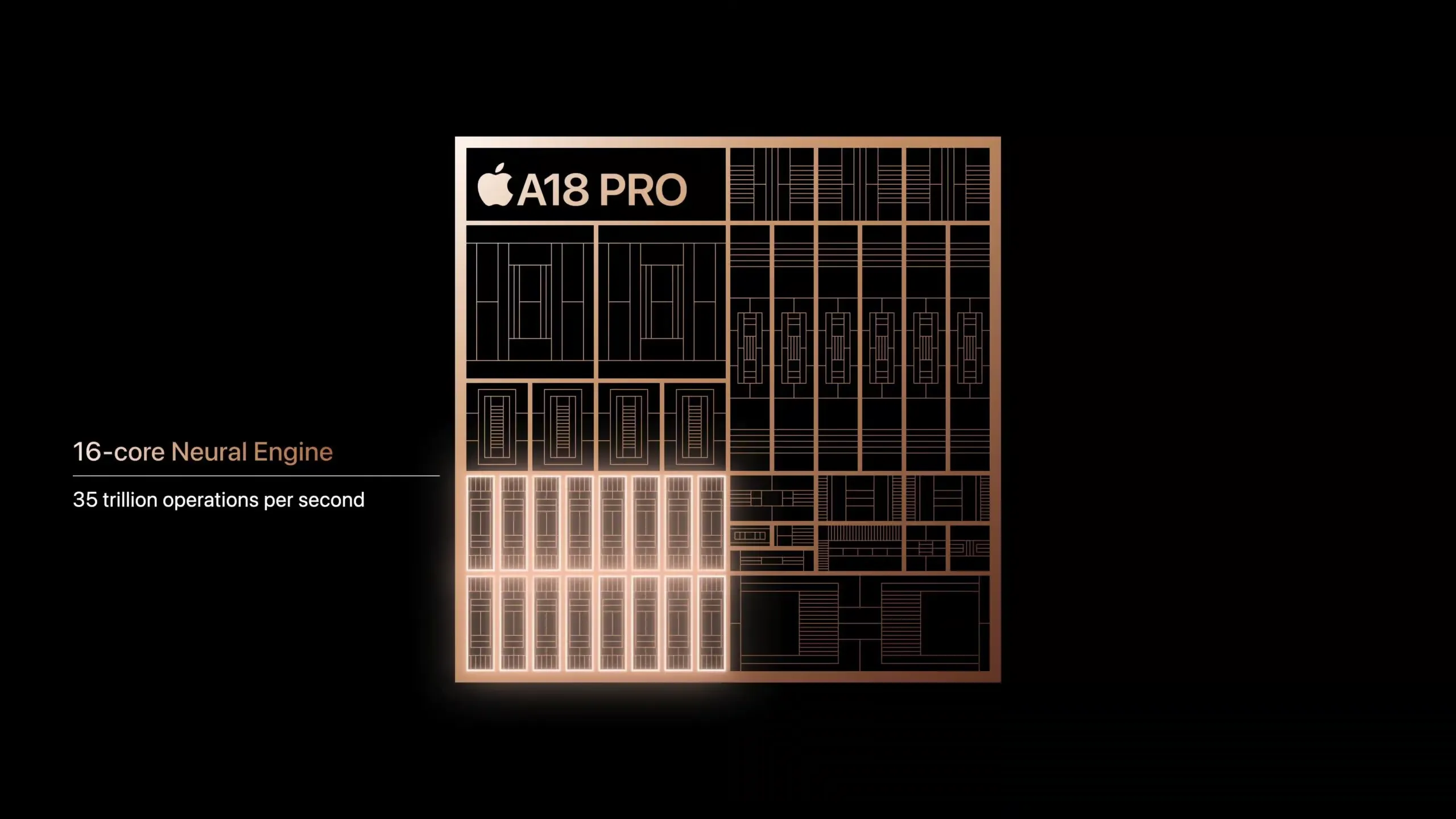

- Apple: スマートフォン向けのAシリーズやMac/iPad向けのMシリーズに「Neural Engine」と呼ばれるNPUを搭載しています。

- Aシリーズ: 2024年9月に発売されたA18およびA18 Proチップは、16コアのNeural Engineを搭載し、最大35TOPSの演算能力を持ちます。前世代のA17 Proと比較して、Apple Intelligence機能の処理速度が最大15%向上しています。

- Mシリーズ: 2024年5月に発売されたM4チップは、28億個のトランジスタを持ち、16コアのNeural Engineは最大38TOPSの性能を発揮します。全世代のM3チップの18TOPSから大幅な向上となっています。

A18 Proチップ 参考: Apple

- Qualcomm: スマートフォン向けやPC向けのSoC「Snapdragon」シリーズで、強力なAIエンジンを提供しています。

- Snapdragon Xシリーズ: 2025年1月に発表された新しいSnapdragon Xチップは、45TOPSのNPU性能を持ち、MicrosoftのCopilot+ 機能をサポートしています。

- Snapdragon 8 Gen 3: このプロセッサは、Hexagon NPUを強化し、全世代比で98%の性能向上と、40%の電力効率を実現しています。これにより、Stable Diffusionや画像処理などのAIタスクをデバイス上でリアルタイムに処理できます。

Qualcomm AI Engine 参考: Qualcomm

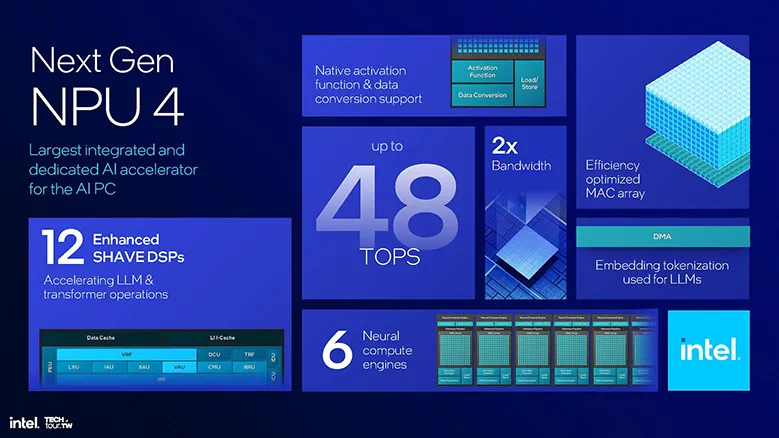

- Intel: PC向けにNPUを統合する計画を進めています。

- Lunar Lake: 2024年に発表されたプロセッサでは、AIワークロードで100TOPS以上の性能を達成し、そのうち45TOPSはNPUによるものです。MicrosoftのCopilot AI機能をローカルで実行する要件を満たしたプロセッサを提供しています。

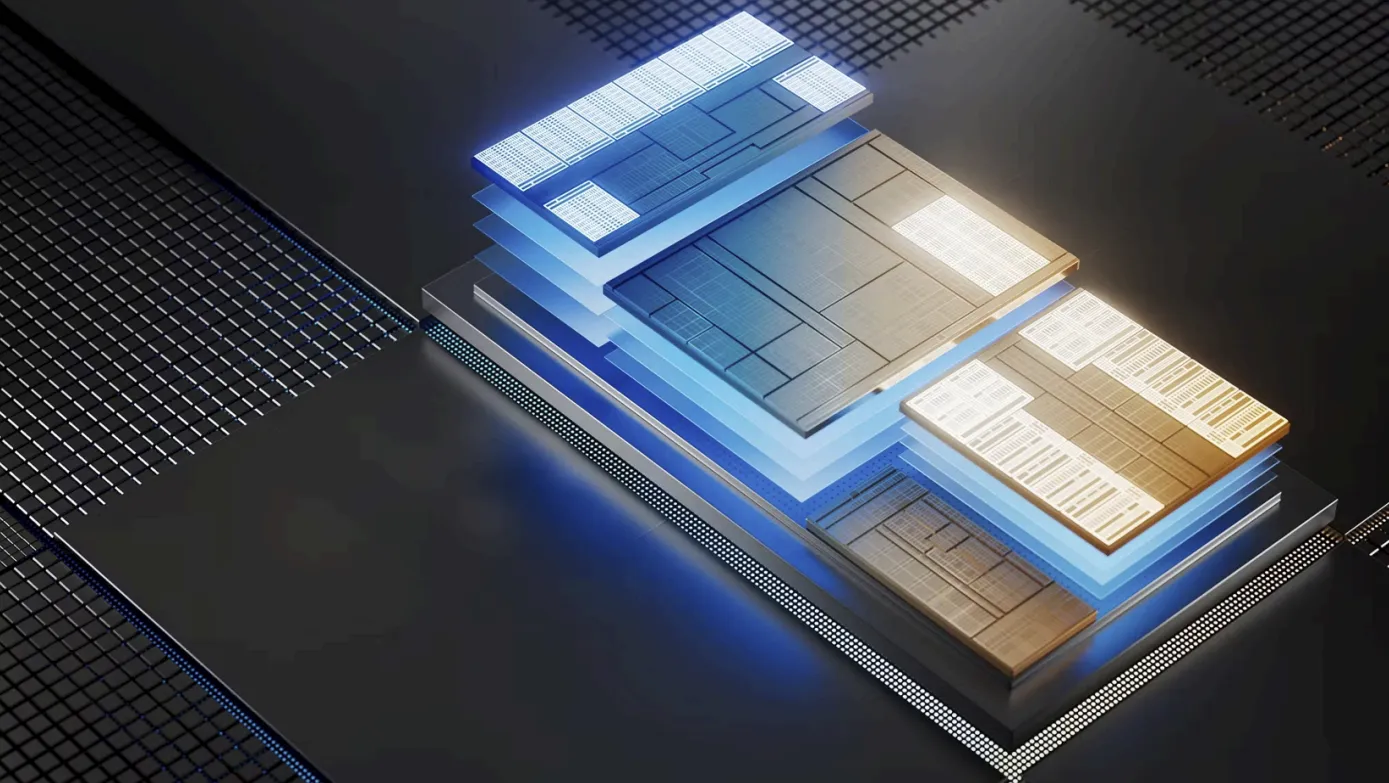

Intel Lunar Lake 参考: Lunar Lake Architecture Session Highlights, Intel

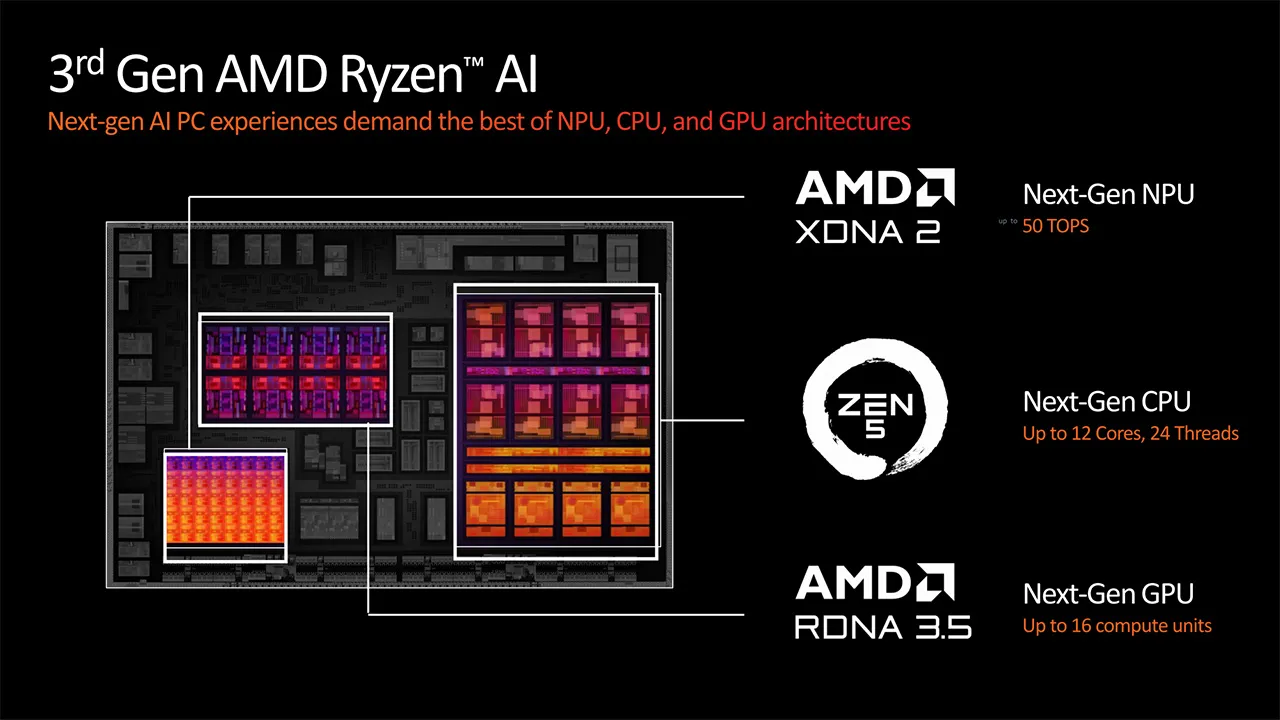

- AMD: ノートPC向けでXDNA2アーキテクチャをベースとしたNPUを搭載したプロセッサを提供しています。

- Ryzen AI 300シリーズ: 2024年7月に発売された最新のRyzen AI 300シリーズは、最大50TOPSの性能を発揮するNPUを搭載しています。

AMD Ryzen AI 参考: Computex 2024

AIとの協働による業務変革

NPU搭載のPCの普及は、単なるハードウェアの進化にとどまらず、人間とコンピュータの関係性を根本から変える可能性を秘めています。

従来のコンピュータは「人間が明確な指示を与えなければ動かない」ツールでしたが、AIとの協働が当たり前となる時代では、コンピュータ自体が「何が役立つか」を提案し、人間の創造性を増幅する存在へと進化します。

例えば、

- 膨大なデータから有意義なパターンを自動検出

- 文書作成やデザイン作業における創造的な提案

- 日常業務の自動化と最適化

- 個々のユーザーの作業スタイルに合わせたパーソナライズされた支援

NPUはこうしたオンデバイスAI体験を、プライバシーを保ちながら低遅延で提供する基盤となります。クラウドに依存せずとも高品質なAI体験を実現することで、PCの利用価値を再定義していくでしょう。

まとめ

NPUは、AI時代の新たなプロセッサのとして急速に普及しつつあります。従来のCPUやGPUと異なりAIに特化したこの専用チップは、低消費電力と効率的な処理を両立させる鍵となっています。

本記事では、NPUの基本概念から仕組み、各社の開発動向、そして将来展望まで幅広く解説してきました。NPUが注目される背景には、ローカルAI需要の高まり、エッジコンピューティングの普及、そしてバッテリー駆動デバイスでの省電力性能の重要性があります。

今後のコンピューティング環境では、クラウドAIとローカルAIのハイブリッド運用が主流となるでしょう。データの機密性、処理の緊急性、ネットワーク状況などに応じて、最適な処理場所を動的に選択するシステムが発展していくと予想されます。

これから、ローカルAIを活用しようとしている方や、クラウドAIとローカルAIのハイブリッド運用を検討している方にとって、この記事が何かしらのヒントや指針となれば幸いです。